ปฏิวัติการทดสอบ A/B ด้วย AI และ Amazon Bedrock

การทดสอบ A/B เป็นรากฐานสำคัญของการเพิ่มประสิทธิภาพประสบการณ์ผู้ใช้ การปรับปรุงข้อความ และการปรับปรุงขั้นตอนการแปลงมาอย่างยาวนาน อย่างไรก็ตาม การพึ่งพาการกำหนดแบบสุ่มตามปกติมักจะหมายถึงวงจรการทดสอบที่ยาวนาน บางครั้งใช้เวลาหลายสัปดาห์ เพียงเพื่อให้ได้นัยสำคัญทางสถิติ กระบวนการนี้ถึงแม้จะมีประสิทธิภาพ แต่ก็ช้าโดยธรรมชาติ และมักพลาดสัญญาณสำคัญที่ซ่อนอยู่ในพฤติกรรมของผู้ใช้ในระยะแรก

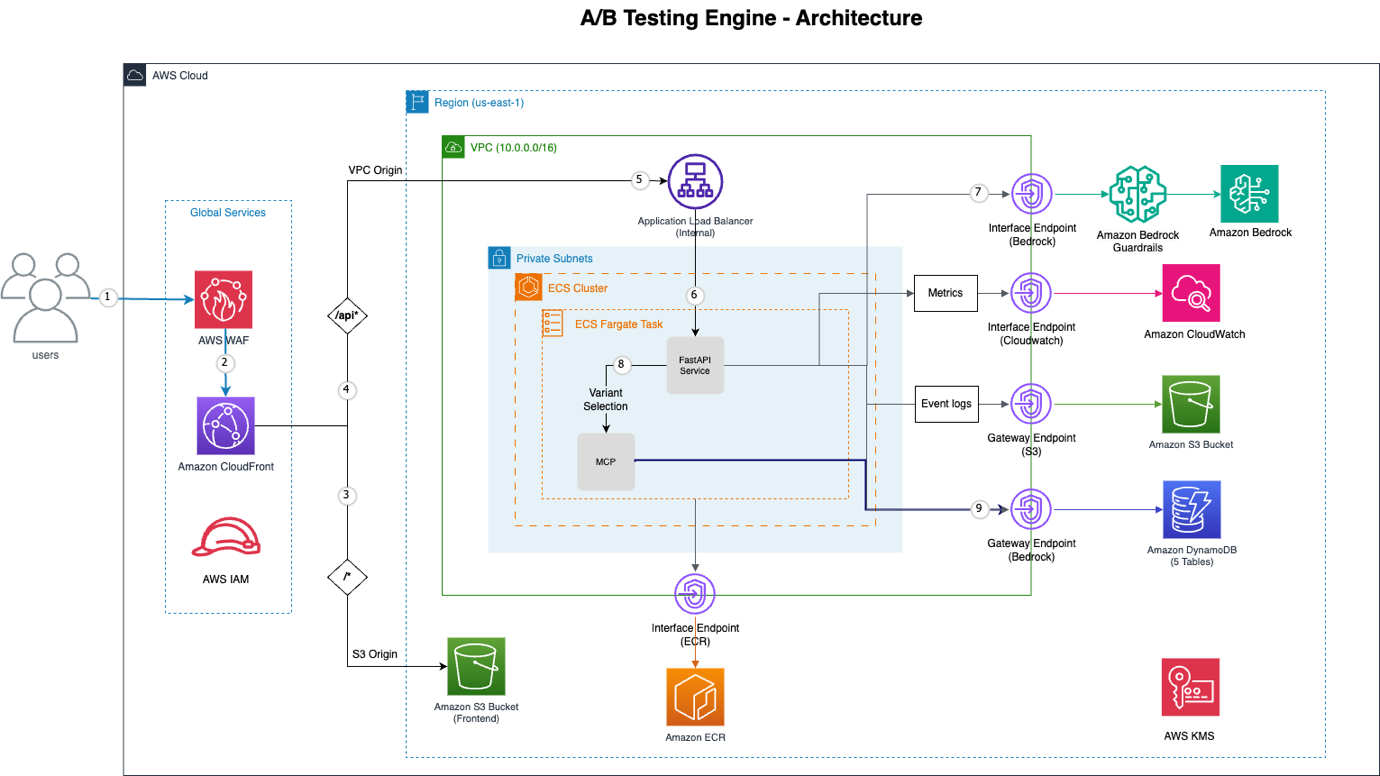

ก้าวเข้าสู่ยุคใหม่ของการทดลอง: ระบบทดสอบ A/B ที่ขับเคลื่อนด้วย AI สร้างขึ้นโดยใช้บริการล้ำสมัย เช่น Amazon Bedrock, Amazon Elastic Container Service (ECS) และ Amazon DynamoDB ระบบนวัตกรรมนี้ก้าวข้ามวิธีการแบบเดิมๆ ด้วยการวิเคราะห์บริบทของผู้ใช้อย่างชาญฉลาดเพื่อทำการตัดสินใจกำหนดตัวแปรที่ปรับเปลี่ยนได้และเป็นส่วนตัวระหว่างการทดลอง ผลลัพธ์คืออะไร? ลดสัญญาณรบกวน ระบุรูปแบบพฤติกรรมที่สำคัญได้เร็วขึ้น และเร่งเส้นทางสู่ข้อสรุปที่มั่นใจได้และขับเคลื่อนด้วยข้อมูลได้อย่างมาก บทความนี้จะสำรวจสถาปัตยกรรมและระเบียบวิธีเบื้องหลังการสร้างระบบดังกล่าว โดยนำเสนอพิมพ์เขียวสำหรับการทดลองที่ปรับขนาดได้ ปรับเปลี่ยนได้ และเป็นส่วนตัว ซึ่งขับเคลื่อนโดยบริการ AWS แบบ serverless

เอาชนะข้อจำกัดของการทดสอบ A/B แบบดั้งเดิม

การทดสอบ A/B แบบดั้งเดิมทำงานบนหลักการที่ตรงไปตรงมา: กำหนดผู้ใช้แบบสุ่มให้กับตัวแปรต่างๆ (A หรือ B) รวบรวมข้อมูล และประกาศผู้ชนะตามเมตริกที่กำหนดไว้ล่วงหน้า แม้ว่าจะเป็นพื้นฐาน แต่แนวทางนี้ก็มีข้อจำกัดโดยธรรมชาติที่อาจขัดขวางการเพิ่มประสิทธิภาพที่รวดเร็วและข้อมูลเชิงลึกที่ลึกซึ้ง:

- การกำหนดแบบสุ่มเท่านั้น: แม้ว่าข้อมูลเริ่มต้นจะบ่งบอกถึงความแตกต่างที่มีความหมายในความต้องการหรือพฤติกรรมของผู้ใช้ แต่การทดสอบ A/B แบบดั้งเดิมก็ยังคงยึดมั่นในการแจกแจงแบบสุ่มอย่างเคร่งครัด ซึ่งหมายความว่าผู้ใช้อาจได้รับตัวแปรที่ด้อยกว่าเป็นระยะเวลานาน แม้ว่าตัวเลือกอื่นจะทำงานได้ดีกว่าสำหรับโปรไฟล์เฉพาะของพวกเขาก็ตาม

- การบรรจบกันที่ช้า: ความจำเป็นในการรวบรวมข้อมูลที่มีนัยสำคัญทางสถิติมักหมายความว่าการทดลองจะดำเนินไปเป็นเวลาหลายสัปดาห์ ความล่าช้านี้อาจทำให้การพัฒนาผลิตภัณฑ์ช้าลง เลื่อนโอกาสในการสร้างรายได้ และทำให้องค์กรเสียเปรียบในการแข่งขัน

- ระดับสัญญาณรบกวนสูง: การกำหนดแบบสุ่มทั้งหมดอาจทำให้ผู้ใช้ได้รับตัวแปรที่ไม่ตรงกับความต้องการหรือความชอบของพวกเขาอย่างชัดเจน "สัญญาณรบกวน" นี้สามารถบดบังข้อมูลเชิงลึกที่แท้จริง ทำให้ยากต่อการแยกแยะกลยุทธ์ที่มีประสิทธิภาพ และบางครั้งต้องมีการวิเคราะห์หลังการทดลองอย่างละเอียดเพื่อแบ่งกลุ่มข้อมูลให้ชัดเจน

- ภาระการเพิ่มประสิทธิภาพด้วยตนเอง: การระบุรูปแบบพฤติกรรมที่ละเอียดอ่อนหรือความชอบเฉพาะกลุ่มมักต้องใช้การวิเคราะห์ด้วยตนเองอย่างมากหลังจากสิ้นสุดการทดลอง แนวทางที่ตอบสนองนี้ใช้เวลานานและมักไม่สามารถใช้ประโยชน์จากสัญญาณเรียลไทม์ได้อย่างมีประสิทธิภาพ

ลองพิจารณาสถานการณ์ในธุรกิจค้าปลีก: บริษัททดสอบปุ่ม Call-to-Action (CTA) สองปุ่ม: "ซื้อเลย" (Variant A) เทียบกับ "ซื้อเลย – ส่งฟรี" (Variant B) ข้อมูลเริ่มต้นอาจแสดงให้เห็นว่า Variant B มีประสิทธิภาพดีกว่า อย่างไรก็ตาม การวิเคราะห์เชิงลึกด้วยตนเองอาจเผยให้เห็นว่าสมาชิกพรีเมียม (ผู้ที่ได้รับส่งฟรีอยู่แล้ว) ลังเลกับ Variant B ในขณะที่นักล่าดีลต่างหลั่งไหลเข้ามาหา ผู้ใช้มือถือในทางกลับกัน อาจชอบ Variant A เนื่องจากขนาดหน้าจอ วิธีการแบบดั้งเดิมจะเฉลี่ยพฤติกรรมที่หลากหลายเหล่านี้เป็นระยะเวลานาน ทำให้ยากต่อการดำเนินการกับความชอบที่ละเอียดอ่อนโดยไม่ต้องมีการแบ่งกลุ่มด้วยตนเองอย่างละเอียดถี่ถ้วน นี่คือจุดที่พลังของการกำหนดที่ช่วยโดย AI กลายเป็นสิ่งประเมินค่าไม่ได้ ช่วยให้สามารถปรับเปลี่ยนแบบเรียลไทม์และได้ผลลัพธ์ A/B testing ที่เหนือกว่า

การออกแบบสถาปัตยกรรมระบบทดสอบ A/B แบบปรับเปลี่ยนได้ด้วย AWS

ระบบ A/B testing แบบปรับเปลี่ยนได้นี้ถือเป็นวิวัฒนาการที่สำคัญจากระบบดั้งเดิม ด้วยการผสานรวมบริบทผู้ใช้แบบเรียลไทม์และรูปแบบพฤติกรรมในช่วงแรก ทำให้สามารถกำหนดตัวแปรได้อย่างชาญฉลาดและมีพลวัตมากขึ้น หัวใจหลักของโซลูชันนี้คือการใช้ประโยชน์จากความสามารถอัจฉริยะของ Amazon Bedrock ซึ่งแทนที่จะกำหนดผู้ใช้ทุกคนให้ใช้ตัวแปรคงที่ Bedrock จะประเมินบริบทของผู้ใช้แต่ละราย ดึงข้อมูลพฤติกรรมในอดีต และเลือกตัวแปรที่เหมาะสมที่สุดสำหรับการโต้ตอบเฉพาะนั้นๆ

ระบบนี้สร้างขึ้นบนสถาปัตยกรรมแบบ serverless ที่แข็งแกร่งภายใน AWS ซึ่งรับประกันความสามารถในการปรับขนาด ความยืดหยุ่น และประสิทธิภาพ:

ภาพที่ 1: สถาปัตยกรรมระบบทดสอบ A/B

นี่คือรายละเอียดส่วนประกอบ AWS หลักที่ทำให้สิ่งนี้เป็นไปได้:

| บริการ AWS | ฟังก์ชันการทำงาน |

|---|---|

| Amazon CloudFront | เครือข่ายการจัดส่งเนื้อหาทั่วโลก (CDN) ที่ให้การป้องกันการโจมตีแบบปฏิเสธการให้บริการแบบกระจาย (DDoS), การป้องกันการโจมตี SQL injection และการจำกัดอัตรา |

| AWS WAF | Web Application Firewall ที่ทำงานร่วมกับ CloudFront เพื่อเพิ่มความปลอดภัย |

| VPC Origin | สร้างการเชื่อมต่อส่วนตัวจาก Amazon CloudFront ไปยัง Application Load Balancer ภายใน โดยกำจัดความเสี่ยงจากการเข้าถึงอินเทอร์เน็ตสาธารณะสำหรับบริการแบ็คเอนด์ |

| Amazon ECS with AWS Fargate | แพลตฟอร์มการจัดการคอนเทนเนอร์แบบ Serverless ที่รันแอปพลิเคชัน FastAPI เพื่อให้มั่นใจถึงความพร้อมใช้งานสูงและความสามารถในการปรับขนาดโดยไม่ต้องจัดการเซิร์ฟเวอร์ |

| Amazon Bedrock | กลไกการตัดสินใจ AI ส่วนกลาง ใช้โมเดลอย่าง Claude Sonnet พร้อมการใช้เครื่องมือพื้นฐานสำหรับการเลือกตัวแปรอัจฉริยะ |

| Model Context Protocol (MCP) | ให้การเข้าถึงข้อมูลพฤติกรรมผู้ใช้และข้อมูลการทดลองแบบมีโครงสร้าง ทำให้ Bedrock สามารถดึงข้อมูลเฉพาะได้อย่างมีประสิทธิภาพ |

| VPC Endpoints | รับประกันการเชื่อมต่อส่วนตัวกับบริการ AWS เช่น Bedrock, DynamoDB, S3, ECR และ CloudWatch เพื่อเพิ่มความปลอดภัยและลดความหน่วง |

| Amazon DynamoDB | ฐานข้อมูล NoSQL แบบ Serverless ที่จัดการเต็มรูปแบบ มี 5 ตารางสำหรับการทดลอง, เหตุการณ์, การมอบหมาย, โปรไฟล์ผู้ใช้ และงานแบตช์ |

| Amazon S3 | ใช้สำหรับการโฮสต์ส่วนหน้าแบบคงที่และการจัดเก็บบันทึกเหตุการณ์ที่ทนทาน ให้ความพร้อมใช้งานสูงและความสามารถในการปรับขนาด |

สถาปัตยกรรมนี้มอบแพลตฟอร์มการทดลองที่ทรงพลังและปรับเปลี่ยนได้ ช่วยให้องค์กรก้าวข้ามข้อจำกัดของการกำหนดแบบสุ่ม และนำแนวทางการทดสอบ A/B ที่ชาญฉลาดอย่างแท้จริงมาใช้

บทบาทของ Amazon Bedrock ในการกำหนดตัวแปรอัจฉริยะ

นวัตกรรมที่แท้จริงของระบบ A/B testing นี้อยู่ที่ความสามารถในการรวมจุดข้อมูลหลายจุด – บริบทผู้ใช้ พฤติกรรมในอดีต รูปแบบจากผู้ใช้ที่คล้ายกัน และเมตริกประสิทธิภาพแบบเรียลไทม์ – เพื่อเลือกตัวแปรที่มีประสิทธิภาพสูงสุด หัวใจของความอัจฉริยะนี้คือ Amazon Bedrock โดยเฉพาะอย่างยิ่งความสามารถในการปรับใช้โมเดล AI เชิงกำเนิดขั้นสูง เช่น Claude Sonnet พร้อมการใช้เครื่องมือพื้นฐาน การผสมผสานที่ทรงพลังนี้ช่วยให้ระบบสามารถเลียนแบบผู้เชี่ยวชาญการทดสอบ A/B โดยทำการตัดสินใจที่ขับเคลื่อนด้วยข้อมูลแบบเรียลไทม์ซึ่งปรับให้เข้ากับการโต้ตอบของผู้ใช้แต่ละราย

เมื่อผู้ใช้เริ่มส่งคำขอตัวแปร ระบบจะไม่เพียงแค่เลือก 'A' หรือ 'B' เท่านั้น แต่จะสร้างพรอมต์ที่ครอบคลุมซึ่งให้ข้อมูลที่จำเป็นทั้งหมดแก่ Amazon Bedrock เพื่อทำการตัดสินใจที่มีข้อมูลครบถ้วนและเหมาะสมที่สุด กระบวนการนี้ใช้ประโยชน์จากความสามารถของ Bedrock ในการตีความคำสั่งที่ซับซ้อนและใช้เครื่องมือที่กำหนดไว้ล่วงหน้าเพื่อรวบรวมบริบทเพิ่มเติม ทำให้มั่นใจว่า AI มีภาพรวมทั้งหมดก่อนที่จะแนะนำการมอบหมาย เพื่อความเข้าใจที่ลึกซึ้งยิ่งขึ้นว่าตัวแทนอัจฉริยะดังกล่าวได้รับการประเมินในการผลิตอย่างไร ลองสำรวจแหล่งข้อมูลเช่น การประเมิน AI Agents สำหรับการผลิต: คู่มือภาคปฏิบัติสำหรับ Strands' Evals

พรอมต์การตัดสินใจของ AI: ความอัจฉริยะเชิงบริบทในการปฏิบัติงาน

ประสิทธิภาพของการตัดสินใจของ Amazon Bedrock ขึ้นอยู่กับโครงสร้างพรอมต์ที่สร้างขึ้นอย่างพิถีพิถันซึ่งใช้แจ้ง AI พรอมต์นี้ประกอบด้วยสองส่วนหลัก: พรอมต์ระบบที่กำหนดบทบาทและพฤติกรรมของ Bedrock และพรอมต์ผู้ใช้ที่ให้ข้อมูลบริบทแบบเรียลไทม์เฉพาะสำหรับการตัดสินใจ การออกแบบนี้ทำให้ AI ทำงานภายในขอบเขตที่กำหนดในขณะที่ใช้ประโยชน์จากข้อมูลที่หลากหลายและเปลี่ยนแปลงได้

นี่คือแนวคิดโครงสร้างพรอมต์ที่ Amazon Bedrock ได้รับ:

# System Prompt (กำหนดบทบาทและพฤติกรรมของ Amazon Bedrock)

system_prompt =

"""

คุณคือผู้เชี่ยวชาญการเพิ่มประสิทธิภาพการทดสอบ A/B ที่มีสิทธิ์เข้าถึงเครื่องมือสำหรับรวบรวมข้อมูลพฤติกรรมผู้ใช้

คำแนะนำที่สำคัญ:

1. ต้องเรียกใช้ get_user_assignment เป็นอันดับแรกเสมอเพื่อตรวจสอบการมอบหมายที่มีอยู่

2. เรียกใช้เครื่องมืออื่น ๆ ก็ต่อเมื่อคุณต้องการข้อมูลเฉพาะเพื่อทำการตัดสินใจที่ดีขึ้น

3. เรียกใช้เครื่องมือตามข้อมูลที่จะมีค่าสำหรับการตัดสินใจเฉพาะนี้

4. หากผู้ใช้มีการมอบหมายอยู่แล้ว ให้รักษามันไว้ เว้นแต่จะมีหลักฐานที่ชัดเจน (การปรับปรุงมากกว่า 30%) ที่จะเปลี่ยนแปลง

5. สำคัญ: การตอบสนองสุดท้ายของคุณจะต้องเป็น JSON ที่ถูกต้องเท่านั้น โดยไม่มีข้อความ คำอธิบาย หรือคำวิจารณ์เพิ่มเติมก่อนหรือหลังวัตถุ JSON

เครื่องมือที่พร้อมใช้งาน:

- get_user_assignment: ตรวจสอบการมอบหมายตัวแปรที่มีอยู่ (เรียกใช้สิ่งนี้เป็นอันดับแรก)

- get_user_profile: รับโปรไฟล์พฤติกรรมและความต้องการของผู้ใช้

- get_similar_users: ค้นหาผู้ใช้ที่มีรูปแบบพฤติกรรมคล้ายกัน

- get_experiment_context: รับการกำหนดค่าและประสิทธิภาพของการทดลอง

- get_session_context: วิเคราะห์พฤติกรรมของเซสชันปัจจุบัน

- get_user_journey: รับประวัติการโต้ตอบของผู้ใช้

- get_variant_performance: รับเมตริกประสิทธิภาพของตัวแปร

- analyze_user_behavior: การวิเคราะห์พฤติกรรมเชิงลึกจากประวัติเหตุการณ์

- update_user_profile: อัปเดตโปรไฟล์ผู้ใช้ด้วยข้อมูลเชิงลึกที่ได้จาก AI

- get_profile_learning_status: ตรวจสอบคุณภาพและความมั่นใจของข้อมูลโปรไฟล์

- batch_update_profiles: อัปเดตโปรไฟล์ผู้ใช้หลายรายการพร้อมกัน

ทำการตัดสินใจอย่างชาญฉลาดและขับเคลื่อนด้วยข้อมูล ใช้เครื่องมือที่คุณต้องการเพื่อรวบรวมบริบทที่เพียงพอสำหรับการเลือกตัวแปรที่เหมาะสมที่สุด

รูปแบบการตอบกลับ: ส่งคืนเฉพาะวัตถุ JSON เท่านั้น ห้ามใส่ข้อความใดๆ ก่อนหรือหลัง

"""

# User Prompt (ให้บริบทการตัดสินใจที่เฉพาะเจาะจง)

prompt = f"""เลือกตัวแปรที่เหมาะสมที่สุดสำหรับผู้ใช้รายนี้ในการทดลอง {experiment_id}

บริบทผู้ใช้:

- ID ผู้ใช้: {user_context.user_id}

- ID เซสชัน: {user_context.session_id}

- อุปกรณ์: {user_context.device_type} (มือถือ: {bool(user_context.is_mobile)})

- หน้าปัจจุบัน: {user_context.current_session.current_page}

- ผู้อ้างอิง: {user_context.current_session.referrer_type or 'direct'}

- ตัวแปรก่อนหน้า: {user_context.current_session.previous_variants or 'None'}

ข้อมูลเชิงลึกบริบท:

{analyze_user_context()}

บริบทส่วนบุคคล:

- คะแนนการมีส่วนร่วม: {profile.engagement_score:.2f}

- โอกาสในการแปลง: {profile.conversion_likelihood:.2f}

- รูปแบบการโต้ตอบ: {profile.interaction_style}

- ตัวแปรที่ประสบความสำเร็จก่อนหน้านี้: {

พรอมต์ที่ครอบคลุมนี้ช่วยให้ Amazon Bedrock ทำหน้าที่เป็นตัวแทนอัจฉริยะ ตัดสินใจอย่างละเอียดอ่อนแทนที่จะอาศัยการกำหนดแบบสุ่มที่หยาบคาย การให้สิทธิ์เข้าถึงเครื่องมือต่างๆ สำหรับการดึงและวิเคราะห์ข้อมูล ทำให้มั่นใจว่าโมเดลมีข้อมูลที่จำเป็นทั้งหมดเพื่อเพิ่มประสิทธิภาพสำหรับความต้องการของผู้ใช้แต่ละรายและเป้าหมายการทดลอง แนวทางนี้ช่วยเพิ่มความแม่นยำและความเร็วของ A/B testing อย่างมาก ผลักดันประสบการณ์ผู้ใช้ที่มีประสิทธิภาพและเป็นส่วนตัวมากขึ้น การใช้เครื่องมือพื้นฐานดังกล่าวเป็นคุณสมบัติที่ทรงพลัง คล้ายกับแนวคิดที่สำรวจใน Amazon Bedrock AgentCore

ปลดล็อกการทดลองที่ปรับขนาดได้และเป็นส่วนตัว

การรวม AI โดยเฉพาะผ่าน Amazon Bedrock เข้ากับระเบียบวิธี A/B testing ถือเป็นการเปลี่ยนแปลงครั้งสำคัญจากการทดลองแบบสุ่มในวงกว้างไปสู่การโต้ตอบที่แม่นยำ ปรับเปลี่ยนได้ และเป็นส่วนตัว ระบบที่ขับเคลื่อนด้วย AI นี้ไม่เพียงแต่ช่วยลดข้อจำกัดของแนวทางแบบดั้งเดิม เช่น การบรรจบกันที่ช้าและสัญญาณรบกวนสูง แต่ยังนำเสนอความสามารถที่ไม่มีใครเทียบได้สำหรับการเพิ่มประสิทธิภาพแบบเรียลไทม์ ด้วยการกำหนดตัวแปรแบบไดนามิกโดยอิงตามบริบทผู้ใช้แต่ละราย ประวัติพฤติกรรม และข้อมูลเชิงลึกเชิงคาดการณ์ องค์กรสามารถบรรลุผลลัพธ์ที่เร็วขึ้น รวบรวมข้อมูลเชิงลึกที่สามารถดำเนินการได้ลึกขึ้น และมอบประสบการณ์ผู้ใช้ที่ปรับแต่งมาอย่างแท้จริง

สถาปัตยกรรมแบบ serverless ที่รองรับโดยบริการ AWS เช่น Amazon ECS Fargate และ Amazon DynamoDB ทำให้มั่นใจได้ว่าระบบที่ซับซ้อนนี้ยังคงปรับขนาดได้และคุ้มค่า สามารถจัดการโหลดที่แตกต่างกันได้โดยไม่ต้องมีการแทรกแซงด้วยตนเอง ความก้าวหน้าทางเทคโนโลยีนี้ช่วยให้บริษัทต่างๆ สามารถก้าวข้ามจากการระบุตัวแปร "ที่ชนะ" สำหรับผู้ชมทั่วไป ไปสู่การทำความเข้าใจว่าอะไรที่โดนใจผู้ใช้แต่ละคนมากที่สุดในแต่ละช่วงเวลา อนาคตของการเพิ่มประสิทธิภาพประสบการณ์ผู้ใช้นั้นปรับเปลี่ยนได้ ชาญฉลาด และขับเคลื่อนด้วย AI อย่างไม่ต้องสงสัย สร้างมาตรฐานใหม่สำหรับการพัฒนาผลิตภัณฑ์และบริการดิจิทัล

คำถามที่พบบ่อย

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

อัปเดตข่าวสาร

รับข่าว AI ล่าสุดในกล่องจดหมายของคุณ