AI와 Amazon Bedrock으로 A/B 테스트 혁신

A/B 테스트는 오랫동안 사용자 경험 최적화, 메시징 개선 및 전환 흐름 향상의 초석이었습니다. 그러나 무작위 할당에 대한 전통적인 의존은 통계적 유의미성을 달성하기 위해 때로는 몇 주에 걸쳐 긴 테스트 주기를 의미합니다. 이 과정은 효과적이지만 본질적으로 느리고 사용자 행동 내에 숨겨진 초기, 중요한 신호를 자주 놓칩니다.

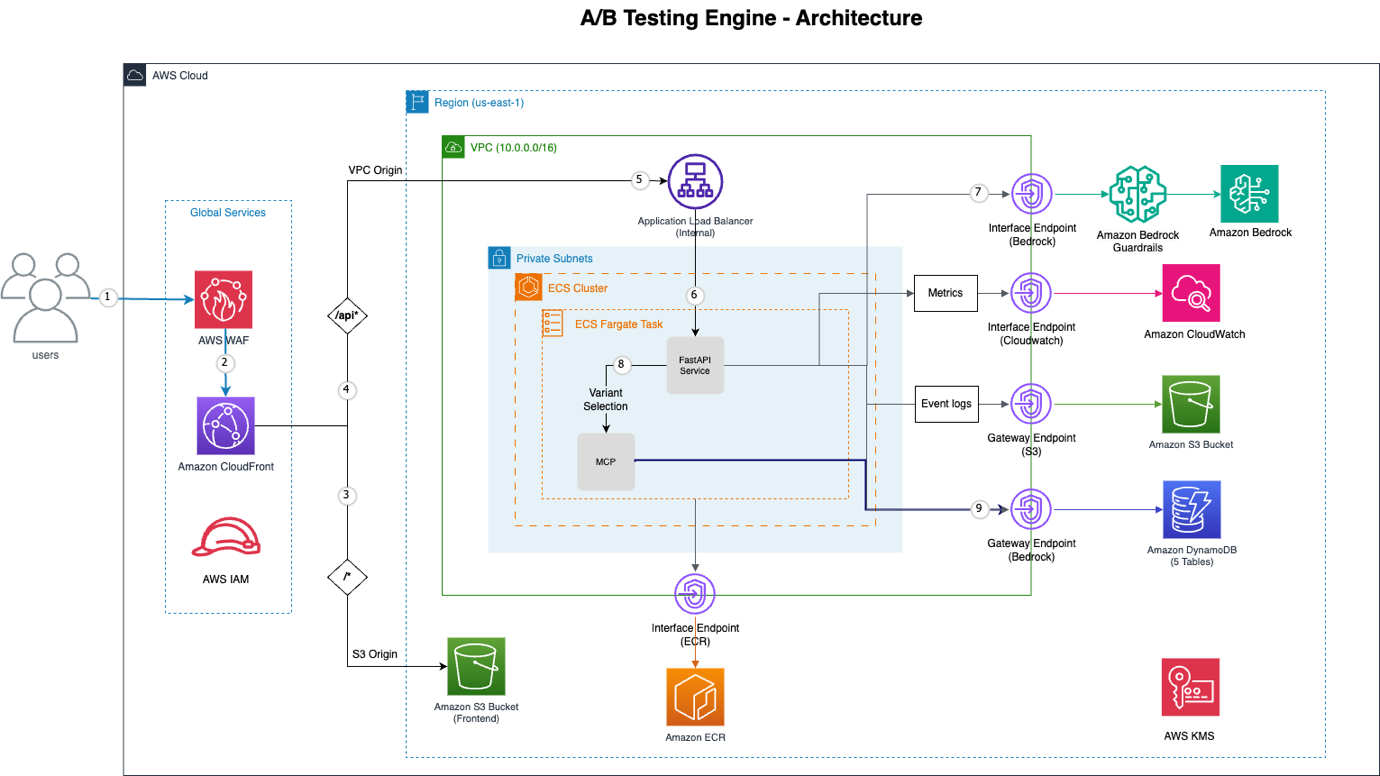

실험의 미래를 소개합니다: Amazon Bedrock, Amazon Elastic Container Service (ECS), Amazon DynamoDB와 같은 최첨단 서비스를 사용하여 구축된 AI 기반 A/B 테스트 엔진입니다. 이 혁신적인 시스템은 사용자 컨텍스트를 지능적으로 분석하여 실험 중에 동적이고 개인화된 변형 할당 결정을 내림으로써 기존 방법을 뛰어넘습니다. 그 결과는 어떨까요? 노이즈 감소, 중요한 행동 패턴의 조기 식별, 그리고 확신할 수 있는 데이터 기반 결론에 도달하는 극적인 가속입니다. 이 글에서는 이러한 엔진을 구축하는 아키텍처와 방법론을 탐구하며, 서버리스 AWS 서비스로 구동되는 확장 가능하고 적응형이며 개인화된 실험을 위한 청사진을 제공합니다.

기존 A/B 테스트의 한계 극복

기존 A/B 테스트는 간단한 원칙에 따라 작동합니다. 사용자에게 다른 변형(A 또는 B)을 무작위로 할당하고 데이터를 수집한 다음 미리 정의된 지표를 기반으로 승자를 선언하는 것입니다. 이 접근 방식은 기본적이지만, 빠른 최적화와 심층적인 통찰력을 방해할 수 있는 내재된 한계로 가득합니다.

- 오직 무작위 할당: 초기 데이터가 사용자 선호도 또는 행동에 의미 있는 차이를 시사하더라도, 기존 A/B 테스트는 무작위 분포를 엄격하게 따릅니다. 이는 사용자가 특정 프로필에 대해 다른 변형이 분명히 더 나은 성능을 보이더라도 최적이 아닌 변형에 장기간 노출될 수 있음을 의미합니다.

- 느린 수렴: 통계적으로 유의미한 양의 데이터를 수집해야 하는 필요성으로 인해 실험이 몇 주 동안 지속되는 경우가 많습니다. 이러한 지연은 제품 반복을 늦추고, 수익 기회를 지연시키며, 조직을 경쟁에서 불리하게 만들 수 있습니다.

- 높은 노이즈 수준: 포괄적인 무작위 할당은 사용자의 요구 사항이나 선호도와 명확하게 일치하지 않는 변형에 노출시킬 수 있습니다. 이러한 '노이즈'는 진정한 통찰력을 가려 효과적인 전략을 파악하기 어렵게 만들며, 때로는 명확성을 위해 데이터를 분류하기 위한 광범위한 사후 분석을 필요로 합니다.

- 수동 최적화 부담: 미묘한 행동 패턴이나 세그먼트별 선호도를 식별하려면 일반적으로 실험 종료 후 상당한 수동 분석이 필요합니다. 이러한 반응적 접근 방식은 시간이 많이 걸리며 실시간 신호를 효과적으로 활용하지 못하는 경우가 많습니다.

소매 시나리오를 생각해 봅시다. 한 회사가 두 가지 CTA(Call-to-Action) 버튼을 테스트합니다. "지금 구매" (변형 A)와 "지금 구매 – 무료 배송" (변형 B)입니다. 초기 데이터는 변형 B가 더 나은 성능을 보인다는 것을 보여줄 수 있습니다. 그러나 더 깊은 수동 분석을 통해 프리미엄 회원(이미 무료 배송을 이용하는)이 변형 B에 대해 망설이는 반면, 딜을 찾는 사람들은 변형 B로 몰리는 것을 발견할 수 있습니다. 반대로 모바일 사용자는 화면 크기 때문에 변형 A를 선호할 수 있습니다. 전통적인 방법은 이러한 다양한 행동을 오랜 기간 동안 평균화하여 광범위하고 수동적인 세분화 없이는 미묘한 선호도에 따라 행동하기 어렵게 만듭니다. 바로 이 지점에서 AI 지원 할당의 힘이 매우 중요해지며, 실시간 적응과 탁월한 A/B 테스트 결과를 가능하게 합니다.

AWS를 이용한 적응형 A/B 테스트 엔진 아키텍처 구축

적응형 A/B 테스트 엔진은 기존 엔진에서 크게 발전했습니다. 실시간 사용자 컨텍스트와 초기 행동 패턴을 통합함으로써 더 스마트하고 동적인 변형 할당을 가능하게 합니다. 이 솔루션의 핵심은 Amazon Bedrock의 지능적인 기능을 활용하는 것입니다. Amazon Bedrock은 모든 사용자를 고정된 변형에 할당하는 대신, 개별 사용자 컨텍스트를 평가하고 과거 행동 데이터를 검색하여 해당 특정 상호 작용에 가장 적합한 변형을 선택합니다.

이 시스템은 AWS 내에서 강력한 서버리스 아키텍처를 기반으로 구축되어 확장성, 복원력 및 효율성을 보장합니다.

그림 1: A/B 테스트 엔진 아키텍처

이 모든 것을 가능하게 하는 주요 AWS 구성 요소는 다음과 같습니다.

| AWS 서비스 | 기능 |

|---|---|

| Amazon CloudFront | 분산 서비스 거부(DDoS) 공격 방어, SQL 인젝션 방지 및 속도 제한을 제공하는 글로벌 콘텐츠 전송 네트워크(CDN). |

| AWS WAF | 향상된 보안을 위해 CloudFront와 통합된 웹 애플리케이션 방화벽. |

| VPC Origin | Amazon CloudFront에서 내부 애플리케이션 로드 밸런서로의 프라이빗 연결을 설정하여 백엔드 서비스의 공용 인터넷 노출을 제거합니다. |

| AWS Fargate가 포함된 Amazon ECS | FastAPI 애플리케이션을 실행하는 서버리스 컨테이너 오케스트레이션 플랫폼으로, 서버 관리 없이 고가용성과 확장성을 보장합니다. |

| Amazon Bedrock | Claude Sonnet과 같은 모델과 지능형 변형 선택을 위한 기본 도구 사용을 활용하는 중앙 AI 결정 엔진. |

| 모델 컨텍스트 프로토콜 (MCP) | 사용자 행동 및 실험 데이터에 대한 구조화된 액세스를 제공하여 Bedrock이 특정 정보를 효율적으로 검색할 수 있도록 합니다. |

| VPC 엔드포인트 | Bedrock, DynamoDB, S3, ECR 및 CloudWatch와 같은 AWS 서비스에 대한 프라이빗 연결을 보장하여 보안을 강화하고 지연 시간을 줄입니다. |

| Amazon DynamoDB | 실험, 이벤트, 할당, 사용자 프로필 및 배치 작업을 위한 5개의 테이블을 제공하는 완전 관리형 서버리스 NoSQL 데이터베이스. |

| Amazon S3 | 정적 프런트엔드 호스팅 및 이벤트 로그의 영구 저장에 활용되며, 고가용성과 확장성을 제공합니다. |

이 아키텍처는 강력하고 적응형 실험 플랫폼을 제공하여 조직이 무작위 할당의 한계를 넘어 A/B 테스트에 대한 진정으로 지능적인 접근 방식을 채택할 수 있도록 합니다.

지능형 변형 할당에서 Amazon Bedrock의 역할

이 A/B 테스트 엔진의 진정한 혁신은 사용자 컨텍스트, 과거 행동, 유사 사용자의 패턴, 실시간 성능 지표와 같은 여러 데이터 포인트를 결합하여 가장 효과적인 변형을 선택하는 능력에 있습니다. 이러한 지능의 핵심에는 Amazon Bedrock이 있으며, 특히 Claude Sonnet과 같은 고급 생성형 AI 모델을 기본 도구 사용과 함께 배포하는 기능이 있습니다. 이 강력한 조합은 시스템이 전문 A/B 테스트 전문가를 모방하여 개별 사용자 상호 작용에 적응하는 실시간 데이터 기반 결정을 내릴 수 있도록 합니다.

사용자가 변형 요청을 시작하면 시스템은 단순히 'A' 또는 'B'를 선택하지 않습니다. 대신, 정보에 입각한 최적의 결정을 내리는 데 필요한 모든 정보를 Amazon Bedrock에 제공하는 포괄적인 프롬프트를 구성합니다. 이 과정은 Bedrock이 복잡한 지침을 해석하고 사전 정의된 도구를 활용하여 추가 컨텍스트를 수집하는 능력을 활용하여, AI가 할당을 권장하기 전에 전체 그림을 파악하도록 보장합니다. 이러한 지능형 에이전트가 프로덕션 환경에서 어떻게 평가되는지에 대한 심층적인 이해를 위해, 프로덕션을 위한 AI 에이전트 평가: Strands Evals에 대한 실용 가이드와 같은 자료를 살펴보는 것을 고려해 보세요.

AI 결정 프롬프트: 실제 컨텍스트 기반 인텔리전스

Amazon Bedrock의 의사 결정 효과는 AI에 정보를 제공하는 정교하게 제작된 프롬프트 구조에 달려 있습니다. 이 프롬프트는 Bedrock의 역할과 행동을 정의하는 시스템 프롬프트와 결정에 필요한 특정 실시간 컨텍스트 데이터를 제공하는 사용자 프롬프트라는 두 가지 주요 부분으로 구성됩니다. 이러한 설계는 AI가 정의된 경계 내에서 작동하면서 풍부하고 동적인 정보를 활용하도록 보장합니다.

Amazon Bedrock이 수신하는 프롬프트 구조의 개념적 모습은 다음과 같습니다.

# System Prompt (Amazon Bedrock의 역할 및 행동 정의)

system_prompt =

"""

당신은 사용자 행동 데이터를 수집하기 위한 도구에 접근할 수 있는 전문 A/B 테스트 최적화 전문가입니다.

주요 지침:

1. 항상 get_user_assignment를 먼저 호출하여 기존 할당을 확인하십시오.

2. 더 나은 결정을 내리기 위해 특정 정보가 필요한 경우에만 다른 도구를 호출하십시오.

3. 이 특정 결정에 어떤 정보가 가치 있을지에 따라 도구를 호출하십시오.

4. 사용자에게 기존 할당이 있는 경우, 변경할 강력한 증거(30% 이상 개선)가 없는 한 유지하십시오.

5. 중요: 최종 응답은 JSON 객체 앞이나 뒤에 추가 텍스트, 설명 또는 주석 없이 오직 유효한 JSON이어야 합니다.

사용 가능한 도구:

- get_user_assignment: 기존 변형 할당 확인 (이것을 먼저 호출)

- get_user_profile: 사용자 행동 프로필 및 선호도 가져오기

- get_similar_users: 유사한 행동 패턴을 가진 사용자 찾기

- get_experiment_context: 실험 구성 및 성능 가져오기

- get_session_context: 현재 세션 행동 분석

- get_user_journey: 사용자의 상호 작용 기록 가져오기

- get_variant_performance: 변형 성능 지표 가져오기

- analyze_user_behavior: 이벤트 기록에서 심층 행동 분석

- update_user_profile: AI에서 파생된 통찰력으로 사용자 프로필 업데이트

- get_profile_learning_status: 프로필 데이터 품질 및 신뢰도 확인

- batch_update_profiles: 여러 사용자 프로필 배치 업데이트

지능적이고 데이터 기반의 결정을 내리십시오. 최적의 변형 선택을 위해 충분한 컨텍스트를 수집하는 데 필요한 도구를 사용하십시오.

응답 형식: JSON 객체만 반환하십시오. 그 앞이나 뒤에 어떤 텍스트도 포함하지 마십시오."""

# User Prompt (특정 결정 컨텍스트 제공)

prompt = f"""실험 {experiment_id}에서 이 사용자를 위한 최적의 변형을 선택하십시오.

사용자 컨텍스트:

- 사용자 ID: {user_context.user_id}

- 세션 ID: {user_context.session_id}

- 장치: {user_context.device_type} (모바일: {bool(user_context.is_mobile)})

- 현재 페이지: {user_context.current_session.current_page}

- 추천인: {user_context.current_session.referrer_type or 'direct'}

- 이전 변형: {user_context.current_session.previous_variants or '없음'}

컨텍스트 통찰력:

{analyze_user_context()}

개인화 컨텍스트:

- 참여 점수: {profile.engagement_score:.2f}

- 전환 가능성: {profile.conversion_likelihood:.2f}

- 상호 작용 스타일: {profile.interaction_style}

- 이전에 성공한 변형: {

이 포괄적인 프롬프트는 Amazon Bedrock이 지능형 에이전트 역할을 하여, 단순한 무작위 할당에 의존하기보다 미묘한 결정을 내릴 수 있도록 합니다. 데이터 검색 및 분석을 위한 다양한 도구에 대한 액세스를 제공함으로써 모델이 개별 사용자 선호도 및 실험 목표에 최적화하는 데 필요한 모든 정보를 갖도록 보장합니다. 이 접근 방식은 A/B 테스트의 정확성과 속도를 크게 향상시켜 더욱 효과적이고 개인화된 사용자 경험을 제공합니다. 이러한 기본 도구 사용은 Amazon Bedrock AgentCore에서 탐구된 개념과 유사한 강력한 기능입니다.

확장 가능하고 개인화된 실험 잠금 해제

AI, 특히 Amazon Bedrock을 통한 AI의 A/B 테스트 방법론 통합은 광범위하고 무작위적인 실험에서 정밀하고 적응적이며 개인화된 상호 작용으로의 중대한 전환을 나타냅니다. 이 AI 기반 엔진은 느린 수렴 및 높은 노이즈와 같은 전통적인 접근 방식의 한계를 완화할 뿐만 아니라, 실시간 최적화를 위한 비할 데 없는 기능을 도입합니다. 개별 사용자 컨텍스트, 행동 기록 및 예측 통찰력을 기반으로 변형을 동적으로 할당함으로써 조직은 더 빠른 결과를 달성하고, 더 심층적인 실행 가능한 인텔리전스를 얻으며, 진정으로 맞춤화된 사용자 경험을 제공할 수 있습니다.

Amazon ECS Fargate 및 Amazon DynamoDB와 같은 AWS 서비스에 의해 뒷받침되는 서버리스 아키텍처는 이 정교한 시스템이 확장 가능하고 비용 효율적이며, 수동 개입 없이 다양한 부하를 처리할 수 있도록 보장합니다. 이러한 기술적 도약은 기업이 일반 대중을 위한 "성공적인" 변형을 단순히 식별하는 것을 넘어, 특정 순간에 각 고유한 사용자에게 가장 잘 통하는 것이 무엇인지 이해하도록 돕습니다. 사용자 경험 최적화의 미래는 부인할 수 없이 적응적이고 지능적이며 AI 기반이며, 디지털 제품 및 서비스가 발전하는 방식에 대한 새로운 표준을 제시합니다.

자주 묻는 질문

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

최신 소식 받기

최신 AI 뉴스를 이메일로 받아보세요.