A/B testēšanas revolucionizēšana ar AI un Amazon Bedrock

A/B testēšana jau sen ir bijusi pamats lietotāju pieredzes optimizēšanai, ziņojumapmaiņas pilnveidošanai un konversijas plūsmu uzlabošanai. Tomēr tās tradicionālā atkarība no nejaušas piešķiršanas bieži vien nozīmē ilgas testēšanas ciklus, kas reizēm ilgst nedēļām, lai tikai sasniegtu statistisko nozīmīgumu. Šis process, lai arī efektīvs, pēc savas būtības ir lēns un bieži vien palaiž garām agrīnus, izšķirošus signālus, kas slēpjas lietotāju uzvedībā.

Ienāciet eksperimentēšanas nākotnē: ar AI darbināts A/B testēšanas dzinējs, kas veidots, izmantojot jaunākos pakalpojumus, piemēram, Amazon Bedrock, Amazon Elastic Container Service (ECS) un Amazon DynamoDB. Šī inovatīvā sistēma pārsniedz tradicionālās metodes, inteliģenti analizējot lietotāja kontekstu, lai pieņemtu dinamiskus, personalizētus variantu piešķiršanas lēmumus eksperimenta laikā. Rezultāts? Samazināts troksnis, agrāka nozīmīgu uzvedības modeļu identificēšana un dramatiski paātrināts ceļš uz pārliecinošiem, uz datiem balstītiem secinājumiem. Šis raksts pētīs šāda dzinēja veidošanas arhitektūru un metodiku, piedāvājot plānu mērogojamai, adaptīvai un personalizētai eksperimentēšanai, ko nodrošina bezservera AWS pakalpojumi.

Tradicionālo A/B testēšanas ierobežojumu pārvarēšana

Tradicionālā A/B testēšana darbojas pēc vienkārša principa: nejauši piešķirt lietotājus dažādiem variantiem (A vai B), savākt datus un pasludināt uzvarētāju, pamatojoties uz iepriekš noteiktiem rādītājiem. Lai gan šī pieeja ir fundamentāla, tai piemīt raksturīgi ierobežojumi, kas var kavēt ātrumu optimizāciju un dziļas atziņas:

- Tikai nejauša piešķiršana: Pat ja agrīnie dati liecina par nozīmīgām atšķirībām lietotāju preferencēs vai uzvedībā, tradicionālā A/B testēšana stingri ievēro nejaušu sadalījumu. Tas nozīmē, ka lietotāji var tikt pakļauti suboptimāliem variantiem ilgstoši, pat ja alternatīva acīmredzami darbojas labāk viņu specifiskajam profilam.

- Lēna konverģence: Nepieciešamība savākt statistiski nozīmīgu datu apjomu bieži nozīmē, ka eksperimenti ievelkas nedēļām ilgi. Šī kavēšanās var palēnināt produktu iterācijas, atlikt ieņēmumu iespējas un radīt organizācijām konkurences trūkumu.

- Augsts trokšņa līmenis: Visaptveroša nejauša piešķiršana var pakļaut lietotājus variantiem, kas skaidri neatbilst viņu vajadzībām vai vēlmēm. Šis 'troksnis' var aizklāt patiesas atziņas, apgrūtinot efektīvu stratēģiju atpazīšanu un dažkārt prasot plašu pēcpārbaudes analīzi, lai segmentētu datus skaidrībai.

- Manuālas optimizācijas slogs: Smalku uzvedības modeļu vai segmentam specifisku preferenču identificēšana parasti prasa ievērojamu manuālu analīzi pēc eksperimenta pabeigšanas. Šī reaktīvā pieeja ir laikietilpīga un bieži vien nespēj efektīvi izmantot reāllaika signālus.

Apsveriet mazumtirdzniecības scenāriju: uzņēmums testē divas aicinājuma uz darbību (CTA) pogas: "Pirkt tūlīt" (variants A) pret "Pirkt tūlīt – bezmaksas piegāde" (variants B). Sākotnējie dati varētu liecināt, ka variants B darbojas labāk. Tomēr dziļāka, manuāla analīze varētu atklāt, ka premium dalībnieki (kuriem jau ir bezmaksas piegāde) vilcinās ar variantu B, savukārt akciju mednieki to izmanto. Mobilie lietotāji, savukārt, varētu dot priekšroku variantam A ekrāna izmēra dēļ. Tradicionālās metodes vidēji aprēķinātu šīs dažādās uzvedības ilgā laika periodā, apgrūtinot rīcību pēc niansētām vēlmēm bez plašas, manuālas segmentācijas. Tieši šeit AI atbalstītas piešķiršanas spēks kļūst nenovērtējams, ļaujot reāllaikā pielāgoties un sasniegt izcilus A/B testēšanas rezultātus.

Adaptīva A/B testēšanas dzinēja arhitektūra ar AWS

Adaptīvais A/B testēšanas dzinējs iezīmē ievērojamu evolūciju no tā tradicionālā priekšgājēja. Integrējot reāllaika lietotāja kontekstu un agrīnus uzvedības modeļus, tas nodrošina gudrākas, dinamiskākas variantu piešķiršanas. Šī risinājuma pamatā ir Amazon Bedrock inteliģentās iespējas, kas, tā vietā, lai katru lietotāju piesaistītu fiksētam variantam, novērtē individuālo lietotāja kontekstu, iegūst vēsturiskos uzvedības datus un izvēlas optimālāko variantu šai konkrētajai mijiedarbībai.

Sistēma ir veidota uz spēcīgas, bezservera arhitektūras AWS vidē, nodrošinot mērogojamību, noturību un efektivitāti:

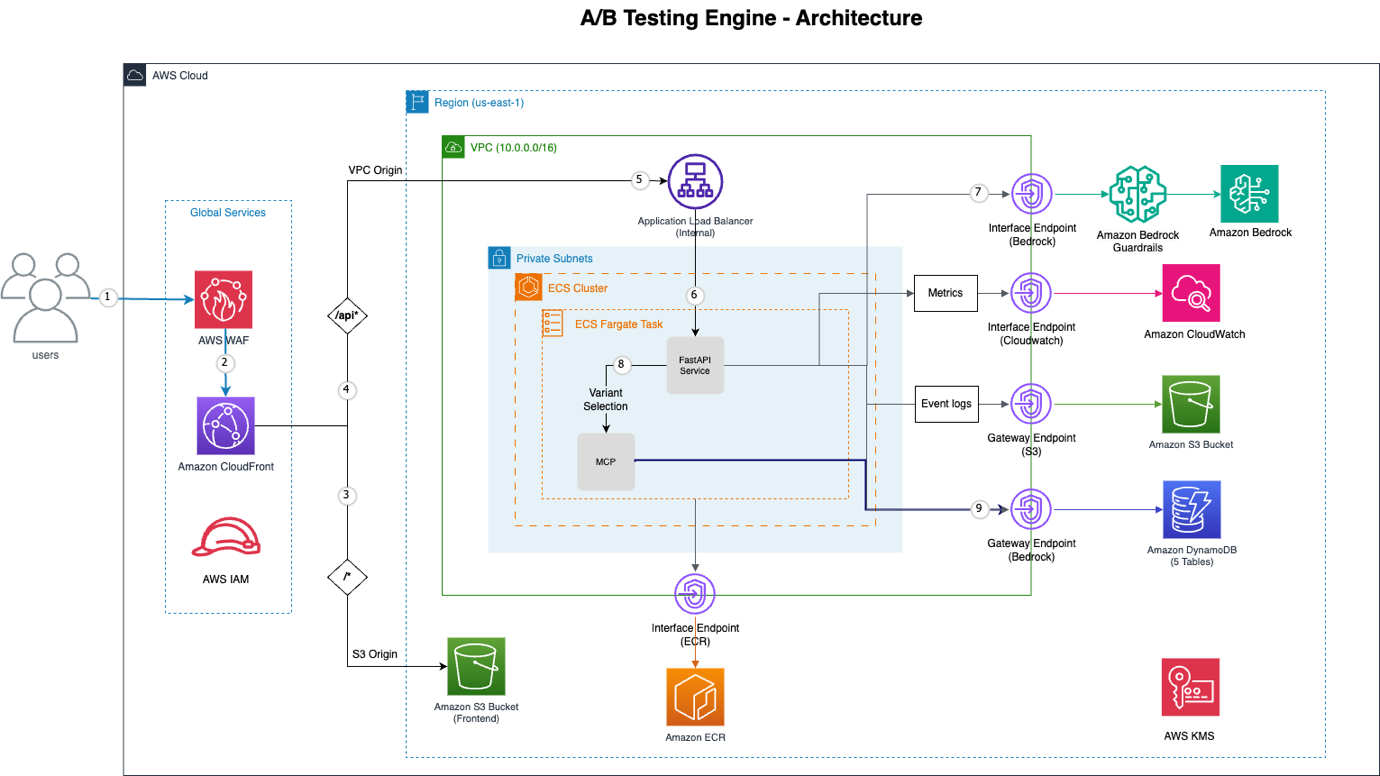

1. attēls: A/B testēšanas dzinēja arhitektūra

Lūk, galveno AWS komponentu apraksts, kas to padara iespējamu:

| AWS Pakalpojums | Funkcionalitāte |

|---|---|

| Amazon CloudFront | Globāls satura piegādes tīkls (CDN), kas nodrošina izplatītu pakalpojumu atteikuma (DDoS) aizsardzību, SQL injekciju novēršanu un ātruma ierobežošanu. |

| AWS WAF | Tīmekļa lietojumprogrammu ugunsmūris, kas integrēts ar CloudFront uzlabotai drošībai. |

| VPC Origin | Izveido privātu savienojumu no Amazon CloudFront uz iekšēju lietojumprogrammu slodzes balansētāju, novēršot publisku interneta piekļuvi aizmugursistēmas pakalpojumiem. |

| Amazon ECS ar AWS Fargate | Bezservera konteineru orķestrēšanas platforma, kas darbina FastAPI lietojumprogrammu, nodrošinot augstu pieejamību un mērogojamību bez serveru pārvaldības. |

| Amazon Bedrock | Centrālais AI lēmumu dzinējs, kas izmanto modeļus kā Claude Sonnet ar vietējo rīku izmantošanu inteliģentai variantu atlasei. |

| Model Context Protocol (MCP) | Nodrošina strukturētu piekļuvi lietotāju uzvedībai un eksperimentu datiem, ļaujot Bedrock efektīvi iegūt specifisku informāciju. |

| VPC Endpoints | Nodrošina privātu savienojamību ar AWS pakalpojumiem, piemēram, Bedrock, DynamoDB, S3, ECR un CloudWatch, uzlabojot drošību un samazinot latentumu. |

| Amazon DynamoDB | Pilnībā pārvaldīta, bezservera NoSQL datu bāze, kas nodrošina piecas tabulas eksperimentiem, notikumiem, piešķiršanām, lietotāju profiliem un partiju darbiem. |

| Amazon S3 | Izmantots statiskajai priekšgala mitināšanai un notikumu žurnālu ilglaicīgai glabāšanai, piedāvājot augstu pieejamību un mērogojamību. |

Šī arhitektūra nodrošina jaudīgu un adaptīvu eksperimentēšanas platformu, ļaujot organizācijām pārsniegt nejaušas piešķiršanas ierobežojumus un pieņemt patiesi inteliģentu pieeju A/B testēšanai.

Amazon Bedrock loma inteliģentā variantu piešķiršanā

Šī A/B testēšanas dzinēja patiesā inovācija slēpjas tā spējā apvienot vairākus datu punktus – lietotāja kontekstu, vēsturisko uzvedību, līdzīgu lietotāju modeļus un reāllaika veiktspējas rādītājus – lai izvēlētos visefektīvāko variantu. Šīs inteliģences pamatā ir Amazon Bedrock, īpaši tā iespējas izvietot progresīvus ģeneratīvās AI modeļus, piemēram, Claude Sonnet, ar vietējo rīku izmantošanu. Šī jaudīgā kombinācija ļauj sistēmai atdarināt ekspertu A/B testēšanas speciālistu, pieņemot reāllaika, uz datiem balstītus lēmumus, kas pielāgojas individuālām lietotāju mijiedarbībām.

Kad lietotājs ierosina varianta pieprasījumu, sistēma vienkārši neizvēlas 'A' vai 'B'. Tā vietā tā izveido visaptverošu uzvedni, kas sniedz Amazon Bedrock visu nepieciešamo informāciju, lai pieņemtu informētu, optimālu lēmumu. Šis process izmanto Bedrock spēju interpretēt sarežģītas instrukcijas un izmantot iepriekš definētus rīkus, lai apkopotu papildu kontekstu, nodrošinot, ka AI ir pilnīgs attēls pirms piešķiršanas ieteikšanas. Lai iegūtu dziļāku izpratni par to, kā šādi inteliģenti aģenti tiek novērtēti ražošanā, apsveriet resursus, piemēram, AI aģentu novērtēšana ražošanā: praktisks ceļvedis Strands Evals.

AI lēmuma uzvedne: kontekstuālā inteliģence darbībā

Amazon Bedrock lēmumu pieņemšanas efektivitāte ir atkarīga no rūpīgi izstrādātās uzvednes struktūras, kas informē AI. Šī uzvedne sastāv no divām galvenajām daļām: sistēmas uzvednes, kas definē Bedrock lomu un uzvedību, un lietotāja uzvednes, kas nodrošina specifiskus, reāllaika kontekstuālos datus lēmuma pieņemšanai. Šis dizains nodrošina, ka AI darbojas noteiktās robežās, vienlaikus izmantojot bagātīgu, dinamisku informāciju.

Lūk, konceptuāls ieskats uzvednes struktūrā, ko saņem Amazon Bedrock:

# Sistēmas uzvedne (definē Amazon Bedrock lomu un uzvedību)

system_prompt =

"""

Jūs esat eksperts A/B testēšanas optimizācijas speciālists ar piekļuvi rīkiem lietotāju uzvedības datu vākšanai.

KRITISKAS INSTRUKCIJAS:

1. VIENMĒR vispirms izsauciet get_user_assignment, lai pārbaudītu esošās piešķiršanas

2. Zvaniet citiem rīkiem tikai tad, ja jums ir nepieciešama specifiska informācija, lai pieņemtu labāku lēmumu

3. Izsauciet rīkus, pamatojoties uz to, kāda informācija būtu vērtīga šim konkrētajam lēmumam

4. Ja lietotājam ir esoša piešķiršana, saglabājiet to, ja vien nav spēcīgu pierādījumu (30%+ uzlabojums), lai to mainītu

5. KRITISKI: Jūsu galīgajai atbildei JĀBŪT TIKAI derīgam JSON bez papildu teksta, paskaidrojumiem vai komentāriem pirms vai pēc JSON objekta

Pieejamie rīki:

- get_user_assignment: Pārbaudīt esošo variantu piešķiršanu (VISPIRMS IZSAUCIET ŠO)

- get_user_profile: Iegūt lietotāja uzvedības profilu un preferences

- get_similar_users: Atrast lietotājus ar līdzīgiem uzvedības modeļiem

- get_experiment_context: Iegūt eksperimenta konfigurāciju un veiktspēju

- get_session_context: Analizēt pašreizējās sesijas uzvedību

- get_user_journey: Iegūt lietotāja mijiedarbības vēsturi

- get_variant_performance: Iegūt variantu veiktspējas rādītājus

- analyze_user_behavior: Dziļa uzvedības analīze no notikumu vēstures

- update_user_profile: Atjaunināt lietotāja profilu ar AI iegūtām atziņām

- get_profile_learning_status: Pārbaudīt profila datu kvalitāti un uzticamību

- batch_update_profiles: Partijas atjaunināšana vairākiem lietotāju profiliem

Pieņemiet inteliģentus, uz datiem balstītus lēmumus. Izmantojiet nepieciešamos rīkus, lai savāktu pietiekamu kontekstu optimālai variantu atlasei.

ATBILDES FORMĀTS: Atgrieziet TIKAI JSON objektu. Neiekļaujiet nekādu tekstu pirms vai pēc tā."""

# Lietotāja uzvedne (nodrošina specifisku lēmuma kontekstu)

prompt = f"""Izvēlieties optimālo variantu šim lietotājam eksperimentā {experiment_id}.

LIETOTĀJA KONTEKSTS:

- Lietotāja ID: {user_context.user_id}

- Sesijas ID: {user_context.session_id}

- Ierīce: {user_context.device_type} (Mobilā: {bool(user_context.is_mobile)})

- Pašreizējā lapa: {user_context.current_session.current_page}

- Atsauces avots: {user_context.current_session.referrer_type or 'direct'}

- Iepriekšējie varianti: {user_context.current_session.previous_variants or 'None'}

KONTEKSTA ATZIŅAS:

{analyze_user_context()}

PERSONALIZĀCIJAS KONTEKSTS:

- Iesaistes rādītājs: {profile.engagement_score:.2f}

- Konversijas iespējamība: {profile.conversion_likelihood:.2f}

- Mijiedarbības stils: {profile.interaction_style}

- Iepriekš veiksmīgi varianti: {

Šī visaptverošā uzvedne dod Amazon Bedrock iespēju darboties kā inteliģentam aģentam, pieņemot niansētus lēmumus, nevis paļaujoties uz rupjām nejaušām piešķiršanām. Nodrošinot piekļuvi dažādiem rīkiem datu iegūšanai un analīzei, tā nodrošina, ka modelim ir visa nepieciešamā informācija, lai optimizētu individuālās lietotāju preferences un eksperimentu mērķus. Šī pieeja būtiski uzlabo A/B testēšanas precizitāti un ātrumu, veicinot efektīvāku un personalizētāku lietotāju pieredzi. Šāda vietējo rīku izmantošana ir jaudīga funkcija, kas līdzīga jēdzieniem, kas pētīti Amazon Bedrock AgentCore.

Mērogojamas un personalizētas eksperimentēšanas atbloķēšana

AI, jo īpaši, izmantojot Amazon Bedrock, integrēšana A/B testēšanas metodoloģijās iezīmē būtisku pāreju no plašiem, nejaušiem eksperimentiem uz precīzām, adaptīvām un personalizētām mijiedarbībām. Šis ar AI darbinātais dzinējs ne tikai mazina tradicionālo pieeju ierobežojumus, piemēram, lēnu konverģenci un augstu troksni, bet arī ievieš nepārspējamas reāllaika optimizācijas iespējas. Dinamiski piešķirot variantus, pamatojoties uz individuālo lietotāja kontekstu, uzvedības vēsturi un paredzamām atziņām, organizācijas var sasniegt ātrākus rezultātus, iegūt dziļāku, rīcībspējīgu inteliģenci un nodrošināt patiesi pielāgotu lietotāju pieredzi.

Bezservera arhitektūra, ko atbalsta tādi AWS pakalpojumi kā Amazon ECS Fargate un Amazon DynamoDB, nodrošina, ka šī sarežģītā sistēma paliek mērogojama un rentabla, spējīga apstrādāt dažādas slodzes bez manuālas iejaukšanās. Šis tehnoloģiskais lēciens ļauj uzņēmumiem ne tikai identificēt "uzvarošu" variantu vispārējai auditorijai, bet arī saprast, kas vislabāk rezonē ar katru unikālu lietotāju jebkurā brīdī. Lietotāju pieredzes optimizācijas nākotne neapšaubāmi ir adaptīva, inteliģenta un darbināta ar AI, nosakot jaunu standartu tam, kā attīstās digitālie produkti un pakalpojumi.

Sākotnējais avots

https://aws.amazon.com/blogs/machine-learning/build-an-ai-powered-a-b-testing-engine-using-amazon-bedrock/Bieži uzdotie jautājumi

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

Esiet informēti

Saņemiet jaunākās AI ziņas savā e-pastā.