Rewolucjonizacja testów A/B dzięki AI i Amazon Bedrock

Testy A/B od dawna stanowią kamień węgielny optymalizacji doświadczeń użytkowników, udoskonalania komunikatów i usprawniania ścieżek konwersji. Jednak ich tradycyjne oparcie na losowym przypisywaniu często oznacza długie cykle testowania, czasem trwające tygodnie, tylko po to, by osiągnąć statystyczną istotność. Ten proces, choć skuteczny, jest z natury powolny i często pomija wczesne, kluczowe sygnały ukryte w zachowaniu użytkowników.

Nadeszła przyszłość eksperymentowania: silnik do testów A/B oparty na AI, zbudowany przy użyciu najnowocześniejszych usług, takich jak Amazon Bedrock, Amazon Elastic Container Service (ECS) i Amazon DynamoDB. Ten innowacyjny system wykracza poza konwencjonalne metody, inteligentnie analizując kontekst użytkownika w celu podejmowania dynamicznych, spersonalizowanych decyzji o przypisaniu wariantów podczas eksperymentu. Rezultat? Zredukowany szum, wcześniejsza identyfikacja znaczących wzorców zachowań i radykalnie przyspieszona ścieżka do pewnych, opartych na danych wniosków. Ten artykuł zbada architekturę i metodologię budowy takiego silnika, oferując plan skalowalnego, adaptacyjnego i spersonalizowanego eksperymentowania, zasilanego przez bezserwerowe usługi AWS.

Pokonywanie ograniczeń tradycyjnych testów A/B

Tradycyjne testowanie A/B działa na prostej zasadzie: losowo przypisuje użytkowników do różnych wariantów (A lub B), zbiera dane i ogłasza zwycięzcę na podstawie zdefiniowanych metryk. Chociaż jest to podejście fundamentalne, jest ono obarczone wrodzonymi ograniczeniami, które mogą utrudniać szybką optymalizację i głębokie spostrzeżenia:

- Wyłącznie Losowe Przypisanie: Nawet gdy wczesne dane wskazują na znaczące różnice w preferencjach lub zachowaniach użytkowników, tradycyjne testy A/B ściśle przestrzegają losowej dystrybucji. Oznacza to, że użytkownicy mogą być wystawieni na suboptymalne warianty przez dłuższy czas, nawet jeśli alternatywa wyraźnie działa lepiej dla ich konkretnego profilu.

- Powolna Konwergencja: Konieczność zebrania statystycznie istotnej ilości danych często oznacza, że eksperymenty ciągną się tygodniami. To opóźnienie może spowolnić iteracje produktów, odroczyć możliwości generowania przychodów i postawić organizacje w niekorzystnej sytuacji konkurencyjnej.

- Wysoki Poziom Szumu: Ogólne losowe przypisanie może narażać użytkowników na warianty, które są wyraźnie niezgodne z ich potrzebami lub preferencjami. Ten "szum" może zaciemniać prawdziwe spostrzeżenia, utrudniając rozróżnienie skutecznych strategii i czasami wymagając obszernej analizy post-hoc w celu segmentacji danych dla jasności.

- Obciążenie Ręczną Optymalizacją: Identyfikacja subtelnych wzorców zachowań lub preferencji specyficznych dla segmentów zazwyczaj wymaga znaczącej ręcznej analizy po zakończeniu eksperymentu. To reaktywne podejście jest czasochłonne i często nie wykorzystuje efektywnie sygnałów w czasie rzeczywistym.

Rozważmy scenariusz detaliczny: firma testuje dwa przyciski Call-to-Action (CTA): "Kup Teraz" (Wariant A) kontra "Kup Teraz – Darmowa Wysyłka" (Wariant B). Początkowe dane mogą wskazywać na lepsze wyniki Wariantu B. Jednak głębsza, manualna analiza mogłaby ujawnić, że członkowie premium (którzy już mają darmową wysyłkę) wahają się przy Wariancie B, podczas gdy łowcy okazji chętnie z niego korzystają. Użytkownicy mobilni natomiast mogą preferować Wariant A ze względu na rozmiar ekranu. Tradycyjne metody uśredniałyby te zróżnicowane zachowania przez długi czas, co utrudniałoby działanie na podstawie subtelnych preferencji bez obszernej, manualnej segmentacji. Właśnie w tym miejscu moc przypisania wspomaganego przez AI staje się bezcenna, umożliwiając adaptację w czasie rzeczywistym i doskonałe wyniki testów A/B.

Architektura Adaptacyjnego Silnika Testów A/B z AWS

Adaptacyjny silnik testów A/B stanowi znaczącą ewolucję w stosunku do swojego tradycyjnego odpowiednika. Poprzez integrację kontekstu użytkownika w czasie rzeczywistym i wczesnych wzorców zachowań, umożliwia on inteligentniejsze, bardziej dynamiczne przypisywanie wariantów. W swojej istocie, to rozwiązanie wykorzystuje inteligentne możliwości Amazon Bedrock, który zamiast przypisywać każdego użytkownika do stałego wariantu, ocenia indywidualny kontekst użytkownika, pobiera historyczne dane behawioralne i wybiera najbardziej optymalny wariant dla tej konkretnej interakcji.

System zbudowany jest na solidnej, bezserwerowej architekturze w ramach AWS, zapewniającej skalowalność, odporność i wydajność:

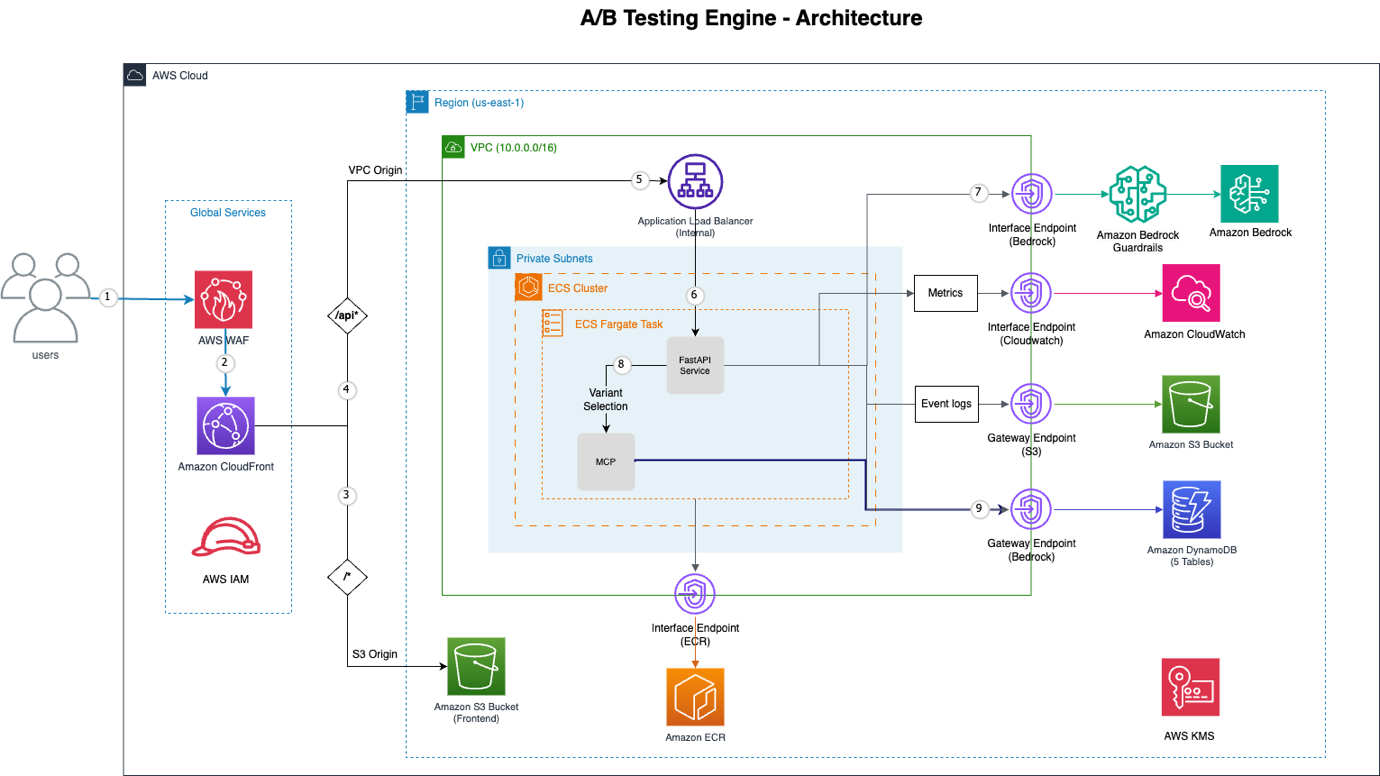

Rysunek 1: Architektura Silnika Testów A/B

Oto zestawienie kluczowych komponentów AWS, które to umożliwiają:

| Usługa AWS | Funkcjonalność |

|---|---|

| Amazon CloudFront | Globalna Sieć Dostarczania Treści (CDN) zapewniająca ochronę przed atakami DDoS, zapobieganie wstrzyknięciom SQL i ograniczanie szybkości. |

| AWS WAF | Zapora Sieciowa Aplikacji (Web Application Firewall) zintegrowana z CloudFront w celu zwiększenia bezpieczeństwa. |

| VPC Origin | Ustanawia prywatne połączenie z Amazon CloudFront do wewnętrznego Application Load Balancer, eliminując ekspozycję usług backendowych na publiczny internet. |

| Amazon ECS z AWS Fargate | Bezserwerowa platforma orkiestracji kontenerów uruchamiająca aplikację FastAPI, zapewniająca wysoką dostępność i skalowalność bez zarządzania serwerami. |

| Amazon Bedrock | Centralny silnik decyzyjny AI, wykorzystujący modele takie jak Claude Sonnet z natywnym użyciem narzędzi do inteligentnego wyboru wariantu. |

| Model Context Protocol (MCP) | Zapewnia ustrukturyzowany dostęp do danych dotyczących zachowań użytkowników i eksperymentów, umożliwiając Bedrockowi efektywne pobieranie konkretnych informacji. |

| Punkty Końcowe VPC (VPC Endpoints) | Zapewnia prywatne połączenie z usługami AWS, takimi jak Bedrock, DynamoDB, S3, ECR i CloudWatch, zwiększając bezpieczeństwo i zmniejszając opóźnienia. |

| Amazon DynamoDB | W pełni zarządzana, bezserwerowa baza danych NoSQL, udostępniająca pięć tabel dla eksperymentów, zdarzeń, przypisań, profili użytkowników i zadań wsadowych. |

| Amazon S3 | Wykorzystywany do hostingu statycznego frontendu i trwałego przechowywania dzienników zdarzeń, oferujący wysoką dostępność i skalowalność. |

Ta architektura dostarcza potężną i adaptacyjną platformę eksperymentacyjną, umożliwiając organizacjom wyjście poza ograniczenia losowego przypisywania i przyjęcie prawdziwie inteligentnego podejścia do testów A/B.

Rola Amazon Bedrock w Inteligentnym Przypisywaniu Wariantów

Prawdziwa innowacja tego silnika testów A/B leży w jego zdolności do łączenia wielu punktów danych – kontekstu użytkownika, historycznych zachowań, wzorców od podobnych użytkowników i metryk wydajności w czasie rzeczywistym – w celu wyboru najskuteczniejszego wariantu. W sercu tej inteligencji znajduje się Amazon Bedrock, w szczególności jego możliwości wdrażania zaawansowanych modeli generatywnej AI, takich jak Claude Sonnet, z natywnym użyciem narzędzi. To potężne połączenie pozwala systemowi na naśladowanie eksperta od testów A/B, podejmując decyzje oparte na danych w czasie rzeczywistym, które dostosowują się do indywidualnych interakcji użytkowników.

Gdy użytkownik inicjuje żądanie wariantu, system nie wybiera po prostu 'A' lub 'B'. Zamiast tego, konstruuje kompleksowy prompt, który dostarcza Amazon Bedrock wszystkich niezbędnych informacji do podjęcia świadomej, optymalnej decyzji. Proces ten wykorzystuje zdolność Bedrocka do interpretowania złożonych instrukcji i używania predefiniowanych narzędzi do zbierania dodatkowego kontekstu, zapewniając, że AI ma pełny obraz przed rekomendowaniem przypisania. Aby głębiej zrozumieć, jak tacy inteligentni agenci są oceniani w produkcji, rozważ zapoznanie się z zasobami takimi jak Ocena agentów AI w produkcji: Praktyczny przewodnik po Evals Strands.

Prompt decyzyjny AI: Inteligencja kontekstowa w działaniu

Skuteczność podejmowania decyzji przez Amazon Bedrock zależy od starannie opracowanej struktury promptu, która dostarcza informacji AI. Prompt ten składa się z dwóch głównych części: promptu systemowego definiującego rolę i zachowanie Bedrocka oraz promptu użytkownika dostarczającego specyficzne, kontekstowe dane w czasie rzeczywistym dla decyzji. Taka konstrukcja zapewnia, że AI działa w określonych granicach, jednocześnie wykorzystując bogate, dynamiczne informacje.

Oto koncepcyjny wygląd struktury promptu, który otrzymuje Amazon Bedrock:

# System Prompt (defines Amazon Bedrock's role and behavior)

system_prompt =

"""

You are an expert A/B testing optimization specialist with access to tools for gathering user behavior data.

CRITICAL INSTRUCTIONS:

1. ALWAYS call get_user_assignment FIRST to check for existing assignments

2. Only call other tools if you need specific information to make a better decision

3. Call tools based on what information would be valuable for this specific decision

4. If user has existing assignment, keep it unless there's strong evidence (30%+ improvement) to change

5. CRITICAL: Your final response MUST be ONLY valid JSON with no additional text, explanations, or commentary before or after the JSON object

Available tools:

- get_user_assignment: Check existing variant assignment (CALL THIS FIRST)

- get_user_profile: Get user behavioral profile and preferences

- get_similar_users: Find users with similar behavior patterns

- get_experiment_context: Get experiment configuration and performance

- get_session_context: Analyze current session behavior

- get_user_journey: Get user's interaction history

- get_variant_performance: Get variant performance metrics

- analyze_user_behavior: Deep behavioral analysis from event history

- update_user_profile: Update user profile with AI-derived insights

- get_profile_learning_status: Check profile data quality and confidence

- batch_update_profiles: Batch update multiple user profiles

Make intelligent, data-driven decisions. Use the tools you need to gather sufficient context for optimal variant selection.

RESPONSE FORMAT: Return ONLY the JSON object. Do not include any text before or after it."""

# User Prompt (provides specific decision context)

prompt = f"""Select the optimal variant for this user in experiment {experiment_id}.

USER CONTEXT:

- User ID: {user_context.user_id}

- Session ID: {user_context.session_id}

- Device: {user_context.device_type} (Mobile: {bool(user_context.is_mobile)})

- Current Page: {user_context.current_session.current_page}

- Referrer: {user_context.current_session.referrer_type or 'direct'}

- Previous Variants: {user_context.current_session.previous_variants or 'None'}

CONTEXT INSIGHTS:

{analyze_user_context()}

PERSONALIZATION CONTEXT:

- Engagement Score: {profile.engagement_score:.2f}

- Conversion Likelihood: {profile.conversion_likelihood:.2f}

- Interaction Style: {profile.interaction_style}

- Previously Successful Variants: {

Ten kompleksowy prompt umożliwia Amazon Bedrock działanie jako inteligentny agent, podejmujący subtelne decyzje, zamiast polegać na prostych losowych przypisaniach. Dzięki zapewnieniu dostępu do różnych narzędzi do pobierania i analizy danych, gwarantuje, że model posiada wszystkie niezbędne informacje do optymalizacji pod kątem indywidualnych preferencji użytkowników i celów eksperymentów. Takie podejście znacząco zwiększa precyzję i szybkość testów A/B, prowadząc do bardziej efektywnych i spersonalizowanych doświadczeń użytkowników. Takie natywne użycie narzędzi to potężna funkcja, podobna do koncepcji badanych w Amazon Bedrock AgentCore.

Odblokowanie Skalowalnego i Spersonalizowanego Eksperymentowania

Integracja AI, w szczególności poprzez Amazon Bedrock, z metodologiami testów A/B oznacza kluczową zmianę z szerokich, losowych eksperymentów na precyzyjne, adaptacyjne i spersonalizowane interakcje. Ten silnik oparty na AI nie tylko łagodzi ograniczenia tradycyjnych podejść – takie jak wolna konwergencja i wysoki poziom szumu – ale także wprowadza niezrównane możliwości optymalizacji w czasie rzeczywistym. Dzięki dynamicznemu przypisywaniu wariantów w oparciu o indywidualny kontekst użytkownika, historię zachowań i prognozowane spostrzeżenia, organizacje mogą osiągać szybsze wyniki, uzyskiwać głębsze, praktyczne informacje i dostarczać prawdziwie dopasowane doświadczenia użytkowników.

Architektura bezserwerowa, wspierana przez usługi AWS, takie jak Amazon ECS Fargate i Amazon DynamoDB, zapewnia, że ten wyrafinowany system pozostaje skalowalny i ekonomiczny, zdolny do obsługi zmiennych obciążeń bez ręcznej interwencji. Ten technologiczny skok umożliwia firmom wyjście poza proste identyfikowanie "zwycięskiego" wariantu dla ogólnej publiczności, w kierunku zrozumienia, co najlepiej rezonuje z każdym unikalnym użytkownikiem w danym momencie. Przyszłość optymalizacji doświadczeń użytkowników jest niezaprzeczalnie adaptacyjna, inteligentna i napędzana przez AI, ustanawiając nowy standard dla ewolucji produktów i usług cyfrowych.

Źródło oryginalne

https://aws.amazon.com/blogs/machine-learning/build-an-ai-powered-a-b-testing-engine-using-amazon-bedrock/Często zadawane pytania

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

Bądź na bieżąco

Otrzymuj najnowsze wiadomości o AI na swoją skrzynkę.