Revolusjonerende A/B-testing med AI og Amazon Bedrock

A/B-testing har lenge vært hjørnesteinen i optimalisering av brukeropplevelser, foredling av meldinger og forbedring av konverteringsflyter. Likevel betyr den tradisjonelle avhengigheten av tilfeldig tildeling ofte lange testsykluser, noen ganger over uker, bare for å oppnå statistisk signifikans. Denne prosessen, selv om den er effektiv, er i sin natur langsom og overser ofte tidlige, avgjørende signaler skjult i brukeratferd.

Møt fremtidens eksperimentering: en AI-drevet A/B-testingmotor bygget med banebrytende tjenester som Amazon Bedrock, Amazon Elastic Container Service (ECS) og Amazon DynamoDB. Dette innovative systemet overgår konvensjonelle metoder ved intelligent å analysere brukerkontekst for å ta dynamiske, personaliserte beslutninger om varianttildeling under et eksperiment. Resultatet? Redusert støy, tidligere identifisering av signifikante atferdsmønstre, og en dramatisk akselerert vei til selvsikre, datadrevne konklusjoner. Denne artikkelen vil utforske arkitekturen og metodikken bak byggingen av en slik motor, og tilbyr en blåkopi for skalerbar, adaptiv og personalisert eksperimentering drevet av serverløse AWS-tjenester.

Overvinne begrensningene ved tradisjonell A/B-testing

Tradisjonell A/B-testing opererer etter et enkelt prinsipp: tilfeldig tildele brukere til forskjellige varianter (A eller B), samle inn data og erklære en vinner basert på forhåndsdefinerte målinger. Selv om dette er grunnleggende, er denne tilnærmingen full av iboende begrensninger som kan hindre rask optimalisering og dyp innsikt:

- Kun tilfeldig tildeling: Selv når tidlige data antyder meningsfulle forskjeller i brukerpreferanser eller atferd, holder tradisjonell A/B-testing seg strengt til tilfeldig distribusjon. Dette betyr at brukere kan bli utsatt for suboptimale varianter over lengre perioder, selv om et alternativ tydelig presterer bedre for deres spesifikke profil.

- Langsom konvergens: Nødvendigheten av å samle et statistisk signifikant datavolum betyr ofte at eksperimenter trekker ut i uker. Denne forsinkelsen kan bremse produktiterasjoner, utsette inntektsmuligheter og sette organisasjoner i en konkurranseulempe.

- Høyt støynivå: En generell tilfeldig tildeling kan utsette brukere for varianter som tydelig er feiljustert med deres behov eller preferanser. Denne "støyen" kan skjule ekte innsikt, noe som gjør det vanskeligere å skjelne effektive strategier og noen ganger krever omfattende post-hoc analyse for å segmentere data for klarhet.

- Manuell optimaliseringsbyrde: Å identifisere nyanserte atferdsmønstre eller segmentspesifikke preferanser krever vanligvis betydelig manuell analyse etter at eksperimentet er avsluttet. Denne reaktive tilnærmingen er tidkrevende og klarer ofte ikke å utnytte sanntidssignaler effektivt.

Tenk på et detaljhandelscenario: et selskap tester to Call-to-Action (CTA) knapper: "Kjøp nå" (Variant A) vs. "Kjøp nå – Gratis frakt" (Variant B). Innledende data kan vise at Variant B overpresterer. Imidlertid kan en dypere, manuell analyse avsløre at premium-medlemmer (som allerede har gratis frakt) nøler med Variant B, mens tilbudsjegere strømmer til den. Mobilbrukere, derimot, foretrekker kanskje Variant A på grunn av skjermstørrelsen. Tradisjonelle metoder ville i gjennomsnitt ha tatt hensyn til disse forskjellige atferdene over en lang periode, noe som gjør det vanskelig å handle basert på nyanserte preferanser uten omfattende, manuell segmentering. Dette er nettopp der kraften i AI-assistert tildeling blir uvurderlig, og tillater sanntids tilpasning og overlegne A/B-testing resultater.

Arkitektur for en adaptiv A/B-testingmotor med AWS

Den adaptive A/B-testingmotoren markerer en betydelig utvikling fra sin tradisjonelle motpart. Ved å integrere sanntids brukerkontekst og tidlige atferdsmønstre, muliggjør den smartere, mer dynamiske varianttildelinger. I kjernen utnytter denne løsningen de intelligente egenskapene til Amazon Bedrock, som, i stedet for å tildele hver bruker til en fast variant, evaluerer individuell brukerkontekst, henter historiske atferdsdata og velger den mest optimale varianten for den spesifikke interaksjonen.

Systemet er bygget på en robust, serverløs arkitektur innenfor AWS, som sikrer skalerbarhet, motstandskraft og effektivitet:

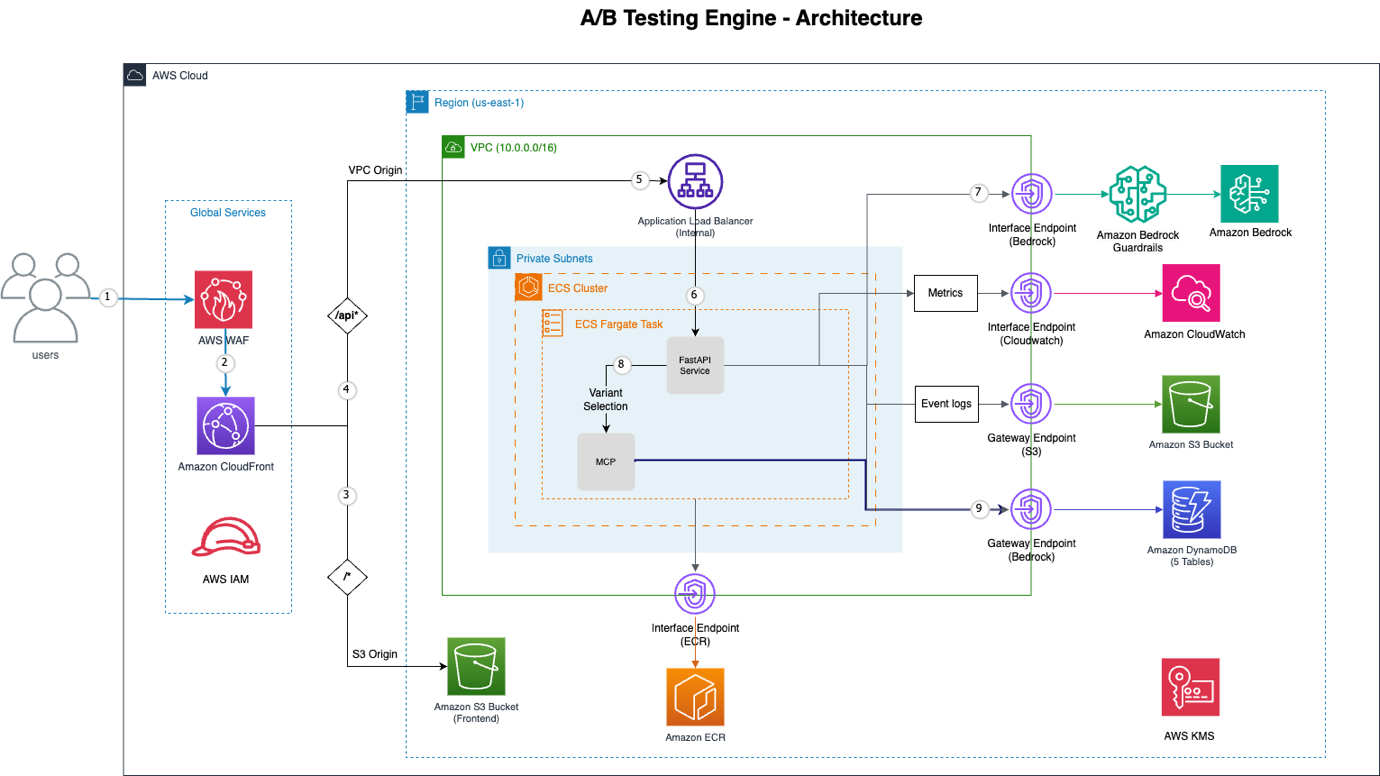

Figur 1: A/B-testingmotorens arkitektur

Her er en oversikt over de viktigste AWS-komponentene som gjør dette mulig:

| AWS-tjeneste | Funksjonalitet |

|---|---|

| Amazon CloudFront | Globalt innholdsleveringsnettverk (CDN) som tilbyr DDoS-beskyttelse (distributed denial-of-service), SQL-injeksjonsavskrekking og hastighetsbegrensning. |

| AWS WAF | Web Application Firewall integrert med CloudFront for forbedret sikkerhet. |

| VPC Origin | Etablerer en privat forbindelse fra Amazon CloudFront til en intern Application Load Balancer, og eliminerer eksponering for offentlig internett for backend-tjenester. |

| Amazon ECS med AWS Fargate | Serverløs containerorkestreringsplattform som kjører FastAPI-applikasjonen, og sikrer høy tilgjengelighet og skalerbarhet uten å måtte administrere servere. |

| Amazon Bedrock | Den sentrale AI-beslutningsmotoren, som bruker modeller som Claude Sonnet med native verktøybruk for intelligent variantvalg. |

| Model Context Protocol (MCP) | Gir strukturert tilgang til brukeratferd og eksperimentdata, slik at Bedrock effektivt kan hente spesifikk informasjon. |

| VPC Endpoints | Sikrer privat tilkobling til AWS-tjenester som Bedrock, DynamoDB, S3, ECR og CloudWatch, noe som forbedrer sikkerheten og reduserer latens. |

| Amazon DynamoDB | En fullt administrert, serverløs NoSQL-database som tilbyr fem tabeller for eksperimenter, hendelser, tildelinger, brukerprofiler og batch-jobber. |

| Amazon S3 | Brukes for statisk frontend-hosting og varig lagring av hendelseslogger, og tilbyr høy tilgjengelighet og skalerbarhet. |

Denne arkitekturen leverer en kraftig og adaptiv eksperimenteringsplattform, som gjør det mulig for organisasjoner å bevege seg utover begrensningene ved tilfeldig tildeling og omfavne en virkelig intelligent tilnærming til A/B-testing.

Amazon Bedrocks rolle i intelligent varianttildeling

Den virkelige innovasjonen i denne A/B-testingmotoren ligger i dens evne til å kombinere flere datapunkter – brukerkontekst, historisk atferd, mønstre fra lignende brukere og sanntids ytelsesmålinger – for å velge den mest effektive varianten. I kjernen av denne intelligensen er Amazon Bedrock, spesielt dens evner til å distribuere avanserte generative AI-modeller som Claude Sonnet med native verktøybruk. Denne kraftige kombinasjonen gjør at systemet kan etterligne en ekspert A/B-testing spesialist, og ta sanntids, datadrevne beslutninger som tilpasser seg individuelle brukerinteraksjoner.

Når en bruker initierer en variantforespørsel, velger systemet ikke bare 'A' eller 'B'. I stedet konstruerer det en omfattende instruks som gir Amazon Bedrock all nødvendig informasjon for å ta en informert, optimal beslutning. Denne prosessen utnytter Bedrocks evne til å tolke komplekse instruksjoner og bruke forhåndsdefinerte verktøy for å samle ytterligere kontekst, noe som sikrer at AI har det fulle bildet før den anbefaler en tildeling. For en dypere forståelse av hvordan slike intelligente agenter evalueres i produksjon, kan du utforske ressurser som Evaluering av AI-agenter for produksjon: En praktisk guide til Strands' Evals.

AI-beslutningsinstruksen: Kontekstuell intelligens i aksjon

Effektiviteten av Amazon Bedrocks beslutningstaking avhenger av den omhyggelig utformede instruksstrukturen som informerer AI-en. Denne instruksen består av to hoveddeler: en systeminstruks som definerer Bedrocks rolle og atferd, og en brukerinstruks som gir spesifikke, sanntids kontekstuelle data for beslutningen. Denne utformingen sikrer at AI opererer innenfor definerte grenser mens den utnytter rik, dynamisk informasjon.

Her er et konseptuelt blikk på instruksstrukturen som Amazon Bedrock mottar:

# System Prompt (definerer Amazon Bedrocks rolle og atferd)

system_prompt =

"""

Du er en ekspert på A/B-testingoptimalisering med tilgang til verktøy for å samle inn brukeratferdsdata.

KRITISKE INSTRUKSJONER:

1. KALL ALLTID get_user_assignment FØRST for å sjekke eksisterende tildelinger

2. Kall kun andre verktøy hvis du trenger spesifikk informasjon for å ta en bedre beslutning

3. Kall verktøy basert på hvilken informasjon som ville være verdifull for denne spesifikke beslutningen

4. Hvis brukeren har en eksisterende tildeling, behold den med mindre det er sterke bevis (30%+ forbedring) for å endre den

5. KRITISK: Ditt endelige svar MÅ KUN være gyldig JSON uten ekstra tekst, forklaringer eller kommentarer før eller etter JSON-objektet

Tilgjengelige verktøy:

- get_user_assignment: Sjekk eksisterende varianttildeling (KALL DENNE FØRST)

- get_user_profile: Hent brukerens atferdsprofil og preferanser

- get_similar_users: Finn brukere med lignende atferdsmønstre

- get_experiment_context: Hent eksperimentkonfigurasjon og ytelse

- get_session_context: Analyser nåværende sesjonsatferd

- get_user_journey: Hent brukerens interaksjonshistorikk

- get_variant_performance: Hent variantens ytelsesmålinger

- analyze_user_behavior: Dyp atferdsanalyse fra hendelseshistorikk

- update_user_profile: Oppdater brukerprofil med AI-avledet innsikt

- get_profile_learning_status: Sjekk profildatakvalitet og konfidens

- batch_update_profiles: Batch-oppdater flere brukerprofiler

Ta intelligente, datadrevne beslutninger. Bruk verktøyene du trenger for å samle tilstrekkelig kontekst for optimalt variantvalg.

SVARSFORMAT: Returner KUN JSON-objektet. Ikke inkluder tekst før eller etter det."""

# User Prompt (gir spesifikk beslutningskontekst)

prompt = f"""Velg den optimale varianten for denne brukeren i eksperiment {experiment_id}.

BRUKERKONTEKST:

- Bruker-ID: {user_context.user_id}

- Sesjons-ID: {user_context.session_id}

- Enhet: {user_context.device_type} (Mobil: {bool(user_context.is_mobile)})

- Nåværende side: {user_context.current_session.current_page}

- Henviser: {user_context.current_session.referrer_type or 'direkte'}

- Tidligere varianter: {user_context.current_session.previous_variants or 'Ingen'}

KONTEKSTINNSIDDER:

{analyze_user_context()}

PERSONALISERINGS KONTEKST:

- Engasjementsscore: {profile.engagement_score:.2f}

- Konverteringssannsynlighet: {profile.conversion_likelihood:.2f}

- Interaksjonsstil: {profile.interaction_style}

- Tidligere vellykkede varianter: {

Denne omfattende instruksen gir Amazon Bedrock mulighet til å fungere som en intelligent agent, og ta nyanserte beslutninger i stedet for å stole på grove tilfeldige tildelinger. Ved å gi tilgang til ulike verktøy for datahenting og analyse, sikrer den at modellen har all nødvendig informasjon for å optimalisere for individuelle brukerpreferanser og eksperimentmål. Denne tilnærmingen forbedrer presisjonen og hastigheten av A/B-testing betydelig, og driver mer effektive og personaliserte brukeropplevelser. Slik native verktøybruk er en kraftig funksjon, lignende konsepter utforsket i Amazon Bedrock AgentCore.

Frigjøre skalerbar og personalisert eksperimentering

Integreringen av AI, spesielt gjennom Amazon Bedrock, i A/B-testingmetoder markerer et avgjørende skifte fra brede, randomiserte eksperimenter til presise, adaptive og personaliserte interaksjoner. Denne AI-drevne motoren reduserer ikke bare begrensningene ved tradisjonelle tilnærminger – som langsom konvergens og høy støy – men introduserer også uovertrufne muligheter for sanntidsoptimalisering. Ved dynamisk å tildele varianter basert på individuell brukerkontekst, atferdshistorikk og prediktive innsikter, kan organisasjoner oppnå raskere resultater, hente dypere handlingsbar intelligens og levere virkelig skreddersydde brukeropplevelser.

Den serverløse arkitekturen støttet av AWS-tjenester som Amazon ECS Fargate og Amazon DynamoDB sikrer at dette sofistikerte systemet forblir skalerbart og kostnadseffektivt, i stand til å håndtere varierende belastninger uten manuell inngripen. Dette teknologiske spranget gjør at selskaper kan bevege seg utover å bare identifisere en "vinnende" variant for et generelt publikum, mot å forstå hva som resonerer best med hver unike bruker til enhver tid. Fremtiden for optimalisering av brukeropplevelsen er ubestridelig adaptiv, intelligent og AI-drevet, og setter en ny standard for hvordan digitale produkter og tjenester utvikles.

Opprinnelig kilde

https://aws.amazon.com/blogs/machine-learning/build-an-ai-powered-a-b-testing-engine-using-amazon-bedrock/Ofte stilte spørsmål

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

Hold deg oppdatert

Få de siste AI-nyhetene i innboksen din.