Rivoluzionare l'A/B Testing con l'AI e Amazon Bedrock

L'A/B testing è stato a lungo la pietra angolare dell'ottimizzazione delle esperienze utente, del perfezionamento della messaggistica e del miglioramento dei flussi di conversione. Tuttavia, la sua dipendenza tradizionale dall'assegnazione casuale spesso comporta cicli di test lunghi, a volte della durata di settimane, solo per raggiungere la significatività statistica. Questo processo, sebbene efficace, è intrinsecamente lento e spesso non coglie segnali precoci e cruciali nascosti nel comportamento degli utenti.

Entra in gioco il futuro della sperimentazione: un motore di A/B testing basato sull'AI costruito utilizzando servizi all'avanguardia come Amazon Bedrock, Amazon Elastic Container Service (ECS) e Amazon DynamoDB. Questo sistema innovativo trascende i metodi convenzionali analizzando in modo intelligente il contesto dell'utente per prendere decisioni dinamiche e personalizzate sull'assegnazione delle varianti durante un esperimento. Il risultato? Rumore ridotto, identificazione più precoce di pattern comportamentali significativi e un percorso drasticamente accelerato verso conclusioni affidabili e basate sui dati. Questo articolo esplorerà l'architettura e la metodologia alla base della costruzione di un tale motore, offrendo un modello per una sperimentazione scalabile, adattiva e personalizzata, alimentata da servizi AWS serverless.

Superare le Limitazioni dell'A/B Testing Tradizionale

L'A/B testing tradizionale opera su un principio semplice: assegnare casualmente gli utenti a diverse varianti (A o B), raccogliere dati e dichiarare un vincitore basandosi su metriche predefinite. Sebbene fondamentale, questo approccio è pieno di limitazioni intrinseche che possono ostacolare un'ottimizzazione rapida e insight approfonditi:

- Assegnazione Puramente Casuale: Anche quando i dati iniziali suggeriscono differenze significative nelle preferenze o nei comportamenti degli utenti, l'A/B testing tradizionale aderisce strettamente alla distribuzione casuale. Ciò significa che gli utenti potrebbero essere esposti a varianti subottimali per periodi prolungati, anche se un'alternativa funziona chiaramente meglio per il loro profilo specifico.

- Convergenza Lenta: La necessità di raccogliere un volume di dati statisticamente significativo spesso implica che gli esperimenti si prolunghino per settimane. Questo ritardo può rallentare le iterazioni del prodotto, posticipare opportunità di guadagno e mettere le organizzazioni in una posizione di svantaggio competitivo.

- Elevato Livello di Rumore: Un'assegnazione casuale indiscriminata può esporre gli utenti a varianti che sono chiaramente disallineate con le loro esigenze o preferenze. Questo "rumore" può oscurare insight genuini, rendendo più difficile discernere strategie efficaci e talvolta richiedendo un'estesa analisi post-hoc per segmentare i dati per chiarezza.

- Carico di Ottimizzazione Manuale: L'identificazione di pattern comportamentali sfumati o preferenze specifiche di segmento richiede tipicamente un'analisi manuale significativa dopo la conclusione dell'esperimento. Questo approccio reattivo è dispendioso in termini di tempo e spesso non riesce a sfruttare efficacemente i segnali in tempo reale.

Consideriamo uno scenario di vendita al dettaglio: un'azienda testa due pulsanti Call-to-Action (CTA): "Acquista Ora" (Variante A) vs. "Acquista Ora – Spedizione Gratuita" (Variante B). I dati iniziali potrebbero mostrare che la Variante B supera la performance. Tuttavia, un'analisi più approfondita e manuale potrebbe rivelare che i membri premium (che hanno già la spedizione gratuita) esitano con la Variante B, mentre i cacciatori di offerte vi si riversano. Gli utenti mobili, al contrario, potrebbero preferire la Variante A a causa delle dimensioni dello schermo. I metodi tradizionali farebbero una media di questi diversi comportamenti per un lungo periodo, rendendo difficile agire su preferenze sfumate senza una segmentazione estesa e manuale. È proprio qui che il potere dell'assegnazione assistita dall'AI diventa inestimabile, consentendo l'adattamento in tempo reale e risultati di A/B testing superiori.

Architettare un Motore di A/B Testing Adattivo con AWS

Il motore di A/B testing adattivo segna un'evoluzione significativa rispetto alla sua controparte tradizionale. Integrando il contesto utente in tempo reale e i pattern comportamentali iniziali, consente assegnazioni di varianti più intelligenti e dinamiche. Al suo nucleo, questa soluzione sfrutta le capacità intelligenti di Amazon Bedrock che, invece di assegnare ogni utente a una variante fissa, valuta il contesto individuale dell'utente, recupera i dati comportamentali storici e seleziona la variante più ottimale per quella specifica interazione.

Il sistema è costruito su un'architettura robusta e serverless all'interno di AWS, garantendo scalabilità, resilienza ed efficienza:

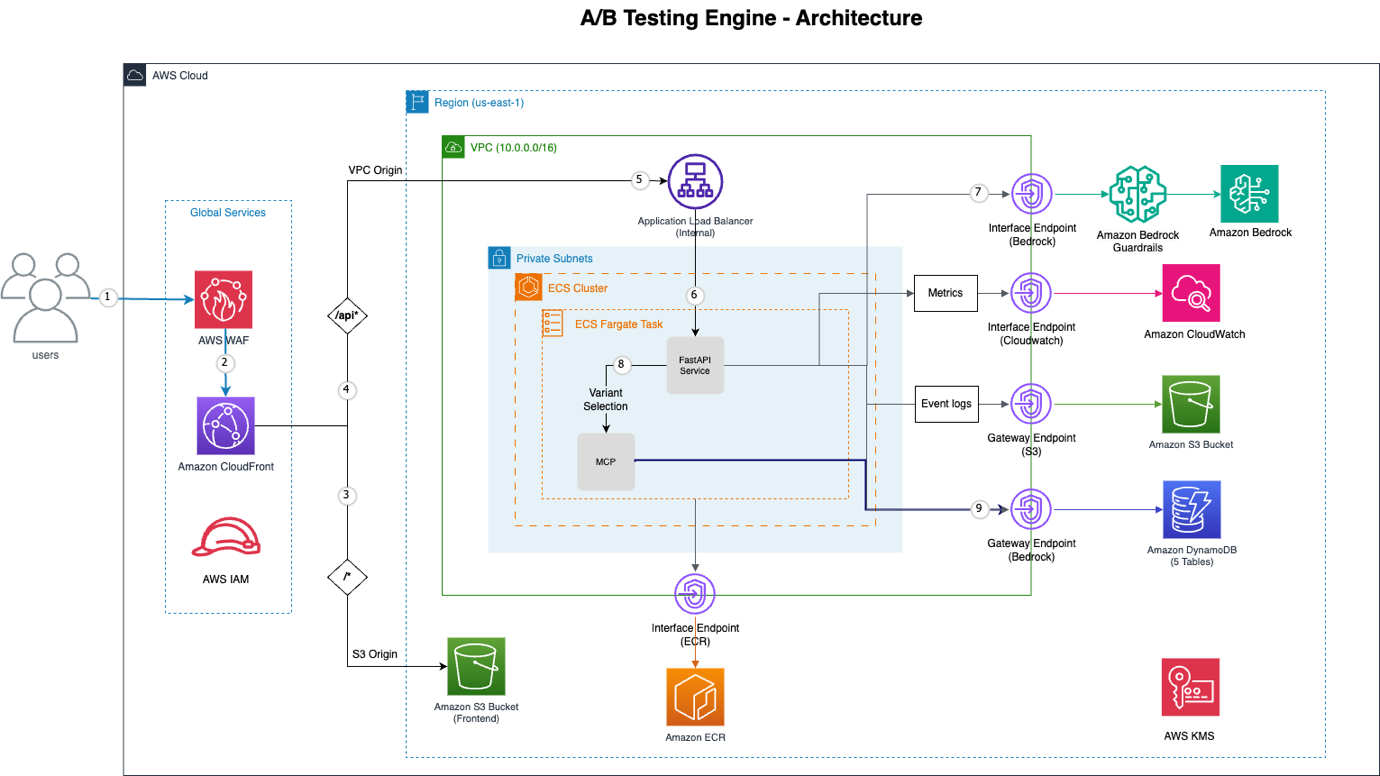

Figura 1: Architettura del Motore di A/B Testing

Ecco una ripartizione dei componenti AWS chiave che rendono tutto questo possibile:

| Servizio AWS | Funzionalità |

|---|---|

| Amazon CloudFront | Content Delivery Network (CDN) globale che fornisce protezione contro attacchi DDoS (Distributed Denial-of-Service), deterrenza contro l'SQL injection e limitazione della velocità. |

| AWS WAF | Web Application Firewall integrato con CloudFront per una sicurezza migliorata. |

| VPC Origin | Stabilisce una connessione privata da Amazon CloudFront a un Application Load Balancer interno, eliminando l'esposizione a internet pubblica per i servizi di backend. |

| Amazon ECS con AWS Fargate | Piattaforma di orchestrazione di container serverless che esegue l'applicazione FastAPI, garantendo alta disponibilità e scalabilità senza gestire server. |

| Amazon Bedrock | Il motore decisionale AI centrale, che utilizza modelli come Claude Sonnet con uso nativo di strumenti per la selezione intelligente delle varianti. |

| Protocollo di Contesto del Modello (MCP) | Fornisce accesso strutturato ai dati comportamentali degli utenti e degli esperimenti, consentendo a Bedrock di recuperare informazioni specifiche in modo efficiente. |

| VPC Endpoints | Garantisce connettività privata ai servizi AWS come Bedrock, DynamoDB, S3, ECR e CloudWatch, migliorando la sicurezza e riducendo la latenza. |

| Amazon DynamoDB | Un database NoSQL completamente gestito e serverless che fornisce cinque tabelle per esperimenti, eventi, assegnazioni, profili utente e lavori batch. |

| Amazon S3 | Utilizzato per l'hosting frontend statico e l'archiviazione durevole dei log degli eventi, offrendo alta disponibilità e scalabilità. |

Questa architettura offre una piattaforma di sperimentazione potente e adattiva, consentendo alle organizzazioni di superare le limitazioni dell'assegnazione casuale e di adottare un approccio veramente intelligente all'A/B testing.

Il Ruolo di Amazon Bedrock nell'Assegnazione Intelligente delle Varianti

La vera innovazione di questo motore di A/B testing risiede nella sua capacità di combinare molteplici punti dati – contesto utente, comportamento storico, pattern da utenti simili e metriche di performance in tempo reale – per scegliere la variante più efficace. Al centro di questa intelligenza c'è Amazon Bedrock, in particolare le sue capacità per il deployment di modelli avanzati di AI generativa come Claude Sonnet con uso nativo di strumenti. Questa potente combinazione consente al sistema di imitare uno specialista esperto di A/B testing, prendendo decisioni in tempo reale e basate sui dati che si adattano alle interazioni individuali dell'utente.

Quando un utente avvia una richiesta di variante, il sistema non sceglie semplicemente 'A' o 'B'. Invece, costruisce un prompt completo che fornisce ad Amazon Bedrock tutte le informazioni necessarie per prendere una decisione informata e ottimale. Questo processo sfrutta la capacità di Bedrock di interpretare istruzioni complesse e utilizzare strumenti predefiniti per raccogliere ulteriore contesto, garantendo che l'AI abbia il quadro completo prima di raccomandare un'assegnazione. Per una comprensione più approfondita di come tali agenti intelligenti vengono valutati in produzione, considera di esplorare risorse come Valutazione degli Agenti AI per la Produzione: Una Guida Pratica agli Evals di Strands.

Il Prompt Decisionale dell'AI: Intelligenza Contestuale in Azione

L'efficacia del processo decisionale di Amazon Bedrock dipende dalla struttura del prompt meticolosamente elaborata che informa l'AI. Questo prompt comprende due parti principali: un prompt di sistema che definisce il ruolo e il comportamento di Bedrock, e un prompt utente che fornisce dati contestuali specifici e in tempo reale per la decisione. Questo design assicura che l'AI operi entro confini definiti sfruttando informazioni ricche e dinamiche.

Ecco una visione concettuale della struttura del prompt che Amazon Bedrock riceve:

# Prompt di Sistema (definisce il ruolo e il comportamento di Amazon Bedrock)

system_prompt =

"""

Sei uno specialista esperto di ottimizzazione dell'A/B testing con accesso a strumenti per la raccolta di dati sul comportamento degli utenti.

ISTRUZIONI CRITICHE:

1. CHIAMA SEMPRE get_user_assignment PER PRIMO per verificare le assegnazioni esistenti

2. Chiama altri strumenti solo se hai bisogno di informazioni specifiche per prendere una decisione migliore

3. Chiama gli strumenti in base a quali informazioni sarebbero preziose per questa specifica decisione

4. Se l'utente ha un'assegnazione esistente, mantienila a meno che non ci siano prove solide (miglioramento del 30%+) per cambiarla

5. CRITICO: La tua risposta finale DEVE essere SOLO JSON valido senza testo aggiuntivo, spiegazioni o commenti prima o dopo l'oggetto JSON

Strumenti disponibili:

- get_user_assignment: Verifica l'assegnazione della variante esistente (CHIAMA QUESTO PER PRIMO)

- get_user_profile: Ottieni il profilo comportamentale e le preferenze dell'utente

- get_similar_users: Trova utenti con pattern comportamentali simili

- get_experiment_context: Ottieni la configurazione e la performance dell'esperimento

- get_session_context: Analizza il comportamento della sessione corrente

- get_user_journey: Ottieni la cronologia delle interazioni dell'utente

- get_variant_performance: Ottieni le metriche di performance della variante

- analyze_user_behavior: Analisi comportamentale approfondita dalla cronologia degli eventi

- update_user_profile: Aggiorna il profilo utente con insight derivati dall'AI

- get_profile_learning_status: Verifica la qualità e la confidenza dei dati del profilo

- batch_update_profiles: Aggiorna in batch più profili utente

Prendi decisioni intelligenti e basate sui dati. Usa gli strumenti necessari per raccogliere contesto sufficiente per una selezione ottimale della variante.

FORMATO DI RISPOSTA: Restituisci SOLO l'oggetto JSON. Non includere testo prima o dopo di esso."""

# Prompt Utente (fornisce un contesto decisionale specifico)

prompt = f"""Seleziona la variante ottimale per questo utente nell'esperimento {experiment_id}.

CONTESTO UTENTE:

- ID Utente: {user_context.user_id}

- ID Sessione: {user_context.session_id}

- Dispositivo: {user_context.device_type} (Mobile: {bool(user_context.is_mobile)})

- Pagina Corrente: {user_context.current_session.current_page}

- Referrer: {user_context.current_session.referrer_type or 'direct'}

- Varianti Precedenti: {user_context.current_session.previous_variants or 'None'}

INSIGHT CONTESTUALI:

{analyze_user_context()}

CONTESTO DI PERSONALIZZAZIONE:

- Punteggio di Engagement: {profile.engagement_score:.2f}

- Probabilità di Conversione: {profile.conversion_likelihood:.2f}

- Stile di Interazione: {profile.interaction_style}

- Varianti Precedentemente Riuscite: {

Questo prompt completo autorizza Amazon Bedrock ad agire come agente intelligente, prendendo decisioni sfumate piuttosto che affidarsi ad assegnazioni casuali grossolane. Fornendo accesso a vari strumenti per il recupero e l'analisi dei dati, assicura che il modello abbia tutte le informazioni necessarie per ottimizzare le preferenze individuali dell'utente e gli obiettivi dell'esperimento. Questo approccio migliora significativamente la precisione e la velocità dell'A/B testing, promuovendo esperienze utente più efficaci e personalizzate. Tale uso nativo di strumenti è una funzionalità potente, simile a concetti esplorati in Amazon Bedrock AgentCore.

Sbloccare la Sperimentazione Scalabile e Personalizzata

L'integrazione dell'AI, in particolare tramite Amazon Bedrock, nelle metodologie di A/B testing segna un cambiamento fondamentale da esperimenti ampi e randomizzati a interazioni precise, adattive e personalizzate. Questo motore basato sull'AI non solo mitiga le limitazioni degli approcci tradizionali—come la lenta convergenza e l'elevato rumore—ma introduce anche capacità ineguagliabili per l'ottimizzazione in tempo reale. Assegnando dinamicamente le varianti basandosi sul contesto individuale dell'utente, sulla cronologia comportamentale e sugli insight predittivi, le organizzazioni possono ottenere risultati più rapidi, acquisire intelligenza azionabile più profonda e offrire esperienze utente veramente su misura.

L'architettura serverless supportata da servizi AWS come Amazon ECS Fargate e Amazon DynamoDB assicura che questo sistema sofisticato rimanga scalabile ed economicamente vantaggioso, capace di gestire carichi variabili senza intervento manuale. Questo salto tecnologico consente alle aziende di andare oltre la semplice identificazione di una variante "vincente" per un pubblico generico, verso la comprensione di ciò che risuona meglio con ogni singolo utente in qualsiasi momento. Il futuro dell'ottimizzazione dell'esperienza utente è innegabilmente adattivo, intelligente e alimentato dall'AI, stabilendo un nuovo standard per l'evoluzione dei prodotti e servizi digitali.

Fonte originale

https://aws.amazon.com/blogs/machine-learning/build-an-ai-powered-a-b-testing-engine-using-amazon-bedrock/Domande Frequenti

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

Resta aggiornato

Ricevi le ultime notizie sull'IA nella tua casella.