Een revolutie in A/B-testen met AI en Amazon Bedrock

A/B-testen is lange tijd de hoeksteen geweest voor het optimaliseren van gebruikerservaringen, het verfijnen van boodschappen en het verbeteren van conversiestromen. Toch betekent de traditionele afhankelijkheid van willekeurige toewijzing vaak langdurige testcycli, soms wekenlang, alleen al om statistische significantie te bereiken. Dit proces is, hoewel effectief, inherent traag en mist vaak vroege, cruciale signalen die verborgen liggen in gebruikersgedrag.

Maak kennis met de toekomst van experimenteren: een AI-gestuurde A/B-testengine, gebouwd met geavanceerde services zoals Amazon Bedrock, Amazon Elastic Container Service (ECS) en Amazon DynamoDB. Dit innovatieve systeem overstijgt conventionele methoden door gebruikerscontext intelligent te analyseren om dynamische, gepersonaliseerde varianttoewijzingsbeslissingen te nemen tijdens een experiment. Het resultaat? Verminderde ruis, vroegere identificatie van significante gedragspatronen en een drastisch versneld pad naar zelfverzekerde, datagestuurde conclusies. Dit artikel onderzoekt de architectuur en methodologie achter het bouwen van zo'n engine, en biedt een blauwdruk voor schaalbare, adaptieve en gepersonaliseerde experimentatie, mogelijk gemaakt door serverloze AWS-services.

Traditionele A/B-testbeperkingen overwinnen

Traditioneel A/B-testen werkt volgens een eenvoudig principe: wijs gebruikers willekeurig toe aan verschillende varianten (A of B), verzamel gegevens en roep een winnaar uit op basis van vooraf gedefinieerde statistieken. Hoewel fundamenteel, kent deze benadering inherente beperkingen die snelle optimalisatie en diepgaande inzichten kunnen belemmeren:

- Uitsluitend willekeurige toewijzing: Zelfs wanneer vroege gegevens wijzen op significante verschillen in gebruikersvoorkeuren of -gedragingen, houdt traditioneel A/B-testen zich strikt aan willekeurige distributie. Dit betekent dat gebruikers gedurende langere perioden kunnen worden blootgesteld aan suboptimale varianten, zelfs als een alternatief duidelijk beter presteert voor hun specifieke profiel.

- Trage convergentie: De noodzaak om een statistisch significant volume aan gegevens te verzamelen betekent vaak dat experimenten wekenlang voortduren. Deze vertraging kan productiteraties vertragen, inkomstenkansen uitstellen en organisaties een concurrentienadeel bezorgen.

- Hoog ruisniveau: Een algemene willekeurige toewijzing kan gebruikers blootstellen aan varianten die duidelijk niet overeenkomen met hun behoeften of voorkeuren. Deze 'ruis' kan echte inzichten verhullen, waardoor het moeilijker wordt om effectieve strategieën te onderscheiden en soms uitgebreide post-hoc analyse vereist is om gegevens te segmenteren voor duidelijkheid.

- Handmatige optimalisatielast: Het identificeren van genuanceerde gedragspatronen of segmentspecifieke voorkeuren vereist doorgaans aanzienlijke handmatige analyse nadat het experiment is afgerond. Deze reactieve benadering is tijdrovend en slaagt er vaak niet in om realtime signalen effectief te benutten.

Neem een retailscenario: een bedrijf test twee Call-to-Action (CTA) knoppen: "Koop Nu" (Variant A) versus "Koop Nu – Gratis Verzending" (Variant B). Initiële gegevens kunnen aantonen dat Variant B beter presteert. Een diepere, handmatige analyse zou echter kunnen onthullen dat premiumleden (die al gratis verzending hebben) aarzelen bij Variant B, terwijl koopjesjagers er massaal op afkomen. Mobiele gebruikers zouden daarentegen Variant A kunnen verkiezen vanwege de schermgrootte. Traditionele methoden zouden deze diverse gedragingen over een lange periode middelen, waardoor het moeilijk wordt om te reageren op genuanceerde voorkeuren zonder uitgebreide, handmatige segmentatie. Dit is precies waar de kracht van AI-ondersteunde toewijzing van onschatbare waarde wordt, waardoor realtime aanpassing en superieure A/B-test resultaten mogelijk zijn.

Het ontwerpen van een adaptieve A/B-testengine met AWS

De adaptieve A/B-test engine markeert een significante evolutie ten opzichte van zijn traditionele tegenhanger. Door realtime gebruikerscontext en vroege gedragspatronen te integreren, maakt het slimmere, dynamischere varianttoewijzingen mogelijk. In de kern maakt deze oplossing gebruik van de intelligente mogelijkheden van Amazon Bedrock, dat, in plaats van elke gebruiker aan een vaste variant toe te wijzen, de individuele gebruikerscontext evalueert, historische gedragsgegevens ophaalt en de meest optimale variant voor die specifieke interactie selecteert.

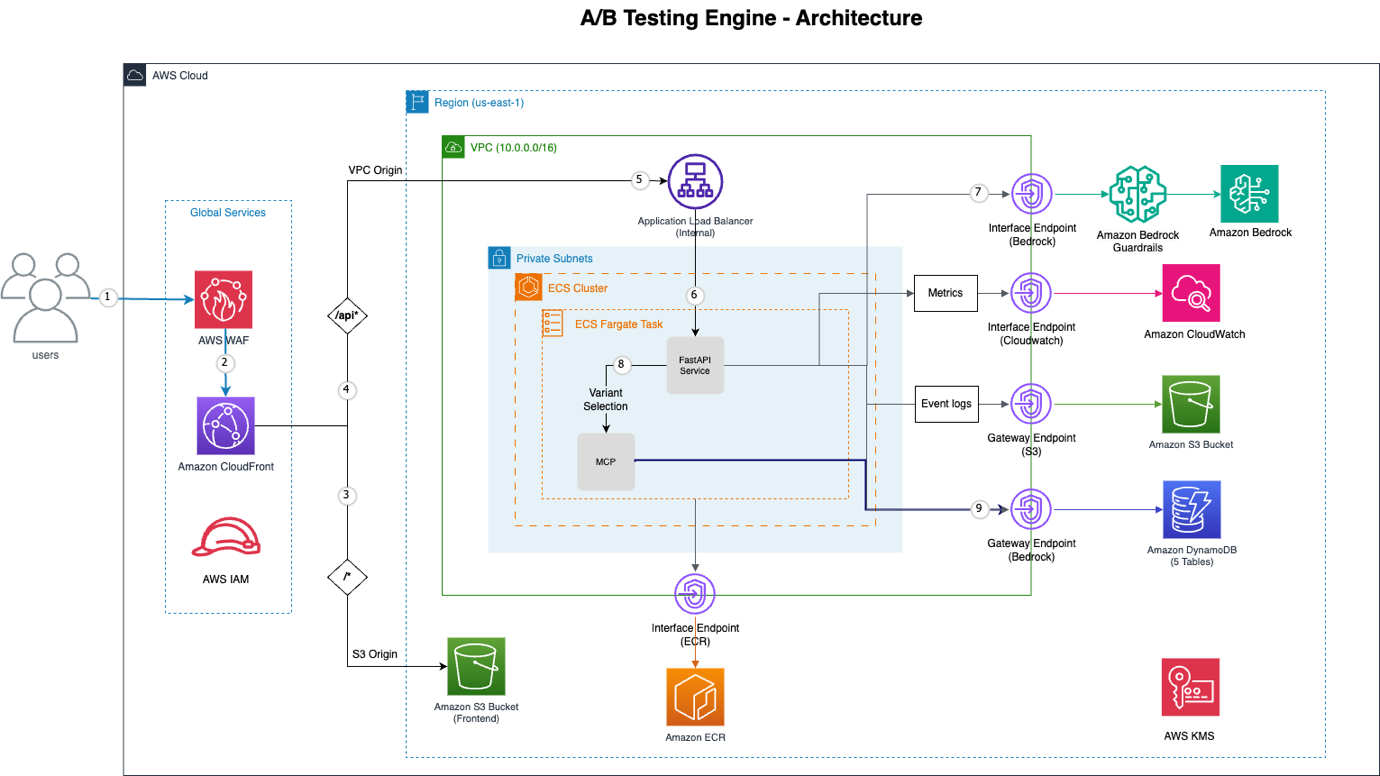

Het systeem is gebouwd op een robuuste, serverloze architectuur binnen AWS, wat schaalbaarheid, veerkracht en efficiëntie garandeert:

Figuur 1: Architectuur van de A/B-testengine

Hier is een overzicht van de belangrijkste AWS-componenten die dit mogelijk maken:

| AWS Service | Functionaliteit |

|---|---|

| Amazon CloudFront | Wereldwijd Content Delivery Network (CDN) dat distributed denial-of-service (DDoS) bescherming, SQL injection afschrikking en snelheidsbeperking biedt. |

| AWS WAF | Web Application Firewall geïntegreerd met CloudFront voor verbeterde beveiliging. |

| VPC Origin | Creëert een privéverbinding van Amazon CloudFront naar een interne Application Load Balancer, waardoor blootstelling aan het openbare internet voor backend-services wordt geëlimineerd. |

| Amazon ECS met AWS Fargate | Serverloos containerorkestratieplatform dat de FastAPI-applicatie uitvoert, wat hoge beschikbaarheid en schaalbaarheid garandeert zonder servers te beheren. |

| Amazon Bedrock | De centrale AI-beslissingsengine, die modellen zoals Claude Sonnet gebruikt met native toolgebruik voor intelligente variantselectie. |

| Model Context Protocol (MCP) | Biedt gestructureerde toegang tot gebruikersgedrag en experimentgegevens, waardoor Bedrock efficiënt specifieke informatie kan ophalen. |

| VPC Endpoints | Garandeert privéconnectiviteit met AWS-services zoals Bedrock, DynamoDB, S3, ECR en CloudWatch, waardoor de beveiliging wordt verbeterd en de latentie wordt verminderd. |

| Amazon DynamoDB | Een volledig beheerde, serverloze NoSQL-database die vijf tabellen biedt voor experimenten, gebeurtenissen, toewijzingen, gebruikersprofielen en batchtaken. |

| Amazon S3 | Gebruikt voor statische frontend hosting en duurzame opslag van gebeurtenislogboeken, met hoge beschikbaarheid en schaalbaarheid. |

Deze architectuur levert een krachtig en adaptief experimenteerplatform, waardoor organisaties de beperkingen van willekeurige toewijzing kunnen overstijgen en een werkelijk intelligente benadering van A/B-testen kunnen omarmen.

De rol van Amazon Bedrock in intelligente varianttoewijzing

De ware innovatie van deze A/B-test engine ligt in het vermogen om meerdere gegevenspunten – gebruikerscontext, historisch gedrag, patronen van vergelijkbare gebruikers en realtime prestatiegegevens – te combineren om de meest effectieve variant te kiezen. De kern van deze intelligentie is Amazon Bedrock, met name de mogelijkheden voor het implementeren van geavanceerde generatieve AI-modellen zoals Claude Sonnet met native toolgebruik. Deze krachtige combinatie stelt het systeem in staat om een expert A/B-testspecialist na te bootsen, die realtime, datagestuurde beslissingen neemt die zich aanpassen aan individuele gebruikersinteracties.

Wanneer een gebruiker een variantverzoek initieert, kiest het systeem niet simpelweg 'A' of 'B'. In plaats daarvan construeert het een uitgebreide prompt die Amazon Bedrock voorziet van alle benodigde informatie om een weloverwogen, optimale beslissing te nemen. Dit proces maakt gebruik van Bedrock's vermogen om complexe instructies te interpreteren en vooraf gedefinieerde tools te gebruiken om aanvullende context te verzamelen, zodat de AI het volledige plaatje heeft voordat een toewijzing wordt aanbevolen. Voor een dieper begrip van hoe dergelijke intelligente agenten in productie worden geëvalueerd, kunt u overwegen bronnen zoals AI-agenten evalueren voor productie: een praktische gids voor Strands' Evals te verkennen.

De AI-beslissingsprompt: Contextuele intelligentie in actie

De effectiviteit van de besluitvorming van Amazon Bedrock hangt af van de zorgvuldig samengestelde promptstructuur die de AI informeert. Deze prompt bestaat uit twee hoofddelen: een systeemprompt die de rol en het gedrag van Bedrock definieert, en een gebruikersprompt die specifieke, realtime contextuele gegevens voor de beslissing levert. Dit ontwerp zorgt ervoor dat de AI binnen gedefinieerde grenzen opereert, terwijl het rijke, dynamische informatie benut.

Hier is een conceptuele blik op de promptstructuur die Amazon Bedrock ontvangt:

# System Prompt (defines Amazon Bedrock's role and behavior)

system_prompt =

"""

You are an expert A/B testing optimization specialist with access to tools for gathering user behavior data.

CRITICAL INSTRUCTIONS:

1. ALWAYS call get_user_assignment FIRST to check for existing assignments

2. Only call other tools if you need specific information to make a better decision

3. Call tools based on what information would be valuable for this specific decision

4. If user has existing assignment, keep it unless there's strong evidence (30%+ improvement) to change

5. CRITICAL: Your final response MUST be ONLY valid JSON with no additional text, explanations, or commentary before or after the JSON object

Available tools:

- get_user_assignment: Check existing variant assignment (CALL THIS FIRST)

- get_user_profile: Get user behavioral profile and preferences

- get_similar_users: Find users with similar behavior patterns

- get_experiment_context: Get experiment configuration and performance

- get_session_context: Analyze current session behavior

- get_user_journey: Get user's interaction history

- get_variant_performance: Get variant performance metrics

- analyze_user_behavior: Deep behavioral analysis from event history

- update_user_profile: Update user profile with AI-derived insights

- get_profile_learning_status: Check profile data quality and confidence

- batch_update_profiles: Batch update multiple user profiles

Make intelligent, data-driven decisions. Use the tools you need to gather sufficient context for optimal variant selection.

RESPONSE FORMAT: Return ONLY the JSON object. Do not include any text before or after it."""

# User Prompt (provides specific decision context)

prompt = f"""Select the optimal variant for this user in experiment {experiment_id}.

USER CONTEXT:

- User ID: {user_context.user_id}

- Session ID: {user_context.session_id}

- Device: {user_context.device_type} (Mobile: {bool(user_context.is_mobile)})

- Current Page: {user_context.current_session.current_page}

- Referrer: {user_context.current_session.referrer_type or 'direct'}

- Previous Variants: {user_context.current_session.previous_variants or 'None'}

CONTEXT INSIGHTS:

{analyze_user_context()}

PERSONALIZATION CONTEXT:

- Engagement Score: {profile.engagement_score:.2f}

- Conversion Likelihood: {profile.conversion_likelihood:.2f}

- Interaction Style: {profile.interaction_style}

- Previously Successful Variants: {

Deze uitgebreide prompt stelt Amazon Bedrock in staat om als een intelligent agent te fungeren en genuanceerde beslissingen te nemen in plaats van te vertrouwen op grove willekeurige toewijzingen. Door toegang te bieden tot verschillende tools voor gegevensophaling en -analyse, zorgt het ervoor dat het model over alle benodigde informatie beschikt om te optimaliseren voor individuele gebruikersvoorkeuren en experimentdoelen. Deze benadering verbetert de precisie en snelheid van A/B-testen aanzienlijk, wat leidt tot effectievere en gepersonaliseerde gebruikerservaringen. Dit native toolgebruik is een krachtige functie, vergelijkbaar met concepten die worden verkend in Amazon Bedrock AgentCore.

Schaalbare en gepersonaliseerde experimentatie ontsluiten

De integratie van AI, met name via Amazon Bedrock, in A/B-test methodologieën markeert een cruciale verschuiving van brede, gerandomiseerde experimenten naar precieze, adaptieve en gepersonaliseerde interacties. Deze AI-gestuurde engine vermindert niet alleen de beperkingen van traditionele benaderingen – zoals trage convergentie en hoge ruis – maar introduceert ook ongekende mogelijkheden voor realtime optimalisatie. Door dynamisch varianten toe te wijzen op basis van individuele gebruikerscontext, gedragsgeschiedenis en voorspellende inzichten, kunnen organisaties snellere resultaten behalen, diepere bruikbare intelligentie verzamelen en werkelijk op maat gemaakte gebruikerservaringen leveren.

De serverloze architectuur, ondersteund door AWS-services zoals Amazon ECS Fargate en Amazon DynamoDB, zorgt ervoor dat dit geavanceerde systeem schaalbaar en kosteneffectief blijft, en in staat is om variërende workloads zonder handmatige tussenkomst te verwerken. Deze technologische sprong stelt bedrijven in staat verder te gaan dan het eenvoudigweg identificeren van een "winnende" variant voor een algemeen publiek, naar het begrijpen van wat het beste aansluit bij elke unieke gebruiker op elk willekeurig moment. De toekomst van optimalisatie van de gebruikerservaring is ontegenzeggelijk adaptief, intelligent en aangedreven door AI, en zet een nieuwe standaard voor de evolutie van digitale producten en diensten.

Originele bron

https://aws.amazon.com/blogs/machine-learning/build-an-ai-powered-a-b-testing-engine-using-amazon-bedrock/Veelgestelde vragen

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

Blijf op de hoogte

Ontvang het laatste AI-nieuws in je inbox.