Revoluționarea Testării A/B cu AI și Amazon Bedrock

Testarea A/B a fost mult timp piatra de temelie a optimizării experiențelor utilizatorilor, a rafinării mesajelor și a îmbunătățirii fluxurilor de conversie. Totuși, dependența sa tradițională de atribuirea aleatorie înseamnă adesea cicluri de testare lungi, care se întind uneori pe săptămâni, doar pentru a atinge semnificația statistică. Acest proces, deși eficient, este inerent lent și omite frecvent semnalele timpurii, cruciale, ascunse în comportamentul utilizatorului.

Iată viitorul experimentării: un motor de testare A/B bazat pe inteligență artificială, construit folosind servicii de ultimă generație precum Amazon Bedrock, Amazon Elastic Container Service (ECS) și Amazon DynamoDB. Acest sistem inovator depășește metodele convenționale prin analiza inteligentă a contextului utilizatorului pentru a lua decizii dinamice, personalizate de atribuire a variantelor în timpul unui experiment. Rezultatul? Zgomot redus, identificare mai timpurie a modelelor comportamentale semnificative și o cale dramatic accelerată către concluzii sigure, bazate pe date. Acest articol va explora arhitectura și metodologia din spatele construirii unui astfel de motor, oferind o schiță pentru experimentare scalabilă, adaptivă și personalizată, alimentată de servicii serverless AWS.

Depășirea Limitărilor Testării A/B Tradiționale

Testarea A/B tradițională funcționează pe un principiu simplu: atribuirea aleatorie a utilizatorilor la diferite variante (A sau B), colectarea datelor și declararea unui câștigător pe baza unor metrici predefinite. Deși fundamentală, această abordare este plină de limitări inerente care pot împiedica optimizarea rapidă și obținerea de informații profunde:

- Atribuire Exclusiv Aleatorie: Chiar și atunci când datele timpurii sugerează diferențe semnificative în preferințele sau comportamentele utilizatorilor, testarea A/B tradițională aderă strict la distribuția aleatorie. Aceasta înseamnă că utilizatorii ar putea fi expuși la variante suboptimale pentru perioade extinse, chiar dacă o alternativă performează în mod clar mai bine pentru profilul lor specific.

- Convergență Lentă: Necesitatea de a aduna un volum statistic semnificativ de date înseamnă adesea că experimentele se prelungesc săptămâni la rând. Această întârziere poate încetini iterațiile de produs, amâna oportunitățile de venit și pune organizațiile într-un dezavantaj competitiv.

- Nivel Ridicat de Zgomot: O atribuire aleatorie generală poate expune utilizatorii la variante care sunt în mod clar nealiniate cu nevoile sau preferințele lor. Acest „zgomot” poate masca informații autentice, făcând mai dificilă identificarea strategiilor eficiente și necesitând uneori o analiză post-hoc extinsă pentru a segmenta datele pentru claritate.

- Povara Optimizării Manuale: Identificarea modelelor comportamentale nuanțate sau a preferințelor specifice segmentelor necesită de obicei o analiză manuală semnificativă după încheierea experimentului. Această abordare reactivă consumă timp și nu reușește adesea să valorifice eficient semnalele în timp real.

Luați în considerare un scenariu de comerț cu amănuntul: o companie testează două butoane Call-to-Action (CTA): „Cumpără acum” (Varianta A) vs. „Cumpără acum – Livrare gratuită” (Varianta B). Datele inițiale ar putea arăta că Varianta B are performanțe mai bune. Cu toate acestea, o analiză manuală mai aprofundată ar putea dezvălui că membrii premium (care au deja livrare gratuită) ezită cu Varianta B, în timp ce vânătorii de oferte se îndreaptă spre ea. Utilizatorii de pe mobil, în schimb, ar putea prefera Varianta A din cauza dimensiunii ecranului. Metodele tradiționale ar face o medie a acestor comportamente diverse pe o perioadă lungă, făcând dificilă acționarea asupra preferințelor nuanțate fără o segmentare extinsă și manuală. Acesta este tocmai punctul în care puterea atribuirii asistate de AI devine inestimabilă, permițând adaptarea în timp real și rezultate superioare în testarea A/B.

Arhitecturarea unui Motor de Testare A/B Adaptiv cu AWS

Motorul adaptiv de testare A/B marchează o evoluție semnificativă față de omologul său tradițional. Prin integrarea contextului utilizatorului în timp real și a modelelor comportamentale timpurii, acesta permite atribuiri de variante mai inteligente și mai dinamice. În esență, această soluție valorifică capacitățile inteligente ale Amazon Bedrock, care, în loc să aloce fiecare utilizator unei variante fixe, evaluează contextul individual al utilizatorului, preia datele comportamentale istorice și selectează varianta optimă pentru acea interacțiune specifică.

Sistemul este construit pe o arhitectură robustă, serverless în cadrul AWS, asigurând scalabilitate, reziliență și eficiență:

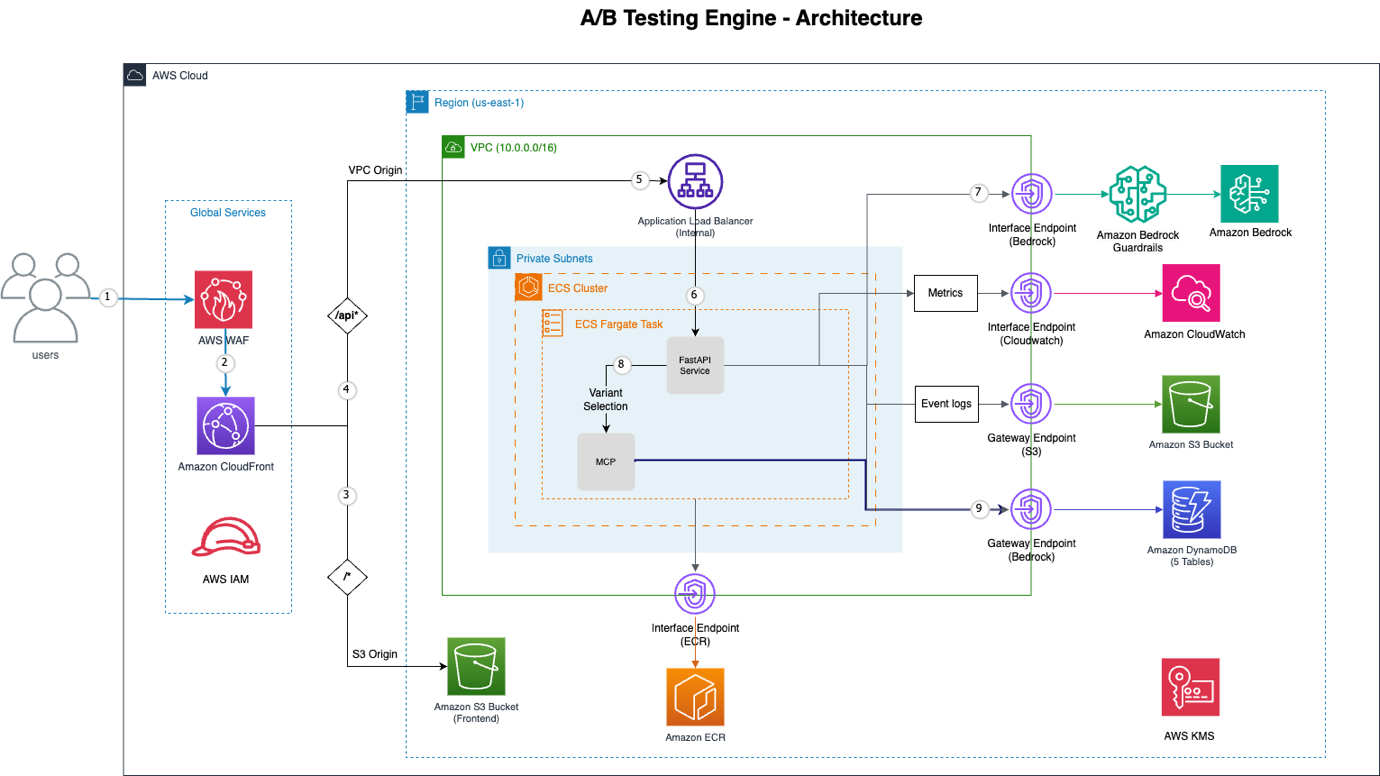

Figura 1: Arhitectura Motorului de Testare A/B

Iată o prezentare detaliată a componentelor cheie AWS care fac acest lucru posibil:

| Serviciu AWS | Funcționalitate |

|---|---|

| Amazon CloudFront | Rețea globală de livrare de conținut (CDN) care oferă protecție împotriva atacurilor de tip distributed denial-of-service (DDoS), descurajarea injecției SQL și limitarea ratei. |

| AWS WAF | Firewall pentru aplicații web integrat cu CloudFront pentru securitate îmbunătățită. |

| VPC Origin | Stabilește o conexiune privată de la Amazon CloudFront la un Application Load Balancer intern, eliminând expunerea la internet public pentru serviciile backend. |

| Amazon ECS cu AWS Fargate | Platformă de orchestrare a containerelor fără server care rulează aplicația FastAPI, asigurând disponibilitate ridicată și scalabilitate fără a gestiona servere. |

| Amazon Bedrock | Motorul central de decizie AI, utilizând modele precum Claude Sonnet cu utilizare nativă a instrumentelor pentru selecția inteligentă a variantelor. |

| Protocolul de Context al Modelului (MCP) | Oferă acces structurat la datele de comportament al utilizatorilor și de experiment, permițând Bedrock să recupereze informații specifice în mod eficient. |

| VPC Endpoints | Asigură conectivitate privată la servicii AWS precum Bedrock, DynamoDB, S3, ECR și CloudWatch, îmbunătățind securitatea și reducând latența. |

| Amazon DynamoDB | O bază de date NoSQL complet gestionată, fără server, care oferă cinci tabele pentru experimente, evenimente, atribuiri, profiluri de utilizator și joburi batch. |

| Amazon S3 | Utilizat pentru găzduirea frontend-ului static și stocarea durabilă a jurnalelor de evenimente, oferind disponibilitate ridicată și scalabilitate. |

Această arhitectură oferă o platformă puternică și adaptivă de experimentare, permițând organizațiilor să depășească limitările atribuirii aleatorii și să adopte o abordare cu adevărat inteligentă a testării A/B.

Rolul Amazon Bedrock în Atribuirea Inteligentă a Variantelor

Adevărata inovație a acestui motor de testare A/B constă în capacitatea sa de a combina multiple puncte de date – contextul utilizatorului, comportamentul istoric, modelele de la utilizatori similari și metricile de performanță în timp real – pentru a alege varianta cea mai eficientă. În centrul acestei inteligențe se află Amazon Bedrock, în special capacitățile sale de a implementa modele avansate de AI generativă, cum ar fi Claude Sonnet, cu utilizarea nativă a instrumentelor. Această combinație puternică permite sistemului să imite un specialist expert în testarea A/B, luând decizii în timp real, bazate pe date, care se adaptează interacțiunilor individuale ale utilizatorilor.

Atunci când un utilizator inițiază o solicitare de variantă, sistemul nu alege pur și simplu „A” sau „B”. În schimb, construiește un prompt cuprinzător care oferă Amazon Bedrock toate informațiile necesare pentru a lua o decizie informată și optimă. Acest proces valorifică capacitatea Bedrock de a interpreta instrucțiuni complexe și de a utiliza instrumente predefinite pentru a colecta context suplimentar, asigurându-se că AI-ul are imaginea completă înainte de a recomanda o atribuire. Pentru o înțelegere mai profundă a modului în care astfel de agenți inteligenți sunt evaluați în producție, luați în considerare explorarea resurselor precum Evaluarea Agenților AI pentru Producție: Un Ghid Practic pentru Evals Strands.

Promptul de Decizie AI: Inteligență Contextuală în Acțiune

Eficiența procesului decizional al Amazon Bedrock depinde de structura promptului meticulos elaborată care informează AI-ul. Acest prompt cuprinde două părți principale: un prompt de sistem care definește rolul și comportamentul Bedrock, și un prompt de utilizator care oferă date contextuale specifice, în timp real, pentru decizie. Acest design asigură că AI-ul operează în limite definite, valorificând în același timp informații bogate și dinamice.

Iată o privire conceptuală asupra structurii promptului pe care Amazon Bedrock o primește:

# System Prompt (defines Amazon Bedrock's role and behavior)

system_prompt =

"""

Ești un specialist expert în optimizarea testării A/B, cu acces la instrumente pentru colectarea datelor despre comportamentul utilizatorilor.

INSTRUCȚIUNI CRITICE:

1. APELĂ ÎNTOTDEAUNA get_user_assignment PRIMUL pentru a verifica atribuirile existente

2. Apelă alte instrumente doar dacă ai nevoie de informații specifice pentru a lua o decizie mai bună

3. Apelă instrumentele pe baza informațiilor care ar fi valoroase pentru această decizie specifică

4. Dacă utilizatorul are o atribuire existentă, păstreaz-o, cu excepția cazului în care există dovezi puternice (îmbunătățire de 30%+) pentru a o schimba

5. CRITIC: Răspunsul tău final TREBUIE să fie DOAR JSON valid, fără text suplimentar, explicații sau comentarii înainte sau după obiectul JSON

Instrumente disponibile:

- get_user_assignment: Verifică atribuirea existentă a variantei (APELĂ ACESTA PRIMUL)

- get_user_profile: Obține profilul comportamental și preferințele utilizatorului

- get_similar_users: Găsește utilizatori cu modele comportamentale similare

- get_experiment_context: Obține configurația și performanța experimentului

- get_session_context: Analizează comportamentul sesiunii curente

- get_user_journey: Obține istoricul interacțiunilor utilizatorului

- get_variant_performance: Obține metricile de performanță ale variantei

- analyze_user_behavior: Analiză comportamentală profundă din istoricul evenimentelor

- update_user_profile: Actualizează profilul utilizatorului cu informații derivate din AI

- get_profile_learning_status: Verifică calitatea și încrederea datelor profilului

- batch_update_profiles: Actualizează în serie mai multe profiluri de utilizator

Ia decizii inteligente, bazate pe date. Folosește instrumentele de care ai nevoie pentru a aduna suficient context pentru selecția optimă a variantei.

FORMAT RĂSPUNS: Returnează DOAR obiectul JSON. Nu include niciun text înainte sau după el."""

# User Prompt (provides specific decision context)

prompt = f"""Selectează varianta optimă pentru acest utilizator în experimentul {experiment_id}.

CONTEXT UTILIZATOR:

- ID utilizator: {user_context.user_id}

- ID sesiune: {user_context.session_id}

- Dispozitiv: {user_context.device_type} (Mobil: {bool(user_context.is_mobile)})

- Pagina curentă: {user_context.current_session.current_page}

- Referitor: {user_context.current_session.referrer_type or 'direct'}

- Variante anterioare: {user_context.current_session.previous_variants or 'None'}

INFORMAȚII CONTEXTUALE:

{analyze_user_context()}

CONTEXT DE PERSONALIZARE:

- Scor de implicare: {profile.engagement_score:.2f}

- Probabilitate de conversie: {profile.conversion_likelihood:.2f}

- Stil de interacțiune: {profile.interaction_style}

- Variante anterior de succes: {

Acest prompt cuprinzător împuternicește Amazon Bedrock să acționeze ca un agent inteligent, luând decizii nuanțate în loc să se bazeze pe atribuiri aleatorii brute. Prin oferirea accesului la diverse instrumente pentru extragerea și analiza datelor, se asigură că modelul are toate informațiile necesare pentru a optimiza preferințele individuale ale utilizatorilor și obiectivele experimentului. Această abordare îmbunătățește semnificativ precizia și viteza testării A/B, conducând la experiențe de utilizator mai eficiente și personalizate. O astfel de utilizare nativă a instrumentelor este o caracteristică puternică, similară cu conceptele explorate în Amazon Bedrock AgentCore.

Deblocarea Experimentării Scalabile și Personalizate

Integrarea AI, în special prin Amazon Bedrock, în metodologiile de testare A/B marchează o schimbare esențială de la experimente ample, randomizate, la interacțiuni precise, adaptative și personalizate. Acest motor bazat pe AI nu numai că atenuează limitările abordărilor tradiționale – cum ar fi convergența lentă și zgomotul ridicat – dar introduce și capacități incomparabile pentru optimizarea în timp real. Prin atribuirea dinamică a variantelor pe baza contextului individual al utilizatorului, a istoricului comportamental și a informațiilor predictive, organizațiile pot obține rezultate mai rapide, pot extrage informații acționabile mai profunde și pot oferi experiențe de utilizator cu adevărat personalizate.

Arhitectura serverless susținută de serviciile AWS precum Amazon ECS Fargate și Amazon DynamoDB asigură că acest sistem sofisticat rămâne scalabil și rentabil, capabil să gestioneze sarcini variabile fără intervenție manuală. Acest salt tehnologic permite companiilor să depășească simpla identificare a unei variante „câștigătoare” pentru un public general, către înțelegerea a ceea ce rezonează cel mai bine cu fiecare utilizator unic în orice moment dat. Viitorul optimizării experienței utilizatorului este, fără îndoială, adaptiv, inteligent și bazat pe AI, stabilind un nou standard pentru modul în care produsele și serviciile digitale evoluează.

Sursa originală

https://aws.amazon.com/blogs/machine-learning/build-an-ai-powered-a-b-testing-engine-using-amazon-bedrock/Întrebări frecvente

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

Rămâi la curent

Primește ultimele știri AI în inbox-ul tău.