Revolucioniranje A/B testiranja z AI in Amazon Bedrockom

A/B testiranje je že dolgo temelj optimizacije uporabniških izkušenj, izboljšanja sporočanja in povečanja tokov konverzij. Vendar pa njegovo tradicionalno zanašanje na naključno dodeljevanje pogosto pomeni dolge testne cikle, včasih trajajoče tedne, samo za doseganje statistične pomembnosti. Ta proces, čeprav učinkovit, je sam po sebi počasen in pogosto zgreši zgodnje, ključne signale, skrite v vedenju uporabnikov.

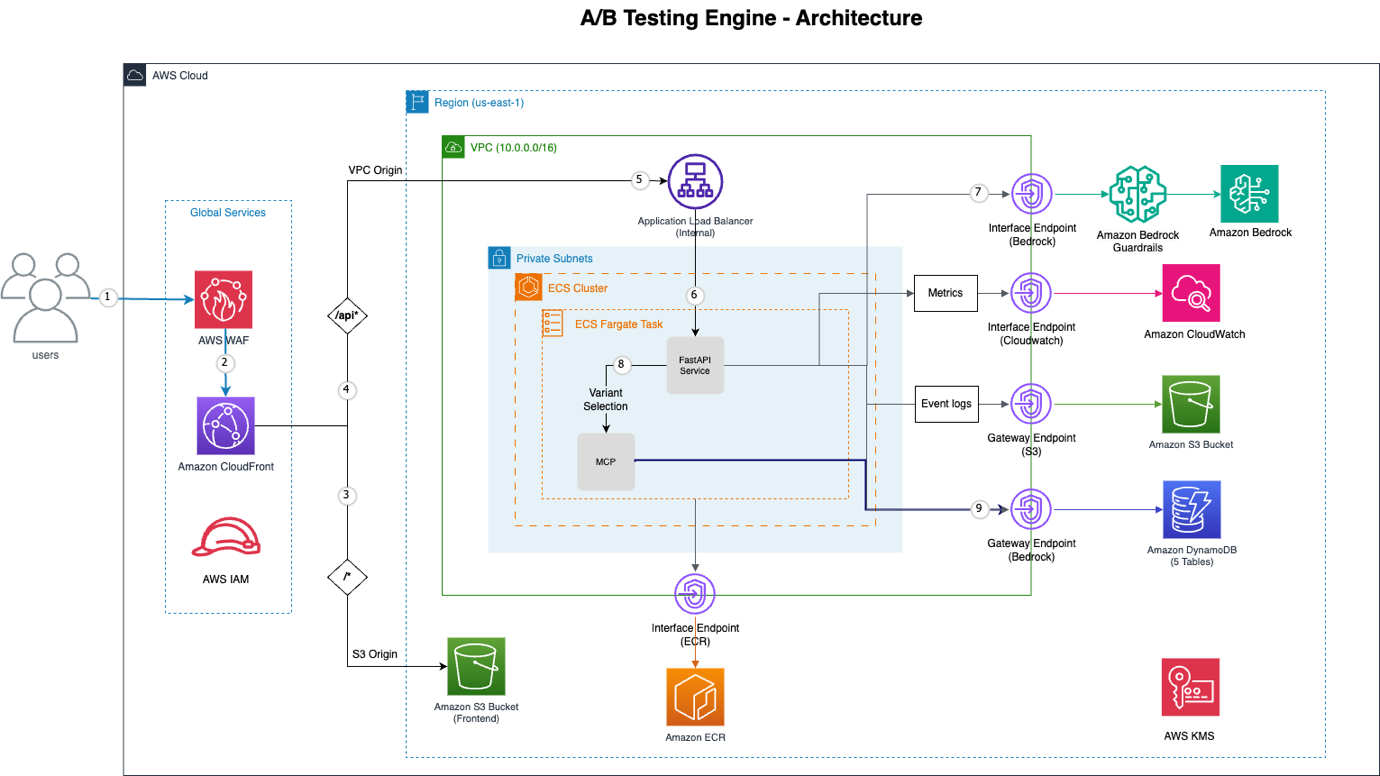

Vstopite v prihodnost eksperimentiranja: mehanizem za A/B testiranje, ki ga poganja AI, zgrajen z uporabo najsodobnejših storitev, kot so Amazon Bedrock, Amazon Elastic Container Service (ECS) in Amazon DynamoDB. Ta inovativen sistem presega konvencionalne metode z inteligentno analizo uporabniškega konteksta za sprejemanje dinamičnih, personaliziranih odločitev o dodeljevanju variant med eksperimentom. Rezultat? Zmanjšan šum, zgodnejše prepoznavanje pomembnih vedenjskih vzorcev in dramatično pospešena pot do zanesljivih zaključkov, ki temeljijo na podatkih. Ta članek bo raziskal arhitekturo in metodologijo za izgradnjo takšnega mehanizma, ponujajoč načrt za razširljivo, prilagodljivo in personalizirano eksperimentiranje, ki ga poganjajo brezstrežniške storitve AWS.

Premagovanje omejitev tradicionalnega A/B testiranja

Tradicionalno A/B testiranje deluje po preprostem načelu: naključno dodelite uporabnike različnim variantam (A ali B), zberite podatke in razglasite zmagovalca na podlagi vnaprej določenih metrik. Čeprav je ta pristop temeljni, je obremenjen z inherentnimi omejitvami, ki lahko ovirajo hitro optimizacijo in globoke vpoglede:

- Izključno naključno dodeljevanje: Tudi ko zgodnji podatki kažejo na pomembne razlike v uporabniških preferencah ali vedenju, se tradicionalno A/B testiranje strogo drži naključne porazdelitve. To pomeni, da so uporabniki lahko izpostavljeni suboptimalnim variantam za daljše obdobje, tudi če alternativa jasno deluje bolje za njihov specifični profil.

- Počasna konvergenca: Potreba po zbiranju statistično pomembnega obsega podatkov pogosto pomeni, da se eksperimenti vlečejo tedne. Ta zamuda lahko upočasni ponovitve izdelkov, odloži priložnosti za prihodke in postavi organizacije v konkurenčni slabši položaj.

- Visoka raven šuma: Splošno naključno dodeljevanje lahko uporabnike izpostavi variantam, ki so jasno neusklajene z njihovimi potrebami ali preferencami. Ta "šum" lahko zakrije resnične vpoglede, zaradi česar je težje razbrati učinkovite strategije in včasih zahteva obsežno naknadno analizo za segmentacijo podatkov za jasnost.

- Ročno breme optimizacije: Prepoznavanje niansiranih vedenjskih vzorcev ali preferenc, specifičnih za segment, običajno zahteva znatno ročno analizo po zaključku eksperimenta. Ta reaktivni pristop je dolgotrajen in pogosto ne izkorišča učinkovito signalov v realnem času.

Razmislite o scenariju v maloprodaji: podjetje testira dva gumba za poziv k akciji (CTA): "Kupi zdaj" (Varianta A) proti "Kupi zdaj – Brezplačna dostava" (Varianta B). Začetni podatki bi lahko pokazali, da Varianta B presega Varianto A. Vendar bi globlja, ročna analiza lahko razkrila, da člani premium (ki že imajo brezplačno dostavo) oklevajo pri Varianti B, medtem ko se lovci na ugodnosti zgrinjajo k njej. Uporabniki mobilnih naprav pa bi morda raje imeli Varianto A zaradi velikosti zaslona. Tradicionalne metode bi povprečile ta raznolika vedenja v daljšem časovnem obdobju, zaradi česar je težko ukrepati glede niansiranih preferenc brez obsežne, ročne segmentacije. To je natančno tisto, kjer moč dodeljevanja s pomočjo AI postane neprecenljiva, kar omogoča prilagajanje v realnem času in vrhunske rezultate A/B testiranja.

Arhitektura prilagodljivega mehanizma za A/B testiranje z AWS

Prilagodljivi mehanizem za A/B testiranje pomeni pomemben razvoj od svojega tradicionalnega dvojnika. Z integracijo uporabniškega konteksta v realnem času in zgodnjih vedenjskih vzorcev omogoča pametnejše, bolj dinamično dodeljevanje variant. V svojem bistvu ta rešitev izkorišča inteligentne zmožnosti Amazon Bedrock, ki namesto dodeljevanja vsakega uporabnika fiksni varianti, ovrednoti individualni uporabniški kontekst, pridobi zgodovinske podatke o vedenju in izbere najoptimalnejšo varianto za to specifično interakcijo.

Sistem je zgrajen na robustni, brezstrežniški arhitekturi znotraj AWS, kar zagotavlja razširljivost, odpornost in učinkovitost:

Slika 1: Arhitektura mehanizma za A/B testiranje

Tukaj je pregled ključnih komponent AWS, ki to omogočajo:

| AWS Storitev | Funkcionalnost |

|---|---|

| Amazon CloudFront | Globalno omrežje za dostavo vsebin (CDN), ki zagotavlja zaščito pred porazdeljenimi napadi zavrnitve storitve (DDoS), preprečevanje vbrizgavanja SQL in omejevanje hitrosti. |

| AWS WAF | Požarni zid spletnih aplikacij, integriran s CloudFront za izboljšano varnost. |

| VPC Origin | Vzpostavi zasebno povezavo iz Amazon CloudFront do notranjega Application Load Balancerja, s čimer odpravi izpostavljenost javnemu internetu za zaledne storitve. |

| Amazon ECS with AWS Fargate | Brezstrežniška platforma za orkestracijo kontejnerjev, ki poganja aplikacijo FastAPI, zagotavlja visoko razpoložljivost in razširljivost brez upravljanja strežnikov. |

| Amazon Bedrock | Osrednji AI mehanizem za odločanje, ki uporablja modele, kot je Claude Sonnet, z izvorno uporabo orodij za inteligentno izbiro variant. |

| Model Context Protocol (MCP) | Omogoča strukturiran dostop do podatkov o vedenju uporabnikov in eksperimentih, kar Bedrocku omogoča učinkovito pridobivanje specifičnih informacij. |

| VPC Endpoints | Zagotavlja zasebno povezljivost s storitvami AWS, kot so Bedrock, DynamoDB, S3, ECR in CloudWatch, kar izboljšuje varnost in zmanjšuje latenco. |

| Amazon DynamoDB | Popolnoma upravljana, brezstrežniška NoSQL zbirka podatkov, ki zagotavlja pet tabel za eksperimente, dogodke, dodelitve, uporabniške profile in paketna opravila. |

| Amazon S3 | Uporablja se za gostovanje statičnega frontenda in trajno shranjevanje dnevnikov dogodkov, kar ponuja visoko razpoložljivost in razširljivost. |

Ta arhitektura zagotavlja zmogljivo in prilagodljivo platformo za eksperimentiranje, ki organizacijam omogoča, da presežejo omejitve naključnega dodeljevanja in sprejmejo resnično inteligenten pristop k A/B testiranju.

Vloga Amazon Bedrocka pri inteligentnem dodeljevanju variant

Prava inovacija tega mehanizma za A/B testiranje leži v njegovi zmožnosti kombiniranja več podatkovnih točk – uporabniškega konteksta, zgodovinskega vedenja, vzorcev podobnih uporabnikov in metrik uspešnosti v realnem času – za izbiro najučinkovitejše variante. V središču te inteligence je Amazon Bedrock, zlasti njegove zmožnosti za uvajanje naprednih generativnih AI modelov, kot je Claude Sonnet, z izvorno uporabo orodij. Ta zmogljiva kombinacija omogoča sistemu, da posnema strokovnjaka za A/B testiranje, sprejemajoč odločitve v realnem času, ki temeljijo na podatkih in se prilagajajo individualnim interakcijam uporabnikov.

Ko uporabnik sproži zahtevo za varianto, sistem ne izbere preprosto 'A' ali 'B'. Namesto tega zgradi obsežen poziv, ki Amazon Bedrocku zagotovi vse potrebne informacije za sprejemanje informirane, optimalne odločitve. Ta proces izkorišča zmožnost Bedrocka za interpretacijo kompleksnih navodil in uporabo vnaprej določenih orodij za zbiranje dodatnega konteksta, kar zagotavlja, da ima AI celotno sliko pred priporočanjem dodelitve. Za globlje razumevanje, kako se takšni inteligentni agenti vrednotijo v proizvodnji, razmislite o raziskovanju virov, kot je Vrednotenje AI agentov za produkcijo: Praktični vodnik po Strands' Evals.

AI odločitveni poziv: Kontekstualna inteligenca v akciji

Učinkovitost odločanja Amazon Bedrocka je odvisna od natančno izdelane strukture poziva, ki informira AI. Ta poziv je sestavljen iz dveh glavnih delov: sistemskega poziva, ki določa vlogo in vedenje Bedrocka, in uporabniškega poziva, ki zagotavlja specifične, realnočasovne kontekstualne podatke za odločitev. Ta zasnova zagotavlja, da AI deluje znotraj določenih meja, hkrati pa izkorišča bogate, dinamične informacije.

Tukaj je konceptualni vpogled v strukturo poziva, ki ga prejme Amazon Bedrock:

# Sistemski poziv (definira vlogo in vedenje Amazon Bedrocka)

system_prompt =

"""

Ste strokovnjak za optimizacijo A/B testiranja z dostopom do orodij za zbiranje podatkov o vedenju uporabnikov.

KRITIČNA NAVODILA:

1. VEDNO najprej pokličite get_user_assignment za preverjanje obstoječih dodelitev

2. Druga orodja pokličite le, če potrebujete specifične informacije za boljšo odločitev

3. Orodja pokličite glede na to, katere informacije bi bile dragocene za to specifično odločitev

4. Če ima uporabnik obstoječo dodelitev, jo ohranite, razen če obstajajo močni dokazi (30%+ izboljšanje) za spremembo

5. KRITIČNO: Vaš končni odgovor MORA biti SAMO veljaven JSON brez dodatnega besedila, razlag ali komentarjev pred ali po JSON objektu

Razpoložljiva orodja:

- get_user_assignment: Preveri obstoječo dodelitev variante (POKLIČITE TO NAJPREJ)

- get_user_profile: Pridobi vedenjski profil in preference uporabnika

- get_similar_users: Poišči uporabnike s podobnimi vedenjskimi vzorci

- get_experiment_context: Pridobi konfiguracijo in uspešnost eksperimenta

- get_session_context: Analiziraj vedenje trenutne seje

- get_user_journey: Pridobi zgodovino interakcij uporabnika

- get_variant_performance: Pridobi metrike uspešnosti variante

- analyze_user_behavior: Globoka vedenjska analiza iz zgodovine dogodkov

- update_user_profile: Posodobi uporabniški profil z vpogledi, pridobljenimi z AI

- get_profile_learning_status: Preveri kakovost podatkov profila in zaupanje

- batch_update_profiles: Paketno posodobi več uporabniških profilov

Sprejemajte inteligentne, na podatkih temelječe odločitve. Uporabite orodja, ki jih potrebujete za zbiranje zadostnega konteksta za optimalno izbiro variante.

FORMAT ODGOVORA: Vrnite SAMO JSON objekt. Ne vključujte nobenega besedila pred ali za njim."""

# Uporabniški poziv (zagotavlja specifičen kontekst odločitve)

prompt = f"""Izberite optimalno varianto za tega uporabnika v eksperimentu {experiment_id}.

UPORABNIŠKI KONTEKST:

- User ID: {user_context.user_id}

- ID seje: {user_context.session_id}

- Naprava: {user_context.device_type} (Mobilno: {bool(user_context.is_mobile)})

- Trenutna stran: {user_context.current_session.current_page}

- Referenca: {user_context.current_session.referrer_type or 'direct'}

- Prejšnje variante: {user_context.current_session.previous_variants or 'None'}

VPOGLEDI V KONTEKST:

{analyze_user_context()}

KONTEKST PERSONALIZACIJE:

- Ocena angažiranosti: {profile.engagement_score:.2f}

- Verjetnost konverzije: {profile.conversion_likelihood:.2f}

- Stil interakcije: {profile.interaction_style}

- Prej uspešne variante: {

Ta obsežen poziv omogoča Amazon Bedrocku, da deluje kot inteligentni agent, sprejemajoč niansirane odločitve, namesto da bi se zanašal na groba naključna dodeljevanja. Z zagotavljanjem dostopa do različnih orodij za pridobivanje in analizo podatkov zagotavlja, da ima model vse potrebne informacije za optimizacijo individualnih preferenc uporabnikov in ciljev eksperimentov. Ta pristop bistveno izboljša natančnost in hitrost A/B testiranja, kar vodi do učinkovitejših in personaliziranih uporabniških izkušenj. Takšna izvorna uporaba orodij je močna funkcija, podobna konceptom, raziskanim v Amazon Bedrock AgentCore.

Odklepanje razširljivega in personaliziranega eksperimentiranja

Integracija AI, zlasti prek Amazon Bedrocka, v metodologije A/B testiranja pomeni ključen prehod od širokih, naključnih eksperimentov k natančnim, prilagodljivim in personaliziranim interakcijam. Ta mehanizem, ki ga poganja AI, ne le blaži omejitve tradicionalnih pristopov – kot so počasna konvergenca in visok šum – ampak uvaja tudi neprimerljive zmožnosti za optimizacijo v realnem času. Z dinamičnim dodeljevanjem variant na podlagi individualnega uporabniškega konteksta, zgodovine vedenja in prediktivnih vpogledov lahko organizacije dosežejo hitrejše rezultate, pridobijo globlje, uporabne vpoglede in zagotovijo resnično prilagojene uporabniške izkušnje.

Brezstrežniška arhitektura, ki jo podpirajo storitve AWS, kot sta Amazon ECS Fargate in Amazon DynamoDB, zagotavlja, da ta sofisticiran sistem ostane razširljiv in stroškovno učinkovit, sposoben obvladati različne obremenitve brez ročnega posredovanja. Ta tehnološki preskok omogoča podjetjem, da presežejo zgolj prepoznavanje "zmagovalne" variante za splošno občinstvo in se usmerijo k razumevanju, kaj najbolje odmeva pri vsakem edinstvenem uporabniku v katerem koli trenutku. Prihodnost optimizacije uporabniške izkušnje je nedvomno prilagodljiva, inteligentna in jo poganja AI, kar postavlja nov standard za razvoj digitalnih izdelkov in storitev.

Pogosta vprašanja

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

Bodite na tekočem

Prejemajte najnovejše AI novice po e-pošti.