Revolucioniranje A/B testiranja uz AI i Amazon Bedrock

A/B testiranje dugo je bilo temelj optimizacije korisničkih iskustava, usavršavanja poruka i poboljšanja tokova konverzije. Ipak, njegovo tradicionalno oslanjanje na nasumično dodjeljivanje često znači duge cikluse testiranja, ponekad tjednima, samo da bi se postigla statistička značajnost. Ovaj proces, iako učinkovit, inherentno je spor i često propušta rane, ključne signale skrivene u ponašanju korisnika.

Predstavljamo budućnost eksperimentiranja: sustav za A/B testiranje potpomognut umjetnom inteligencijom, izgrađen pomoću vrhunskih usluga kao što su Amazon Bedrock, Amazon Elastic Container Service (ECS) i Amazon DynamoDB. Ovaj inovativni sustav nadilazi konvencionalne metode inteligentnim analiziranjem korisničkog konteksta za donošenje dinamičnih, personaliziranih odluka o dodjeljivanju varijanti tijekom eksperimenta. Rezultat? Smanjen 'šum', ranije prepoznavanje značajnih obrazaca ponašanja i dramatično ubrzan put do pouzdanih zaključaka temeljenih na podacima. Ovaj će članak istražiti arhitekturu i metodologiju iza izgradnje takvog sustava, nudeći nacrt za skalabilno, adaptivno i personalizirano eksperimentiranje potpomognuto AWS uslugama bez poslužitelja.

Prevladavanje ograničenja tradicionalnog A/B testiranja

Tradicionalno A/B testiranje djeluje na jednostavnom principu: nasumično dodijeliti korisnike različitim varijantama (A ili B), prikupiti podatke i proglasiti pobjednika na temelju unaprijed definiranih metrika. Iako je temeljni, ovaj pristup opterećen je inherentnim ograničenjima koja mogu ometati brzu optimizaciju i duboke uvide:

- Isključivo nasumično dodjeljivanje: Čak i kada rani podaci ukazuju na značajne razlike u korisničkim preferencijama ili ponašanju, tradicionalno A/B testiranje strogo se pridržava nasumične distribucije. To znači da korisnici mogu biti izloženi suboptimalnim varijantama dulje vrijeme, čak i ako se alternativa jasno bolje ponaša za njihov specifični profil.

- Spora konvergencija: Potreba za prikupljanjem statistički značajne količine podataka često znači da se eksperimenti vuku tjednima. Ovo kašnjenje može usporiti iteracije proizvoda, odgoditi prilike za prihode i dovesti organizacije u nepovoljan konkurentski položaj.

- Visoka razina 'šuma': Općenito nasumično dodjeljivanje može izložiti korisnike varijantama koje su jasno neusklađene s njihovim potrebama ili preferencijama. Ovaj 'šum' može zamagliti stvarne uvide, otežavajući razaznavanje učinkovitih strategija i ponekad zahtijevajući opsežnu post-hoc analizu za segmentiranje podataka radi jasnoće.

- Teret ručne optimizacije: Identificiranje nijansiranih obrazaca ponašanja ili preferencija specifičnih za segment obično zahtijeva značajnu ručnu analizu nakon završetka eksperimenta. Ovaj reaktivni pristup je dugotrajan i često ne uspijeva učinkovito iskoristiti signale u stvarnom vremenu.

Razmotrite scenarij maloprodaje: tvrtka testira dva gumba za poziv na akciju (CTA): 'Kupi sada' (Varijanta A) naspram 'Kupi sada – besplatna dostava' (Varijanta B). Početni podaci mogli bi pokazati da Varijanta B nadmašuje. Međutim, dublja, ručna analiza mogla bi otkriti da premium članovi (koji već imaju besplatnu dostavu) oklijevaju s Varijantom B, dok se lovci na ponude hrle na nju. Mobilni korisnici, obrnuto, mogli bi preferirati Varijantu A zbog veličine zaslona. Tradicionalne metode bi u prosjeku uzimale ova raznolika ponašanja tijekom dugog razdoblja, što otežava djelovanje na nijansirane preferencije bez opsežne, ručne segmentacije. Upravo je tu snaga AI-potpomognutog dodjeljivanja neprocjenjiva, omogućavajući prilagodbu u stvarnom vremenu i superiorne ishode A/B testiranja.

Arhitektura adaptivnog sustava za A/B testiranje s AWS-om

Adaptivni sustav za A/B testiranje označava značajnu evoluciju u odnosu na svoj tradicionalni pandan. Integriranjem konteksta korisnika u stvarnom vremenu i ranih obrazaca ponašanja, omogućuje pametnije, dinamičnije dodjeljivanje varijanti. U svojoj srži, ovo rješenje koristi inteligentne mogućnosti Amazon Bedrocka, koji, umjesto da svakog korisnika dodijeli fiksnoj varijanti, procjenjuje individualni korisnički kontekst, dohvaća povijesne podatke o ponašanju i odabire najoptimalniju varijantu za tu specifičnu interakciju.

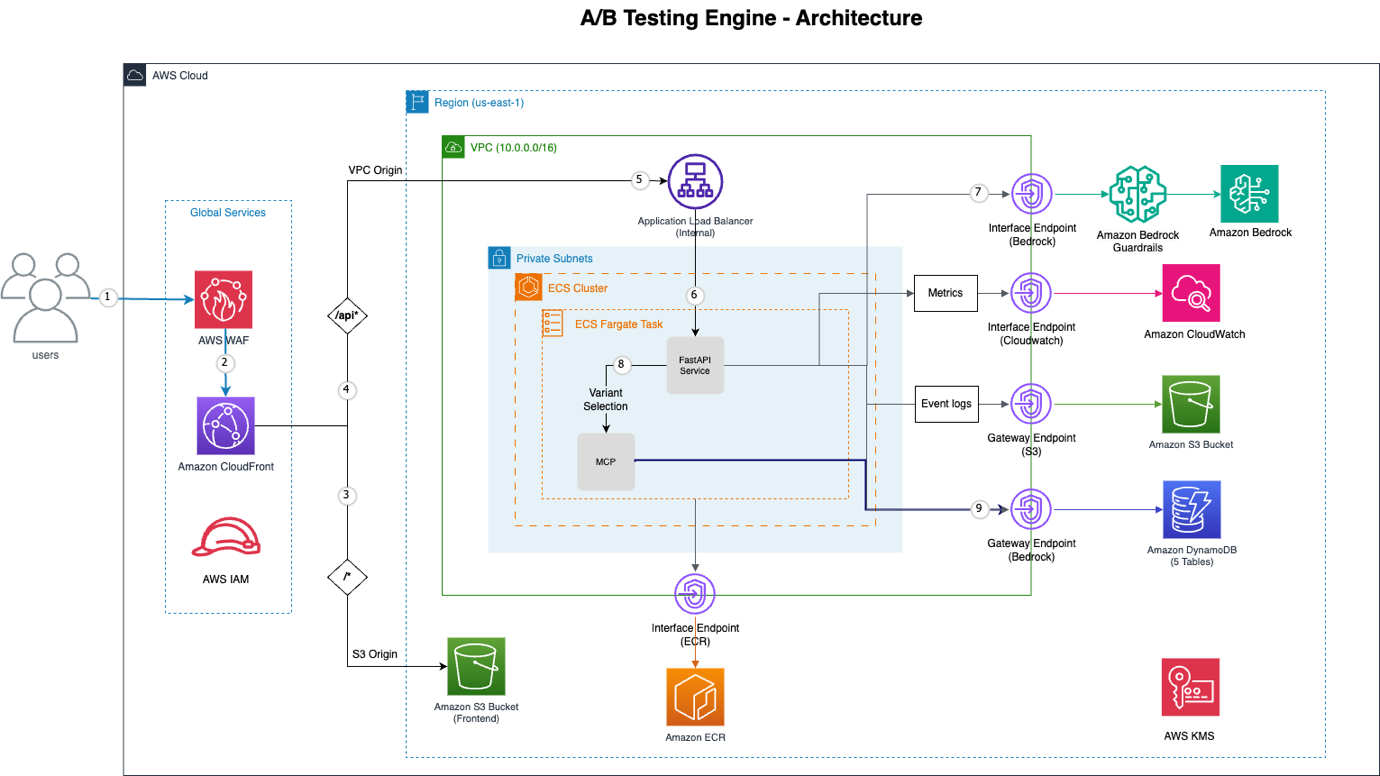

Sustav je izgrađen na robusnoj arhitekturi bez poslužitelja unutar AWS-a, osiguravajući skalabilnost, otpornost i učinkovitost:

Slika 1: Arhitektura sustava za A/B testiranje

Evo pregleda ključnih AWS komponenti koje to omogućuju:

| AWS Usluga | Funkcionalnost |

|---|---|

| Amazon CloudFront | Globalna mreža za isporuku sadržaja (CDN) koja pruža zaštitu od distribuiranog uskraćivanja usluge (DDoS), odvraćanje od SQL injekcija i ograničavanje stope. |

| AWS WAF | Vatrozid web aplikacija integriran s CloudFrontom za poboljšanu sigurnost. |

| VPC Origin | Uspostavlja privatnu vezu s Amazona CloudFront na interni Application Load Balancer, eliminirajući izloženost javnom internetu za pozadinske usluge. |

| Amazon ECS with AWS Fargate | Platforma za orkestraciju spremnika bez poslužitelja koja pokreće FastAPI aplikaciju, osiguravajući visoku dostupnost i skalabilnost bez upravljanja poslužiteljima. |

| Amazon Bedrock | Središnji AI mehanizam za donošenje odluka, koji koristi modele poput Claude Sonneta s izvornom upotrebom alata za inteligentan odabir varijanti. |

| Model Context Protocol (MCP) | Pruža strukturiran pristup podacima o ponašanju korisnika i eksperimentima, omogućujući Bedrocku učinkovito dohvaćanje specifičnih informacija. |

| VPC Endpoints | Osigurava privatnu povezanost s AWS uslugama kao što su Bedrock, DynamoDB, S3, ECR i CloudWatch, poboljšavajući sigurnost i smanjujući latenciju. |

| Amazon DynamoDB | Potpuno upravljana, NoSQL baza podataka bez poslužitelja koja nudi pet tablica za eksperimente, događaje, dodjeljivanja, korisničke profile i skupne zadatke. |

| Amazon S3 | Koristi se za hosting statičkog frontenda i trajnu pohranu dnevnika događaja, nudeći visoku dostupnost i skalabilnost. |

Ova arhitektura pruža moćnu i adaptivnu platformu za eksperimentiranje, omogućavajući organizacijama da nadiđu ograničenja nasumičnog dodjeljivanja i prihvate istinski inteligentan pristup A/B testiranju.

Uloga Amazon Bedrocka u inteligentnom dodjeljivanju varijanti

Prava inovacija ovog sustava za A/B testiranje leži u njegovoj sposobnosti kombiniranja više podatkovnih točaka – korisničkog konteksta, povijesnog ponašanja, obrazaca od sličnih korisnika i metrika performansi u stvarnom vremenu – za odabir najučinkovitije varijante. U srcu ove inteligencije je Amazon Bedrock, posebno njegove mogućnosti za implementaciju naprednih generativnih AI modela poput Claude Sonneta s izvornom upotrebom alata. Ova moćna kombinacija omogućuje sustavu da oponaša stručnjaka za A/B testiranje, donoseći odluke u stvarnom vremenu, temeljene na podacima, koje se prilagođavaju individualnim korisničkim interakcijama.

Kada korisnik inicira zahtjev za varijantom, sustav ne odabire jednostavno 'A' ili 'B'. Umjesto toga, konstruira sveobuhvatan prompt koji Amazon Bedrocku pruža sve potrebne informacije za donošenje informirane, optimalne odluke. Ovaj proces koristi Bedrockovu sposobnost tumačenja složenih uputa i korištenja unaprijed definiranih alata za prikupljanje dodatnog konteksta, osiguravajući da AI ima potpunu sliku prije preporučivanja dodjeljivanja. Za dublje razumijevanje kako se takvi inteligentni agenti evaluiraju u proizvodnji, razmislite o istraživanju resursa poput Evaluacija AI agenata za proizvodnju: praktični vodič za Strands' Evals.

Prompt za AI odluke: Kontekstualna inteligencija u akciji

Učinkovitost donošenja odluka Amazon Bedrocka ovisi o pažljivo izrađenoj strukturi prompta koja informira AI. Ovaj prompt sastoji se od dva glavna dijela: sistemskog prompta koji definira ulogu i ponašanje Bedrocka, i korisničkog prompta koji pruža specifične, kontekstualne podatke u stvarnom vremenu za odluku. Ovaj dizajn osigurava da AI djeluje unutar definiranih granica dok koristi bogate, dinamičke informacije.

Evo konceptualnog pogleda na strukturu prompta koju Amazon Bedrock prima:

# System Prompt (defines Amazon Bedrock's role and behavior)

system_prompt =

"""

You are an expert A/B testing optimization specialist with access to tools for gathering user behavior data.

CRITICAL INSTRUCTIONS:

1. ALWAYS call get_user_assignment FIRST to check for existing assignments

2. Only call other tools if you need specific information to make a better decision

3. Call tools based on what information would be valuable for this specific decision

4. If user has existing assignment, keep it unless there's strong evidence (30%+ improvement) to change

5. CRITICAL: Your final response MUST be ONLY valid JSON with no additional text, explanations, or commentary before or after the JSON object

Available tools:

- get_user_assignment: Check existing variant assignment (CALL THIS FIRST)

- get_user_profile: Get user behavioral profile and preferences

- get_similar_users: Find users with similar behavior patterns

- get_experiment_context: Get experiment configuration and performance

- get_session_context: Analyze current session behavior

- get_user_journey: Get user's interaction history

- get_variant_performance: Get variant performance metrics

- analyze_user_behavior: Deep behavioral analysis from event history

- update_user_profile: Update user profile with AI-derived insights

- get_profile_learning_status: Check profile data quality and confidence

- batch_update_profiles: Batch update multiple user profiles

Make intelligent, data-driven decisions. Use the tools you need to gather sufficient context for optimal variant selection.

RESPONSE FORMAT: Return ONLY the JSON object. Do not include any text before or after it."""

# User Prompt (provides specific decision context)

prompt = f"""Select the optimal variant for this user in experiment {experiment_id}.

USER CONTEXT:

- User ID: {user_context.user_id}

- Session ID: {user_context.session_id}

- Device: {user_context.device_type} (Mobile: {bool(user_context.is_mobile)})

- Current Page: {user_context.current_session.current_page}

- Referrer: {user_context.current_session.referrer_type or 'direct'}

- Previous Variants: {user_context.current_session.previous_variants or 'None'}

CONTEXT INSIGHTS:

{analyze_user_context()}

PERSONALIZATION CONTEXT:

- Engagement Score: {profile.engagement_score:.2f}

- Conversion Likelihood: {profile.conversion_likelihood:.2f}

- Interaction Style: {profile.interaction_style}

- Previously Successful Variants: {

Ovaj sveobuhvatan prompt omogućuje Amazon Bedrocku da djeluje kao inteligentni agent, donoseći nijansirane odluke umjesto da se oslanja na gruba nasumična dodjeljivanja. Pružanjem pristupa raznim alatima za dohvaćanje i analizu podataka, osigurava da model ima sve potrebne informacije za optimizaciju individualnih korisničkih preferencija i eksperimentalnih ciljeva. Ovaj pristup značajno poboljšava preciznost i brzinu A/B testiranja, potičući učinkovitija i personaliziranija korisnička iskustva. Takva izvorna upotreba alata je moćna značajka, slična konceptima istraženim u Amazon Bedrock AgentCore.

Otključavanje skalabilnog i personaliziranog eksperimentiranja

Integracija AI, posebno putem Amazon Bedrocka, u metodologije A/B testiranja označava ključnu promjenu od širokih, nasumičnih eksperimenata do preciznih, adaptivnih i personaliziranih interakcija. Ovaj sustav potpomognut umjetnom inteligencijom ne samo da ublažava ograničenja tradicionalnih pristupa – poput spore konvergencije i visokog 'šuma' – već i uvodi neusporedive mogućnosti za optimizaciju u stvarnom vremenu. Dinamičnim dodjeljivanjem varijanti na temelju individualnog konteksta korisnika, povijesti ponašanja i prediktivnih uvida, organizacije mogu postići brže rezultate, prikupiti dublje djelotvorne informacije i pružiti istinski prilagođena korisnička iskustva.

Arhitektura bez poslužitelja potkrijepljena AWS uslugama poput Amazon ECS Fargate i Amazon DynamoDB osigurava da ovaj sofisticirani sustav ostaje skalabilan i isplativ, sposoban za obradu različitih opterećenja bez ručne intervencije. Ovaj tehnološki skok omogućuje tvrtkama da nadiđu jednostavno identificiranje 'pobjedničke' varijante za opću publiku, prema razumijevanju što najbolje rezonira sa svakim jedinstvenim korisnikom u bilo kojem trenutku. Budućnost optimizacije korisničkog iskustva je nedvojbeno adaptivna, inteligentna i potpomognuta umjetnom inteligencijom, postavljajući novi standard za način na koji se digitalni proizvodi i usluge razvijaju.

Izvorni izvor

https://aws.amazon.com/blogs/machine-learning/build-an-ai-powered-a-b-testing-engine-using-amazon-bedrock/Često postavljana pitanja

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

Budite u toku

Primajte najnovije AI vijesti na e-mail.