Revolucionando las pruebas A/B con IA y Amazon Bedrock

Las pruebas A/B han sido durante mucho tiempo la piedra angular para optimizar las experiencias de usuario, refinar la mensajería y mejorar los flujos de conversión. Sin embargo, su dependencia tradicional de la asignación aleatoria a menudo significa ciclos de prueba prolongados, que a veces se extienden por semanas, solo para lograr significancia estadística. Este proceso, aunque efectivo, es inherentemente lento y con frecuencia pasa por alto señales tempranas y cruciales ocultas en el comportamiento del usuario.

Así llega el futuro de la experimentación: un motor de pruebas A/B impulsado por IA construido utilizando servicios de vanguardia como Amazon Bedrock, Amazon Elastic Container Service (ECS) y Amazon DynamoDB. Este innovador sistema trasciende los métodos convencionales al analizar inteligentemente el contexto del usuario para tomar decisiones dinámicas y personalizadas de asignación de variantes durante un experimento. ¿El resultado? Menos 'ruido', una identificación más temprana de patrones de comportamiento significativos y un camino dramáticamente acelerado hacia conclusiones seguras y basadas en datos. Este artículo explorará la arquitectura y la metodología detrás de la construcción de dicho motor, ofreciendo un plan para una experimentación escalable, adaptativa y personalizada impulsada por servicios sin servidor de AWS.

Superando las limitaciones de las pruebas A/B tradicionales

Las pruebas A/B tradicionales operan bajo un principio sencillo: asignar usuarios aleatoriamente a diferentes variantes (A o B), recopilar datos y declarar un ganador basándose en métricas predefinidas. Aunque fundamental, este enfoque está plagado de limitaciones inherentes que pueden dificultar la optimización rápida y la obtención de información profunda:

- Asignación únicamente aleatoria: Incluso cuando los datos iniciales sugieren diferencias significativas en las preferencias o comportamientos del usuario, las pruebas A/B tradicionales se adhieren estrictamente a la distribución aleatoria. Esto significa que los usuarios podrían estar expuestos a variantes subóptimas durante períodos prolongados, incluso si una alternativa funciona claramente mejor para su perfil específico.

- Convergencia lenta: La necesidad de recopilar un volumen de datos estadísticamente significativo a menudo significa que los experimentos se prolongan durante semanas. Este retraso puede ralentizar las iteraciones de productos, posponer oportunidades de ingresos y colocar a las organizaciones en desventaja competitiva.

- Alto nivel de 'ruido': Una asignación aleatoria generalizada puede exponer a los usuarios a variantes que están claramente desalineadas con sus necesidades o preferencias. Este 'ruido' puede oscurecer información genuina, dificultando la distinción de estrategias efectivas y, a veces, requiriendo un extenso análisis post-hoc para segmentar los datos y obtener claridad.

- Carga de optimización manual: La identificación de patrones de comportamiento matizados o preferencias específicas de un segmento generalmente requiere un análisis manual significativo una vez concluido el experimento. Este enfoque reactivo consume mucho tiempo y a menudo no logra aprovechar eficazmente las señales en tiempo real.

Considere un escenario de venta al por menor: una empresa prueba dos botones de llamada a la acción (CTA): "Comprar ahora" (Variante A) frente a "Comprar ahora – Envío gratis" (Variante B). Los datos iniciales podrían mostrar que la Variante B supera a la A. Sin embargo, un análisis manual más profundo podría revelar que los miembros 'premium' (que ya tienen envío gratis) dudan con la Variante B, mientras que los cazadores de ofertas acuden a ella. Los usuarios de dispositivos móviles, por el contrario, podrían preferir la Variante A debido al tamaño de la pantalla. Los métodos tradicionales promediarían estos diversos comportamientos durante un largo período, dificultando la acción sobre preferencias matizadas sin una segmentación manual exhaustiva. Aquí es precisamente donde el poder de la asignación asistida por IA se vuelve invaluable, permitiendo la adaptación en tiempo real y resultados superiores en las pruebas A/B.

Diseño de un motor de pruebas A/B adaptativo con AWS

El motor de pruebas A/B adaptativo marca una evolución significativa con respecto a su contraparte tradicional. Al integrar el contexto del usuario en tiempo real y los patrones de comportamiento iniciales, permite asignaciones de variantes más inteligentes y dinámicas. En su núcleo, esta solución aprovecha las capacidades inteligentes de Amazon Bedrock, que, en lugar de asignar a cada usuario a una variante fija, evalúa el contexto individual del usuario, recupera datos históricos de comportamiento y selecciona la variante más óptima para esa interacción específica.

El sistema se basa en una arquitectura robusta y sin servidor dentro de AWS, lo que garantiza escalabilidad, resiliencia y eficiencia:

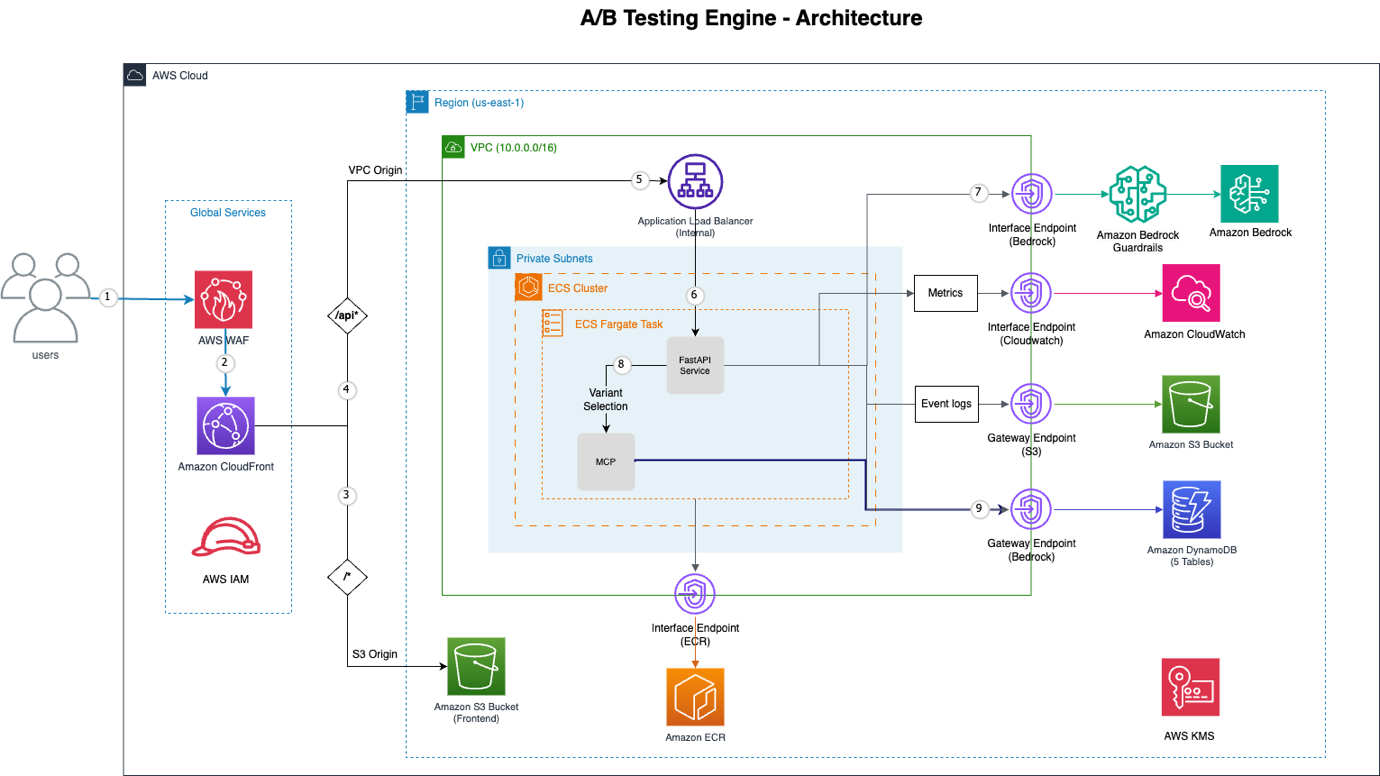

Figura 1: Arquitectura del motor de pruebas A/B

Aquí se presenta un desglose de los componentes clave de AWS que lo hacen posible:

| Servicio de AWS | Funcionalidad |

|---|---|

| Amazon CloudFront | Red de entrega de contenido (CDN) global que proporciona protección contra ataques de denegación de servicio distribuidos (DDoS), disuasión de inyección SQL y limitación de tasas. |

| AWS WAF | Firewall de aplicaciones web integrado con CloudFront para una seguridad mejorada. |

| VPC Origin | Establece una conexión privada desde Amazon CloudFront a un Application Load Balancer interno, eliminando la exposición a internet pública para los servicios de backend. |

| Amazon ECS con AWS Fargate | Plataforma de orquestación de contenedores sin servidor que ejecuta la aplicación FastAPI, asegurando alta disponibilidad y escalabilidad sin gestionar servidores. |

| Amazon Bedrock | El motor central de decisión de IA, que utiliza modelos como Claude Sonnet con uso nativo de herramientas para la selección inteligente de variantes. |

| Model Context Protocol (MCP) | Proporciona acceso estructurado a los datos de comportamiento del usuario y de experimentos, permitiendo a Bedrock recuperar información específica de manera eficiente. |

| VPC Endpoints | Garantiza la conectividad privada a servicios de AWS como Bedrock, DynamoDB, S3, ECR y CloudWatch, mejorando la seguridad y reduciendo la latencia. |

| Amazon DynamoDB | Una base de datos NoSQL completamente administrada y sin servidor que proporciona cinco tablas para experimentos, eventos, asignaciones, perfiles de usuario y trabajos por lotes. |

| Amazon S3 | Utilizado para el alojamiento de frontend estático y el almacenamiento duradero de registros de eventos, ofreciendo alta disponibilidad y escalabilidad. |

Esta arquitectura ofrece una plataforma de experimentación potente y adaptativa, que permite a las organizaciones superar las limitaciones de la asignación aleatoria y adoptar un enfoque verdaderamente inteligente para las pruebas A/B.

El papel de Amazon Bedrock en la asignación inteligente de variantes

La verdadera innovación de este motor de pruebas A/B reside en su capacidad para combinar múltiples puntos de datos (contexto del usuario, comportamiento histórico, patrones de usuarios similares y métricas de rendimiento en tiempo real) para elegir la variante más efectiva. En el corazón de esta inteligencia se encuentra Amazon Bedrock, particularmente sus capacidades para implementar modelos avanzados de IA generativa como Claude Sonnet con uso nativo de herramientas. Esta poderosa combinación permite al sistema imitar a un especialista experto en pruebas A/B, tomando decisiones en tiempo real basadas en datos que se adaptan a las interacciones individuales del usuario.

Cuando un usuario inicia una solicitud de variante, el sistema no se limita a elegir 'A' o 'B'. En su lugar, construye un 'prompt' integral que proporciona a Amazon Bedrock toda la información necesaria para tomar una decisión informada y óptima. Este proceso aprovecha la capacidad de Bedrock para interpretar instrucciones complejas y utilizar herramientas predefinidas para recopilar contexto adicional, asegurando que la IA tenga una imagen completa antes de recomendar una asignación. Para una comprensión más profunda de cómo se evalúan dichos agentes inteligentes en producción, considere explorar recursos como Evaluación de agentes de IA para producción: Una guía práctica de los 'Evals' de Strands.

El 'Prompt' de decisión de IA: Inteligencia contextual en acción

La eficacia de la toma de decisiones de Amazon Bedrock depende de la estructura del 'prompt' meticulosamente elaborada que informa a la IA. Este 'prompt' se compone de dos partes principales: un 'prompt' del sistema que define el rol y el comportamiento de Bedrock, y un 'prompt' del usuario que proporciona datos contextuales específicos y en tiempo real para la decisión. Este diseño garantiza que la IA opere dentro de límites definidos mientras aprovecha información rica y dinámica.

Aquí se muestra un vistazo conceptual de la estructura del 'prompt' que recibe Amazon Bedrock:

# Prompt del sistema (define el rol y el comportamiento de Amazon Bedrock)

system_prompt =

"""

Usted es un especialista experto en optimización de pruebas A/B con acceso a herramientas para recopilar datos de comportamiento del usuario.

INSTRUCCIONES CRÍTICAS:

1. SIEMPRE llamar a get_user_assignment PRIMERO para verificar asignaciones existentes

2. Solo llamar a otras herramientas si necesita información específica para tomar una mejor decisión

3. Llamar a las herramientas basándose en la información que sería valiosa para esta decisión específica

4. Si el usuario tiene una asignación existente, mantenerla a menos que haya evidencia sólida (mejora del 30%+) para cambiarla

5. CRÍTICO: Su respuesta final DEBE ser SOLAMENTE JSON válido sin texto adicional, explicaciones o comentarios antes o después del objeto JSON

Herramientas disponibles:

- get_user_assignment: Verificar la asignación de variante existente (LLAMAR A ESTO PRIMERO)

- get_user_profile: Obtener el perfil de comportamiento y las preferencias del usuario

- get_similar_users: Encontrar usuarios con patrones de comportamiento similares

- get_experiment_context: Obtener la configuración y el rendimiento del experimento

- get_session_context: Analizar el comportamiento de la sesión actual

- get_user_journey: Obtener el historial de interacciones del usuario

- get_variant_performance: Obtener métricas de rendimiento de la variante

- analyze_user_behavior: Análisis de comportamiento profundo del historial de eventos

- update_user_profile: Actualizar el perfil del usuario con información derivada de la IA

- get_profile_learning_status: Verificar la calidad y confianza de los datos del perfil

- batch_update_profiles: Actualización por lotes de múltiples perfiles de usuario

Tomar decisiones inteligentes basadas en datos. Utilizar las herramientas necesarias para recopilar suficiente contexto para una selección óptima de variantes.

FORMATO DE RESPUESTA: Devolver SOLO el objeto JSON. No incluir texto antes o después."""

# Prompt del usuario (proporciona contexto de decisión específico)

prompt = f"""Seleccione la variante óptima para este usuario en el experimento {experiment_id}.

CONTEXTO DEL USUARIO:

- ID de usuario: {user_context.user_id}

- ID de sesión: {user_context.session_id}

- Dispositivo: {user_context.device_type} (Móvil: {bool(user_context.is_mobile)})

- Página actual: {user_context.current_session.current_page}

- Referente: {user_context.current_session.referrer_type or 'direct'}

- Variantes previas: {user_context.current_session.previous_variants or 'None'}

PERSPECTIVAS DE CONTEXTO:

{analyze_user_context()}

CONTEXTO DE PERSONALIZACIÓN:

- Puntuación de participación: {profile.engagement_score:.2f}

- Probabilidad de conversión: {profile.conversion_likelihood:.2f}

- Estilo de interacción: {profile.interaction_style}

- Variantes previamente exitosas: {

Este 'prompt' exhaustivo capacita a Amazon Bedrock para actuar como un agente inteligente, tomando decisiones matizadas en lugar de depender de asignaciones aleatorias toscas. Al proporcionar acceso a varias herramientas para la recuperación y el análisis de datos, garantiza que el modelo tenga toda la información necesaria para optimizar las preferencias individuales del usuario y los objetivos del experimento. Este enfoque mejora significativamente la precisión y la velocidad de las pruebas A/B, impulsando experiencias de usuario más efectivas y personalizadas. Este uso nativo de herramientas es una característica poderosa, similar a conceptos explorados en Amazon Bedrock AgentCore.

Desbloqueando la experimentación escalable y personalizada

La integración de la IA, particularmente a través de Amazon Bedrock, en las metodologías de pruebas A/B marca un cambio fundamental de los experimentos amplios y aleatorios a interacciones precisas, adaptativas y personalizadas. Este motor impulsado por IA no solo mitiga las limitaciones de los enfoques tradicionales —como la convergencia lenta y el alto 'ruido'—, sino que también introduce capacidades inigualables para la optimización en tiempo real. Al asignar dinámicamente variantes basadas en el contexto individual del usuario, el historial de comportamiento y la información predictiva, las organizaciones pueden lograr resultados más rápidos, obtener una inteligencia procesable más profunda y ofrecer experiencias de usuario verdaderamente personalizadas.

La arquitectura sin servidor respaldada por servicios de AWS como Amazon ECS Fargate y Amazon DynamoDB garantiza que este sofisticado sistema siga siendo escalable y rentable, capaz de manejar cargas variables sin intervención manual. Este avance tecnológico permite a las empresas ir más allá de la simple identificación de una variante "ganadora" para una audiencia general, hacia la comprensión de lo que resuena mejor con cada usuario único en un momento dado. El futuro de la optimización de la experiencia del usuario es innegablemente adaptativo, inteligente y potenciado por la IA, estableciendo un nuevo estándar para cómo evolucionan los productos y servicios digitales.

Fuente original

https://aws.amazon.com/blogs/machine-learning/build-an-ai-powered-a-b-testing-engine-using-amazon-bedrock/Preguntas Frecuentes

What are the primary limitations of traditional A/B testing methods?

How does an AI-powered A/B testing engine improve upon conventional A/B testing?

Which core AWS services are utilized to build this AI-powered A/B testing engine?

What role does Amazon Bedrock play in the intelligent variant assignment process?

What is the Model Context Protocol (MCP) and its significance in this architecture?

How does the AI decision prompt structure facilitate optimal variant selection?

What are the long-term benefits of implementing AI-powered A/B testing for organizations?

Mantente Actualizado

Recibe las últimas noticias de IA en tu correo.