Forradalmasítja a Tengerészeti Anomália Elemzést Ügynökségi MI-vel

A globális tengerészeti tevékenység hatalmas, összetett világa egyedi kihívásokat jelent a biztonság, az intelligencia és a kereskedelmi műveletek számára. A szokatlan hajóviselkedés – a váratlan mozgásoktól a ismert mintáktól való eltérésekig – azonosítása és megértése gyakran rengeteg időt, mély szakértelemet és eltérő adatforrások korrelációját igényli. A Windward, a Tengerészeti MI™ egyik vezetője, régóta biztosít kritikus intelligenciát a tengeri műveletekhez. Most, az AWS-szel együttműködve a Windward ügynökségi generatív MI-t használ ennek a folyamatnak az átalakítására, elszigetelt riasztásoktól az átfogó, kontextuális intelligenciáig.

Ez az úttörő partnerség célja a tengerészeti elemzők felhatalmazása, drasztikusan csökkentve a vizsgálati időt, és lehetővé téve számukra, hogy a nagy értékű döntéshozatalra összpontosítsanak a fáradságos adatgyűjtés helyett. A geospatiális intelligencia és a fejlett generatív MI ötvözésével a Windward új megoldása 360°-os rálátást biztosít, példátlan sebességgel és pontossággal előrejelezve a fenyegetéseket és védve a kritikus eszközöket a tengeren.

A Kihívás: Adattúlterheltségtől a Hasznosítható Betekintésekig

Történelmileg a tengerészeti anomáliák vizsgálata nagyrészt manuális és időigényes feladat volt. Az elemzők órákat töltöttek széttagolt információk átválogatásával, próbálva összekötni a különböző adatfolyamok közötti pontokat egy hajó anomális viselkedésének megértéséhez. Ez a folyamat nemcsak jelentős erőfeszítést, hanem mély szakértelemet is igényelt a tengerészeti tevékenységek, időjárási minták és geopolitikai események árnyalatainak értelmezéséhez.

A Windward meglévő Korai Észlelő rendszere sikeresen azonosítja a gyanús mintázatokat, de a cél az volt, hogy felgyorsítsák az észleléstől a döntéshozatalig vezető utat. Az analitikai munkafolyamat optimalizálása és valóban "küldetésre kész" betekintések biztosítása érdekében a Windward három kulcsfontosságú stratégiai fejlesztést azonosított:

- Egységes Munkafolyamat: Minimalizálja az elemzők külső adatforrások konzultációjának szükségességét, zökkenőmentes és fókuszált analitikai környezetet teremtve.

- Szakértelem Optimalizálása: Automatizálja a kontextuális adatok (időjárás, hírek, kapcsolódó riasztások) gyűjtését és kezdeti korrelációját, lehetővé téve a domain szakértők számára, hogy értékes idejüket stratégiai értelmezésre és döntéshozatalra fordítsák.

- Átfogó Lefedettség: Egyszerűsítse az információk szintézisét, hogy lehetővé tegye több riasztás gyorsabb és mélyrehatóbb egyidejű vizsgálatát.

Ezen ambiciózus célok elérése érdekében a Windward együttműködött az AWS Generative AI Innovation Centerrel a MAI Expert™ kifejlesztésén, amely az első generatív MI tengerészeti ügynök, képes automatikusan kontextusba helyezni az összetett tengerészeti anomáliákat.

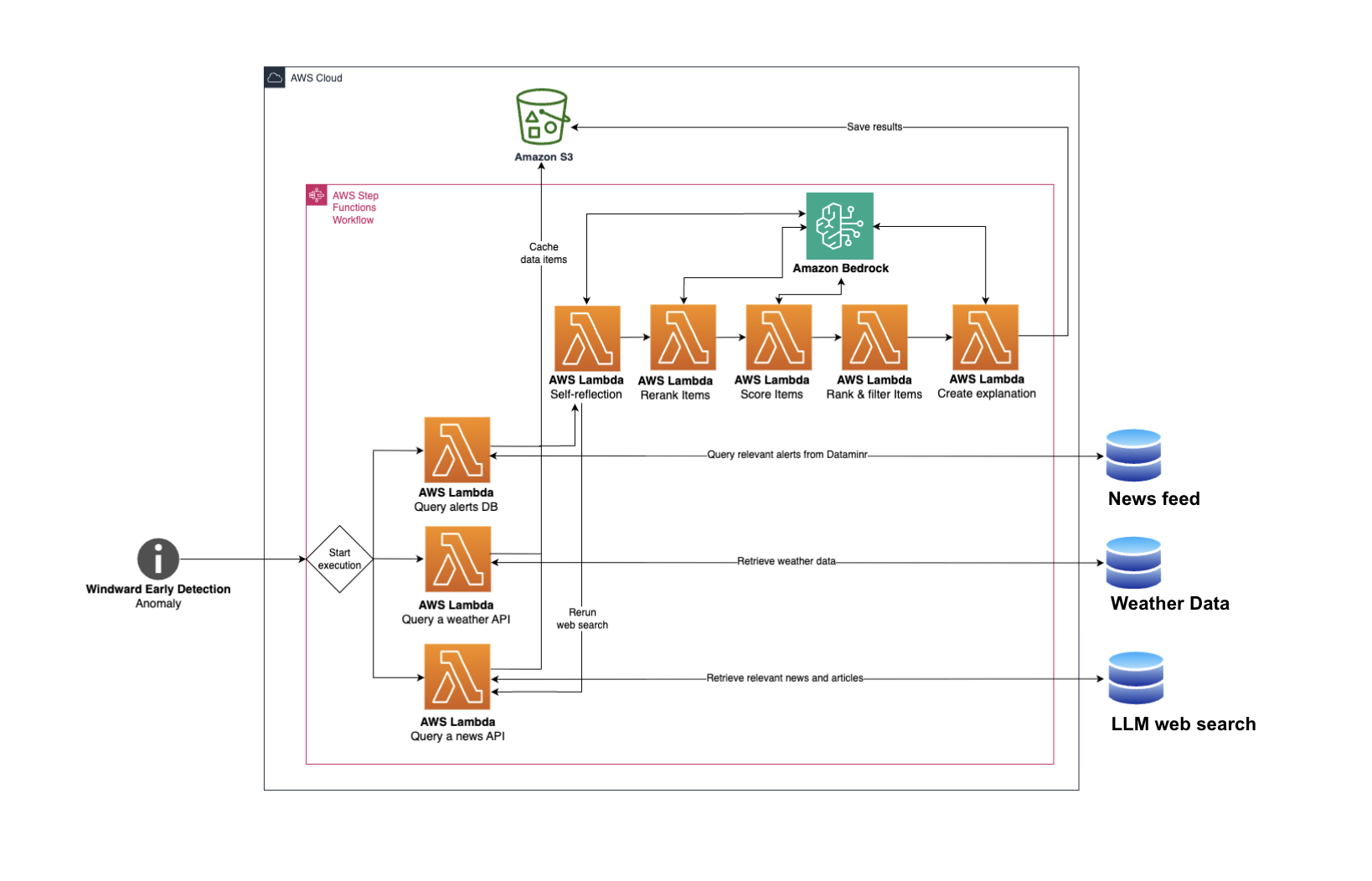

Ügynökségi Architektúra: Kontextuális Intelligencia Meghajtása AWS-sel

A Windward továbbfejlesztett megoldásának középpontjában a többlépéses, MI-alapú architektúrája áll, amelyet az AWS-en telepítettek. Ez a rendszer automatikusan lekéri a releváns adatokat különböző belső és külső forrásokból, és felhasználja ezeket az információkat egy szöveges leírás generálására, amely alaposan kontextusba helyezi a tengerészeti anomália eseményeket.

A folyamat akkor kezdődik, amikor a Windward Korai Észlelő rendszere anomáliát azonosít. A releváns metaadatokat – mint például az anomália időbélyegzője, régiókoordináták, anomália típusa és hajóosztály – a Windward belső adatbázisából nyerik ki.

Ezt a metaadatot ezután egy ügynökségi elemző rendszerbe táplálják, amelyet az Amazon Bedrockon futó nagy nyelvi modellek (LLM-ek) hajtanak meg. A teljes többlépéses anomália elemző folyamatot az AWS Step Functions segítségével irányítják, biztosítva a robusztus és skálázható munkafolyamatot.

Az irányított folyamat első lépése több, változatos külső adatforrás lekérdezését foglalja magában, releváns háttérinformációk gyűjtéséhez:

- Valós idejű Hírcsatorna: A nyilvános adatokból felfedezett riasztásokat és eseményjeleket lekérik és szűrik a tengerészeti anomália időpontja és helye alapján.

- Intelligens Webes Keresés: Az LLM-ek precíz keresési lekérdezéseket generálnak, lehetővé téve a naprakész webes keresési eredmények lekérését, amelyek valós idejű kontextust biztosítanak az anomáliához.

- Időjárási Adatok: Egy külső API-t használnak a kritikus időjárási adatok, beleértve a hőmérsékletet, szélsebességet és csapadékot, lekérésére az anomália adott helyére és idejére vonatkozóan.

Minden adatforrást külön AWS Lambda függvény segítségével kérdeznek le. Ez a moduláris megközelítés biztosítja a hatékonyságot és a skálázhatóságot, lehetővé téve új adatforrások könnyű integrálását szükség esetén.

Dinamikus Önreflexió és Adatkuráció

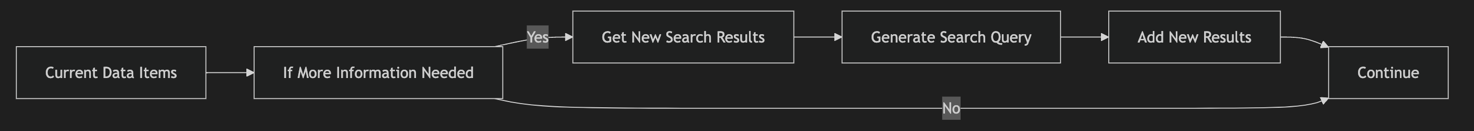

Az ügynökségi megoldás egyik alapvető innovációja az önreflexiós képessége, amely dinamikusan meghatározza a további adatlekérés szükségességét. A hírekből, webes keresésből és időjárásból származó kezdeti adatgyűjtés után a folyamat egy második lépésre vált. Itt egy különálló LLM – az Anthropic Claude-ja által meghajtva az Amazon Bedrockon keresztül – vizsgálja meg a lekérdezett adatelemeket.

Ez az LLM utasítást kap arra, hogy eldöntse, az eddig gyűjtött adatok elegendőek-e az anomália magyarázatára, vagy hiányoznak-e még bizonyos, az eseményhez kapcsolódó aspektusok. Ezután generálhat egy új, finomítottabb keresési lekérdezést további webes eredményekért, vagy jelezheti a folyamatnak, hogy folytassa. Ez az intelligens visszacsatolási hurok, amelyet a 2. ábra mutat be, lehetővé teszi a rendszer számára, hogy proaktívan keressen átfogóbb kontextust, hozzáfűzve azt a korábban gyűjtött információkhoz.

1. ábra. Megoldási architektúra, amely bemutatja az AWS szolgáltatásokat és a generatív MI-t.

1. ábra. Megoldási architektúra, amely bemutatja az AWS szolgáltatásokat és a generatív MI-t.

2. ábra. Önreflexiós logika az ügynökségi anomália elemző rendszerben.

2. ábra. Önreflexiós logika az ügynökségi anomália elemző rendszerben.

Ezen dinamikus adatlekérési és önreflexiós fázis után a rendszer kétlépcsős szűrési és rangsorolási folyamatot alkalmaz az irreleváns hírelemek eltávolítására és a legmagasabb minőségű kontextus biztosítására:

- Újrarangsorolás Amazon Rerank-kel: Egy MI modell, az Amazon Rerank, az anomáliához való relevanciájuk alapján rendezi az adatelemek kezdeti készletét. Ez a lépés kulcsfontosságú a magas visszahívás fenntartásához, hatékonyan csökkentve a jelöltek számát a következő szakaszhoz.

- LLM-alapú Pontosság Pontozás: Ezután minden legmagasabban rangsorolt elemet egy LLM tovább pontoz több dimenzióban, beleértve az időt, a helyszínt és a megfelelő hajótípust. A rendszer 0 és 100 közötti relevancia pontszámokat ad, csak azokat az adatelemeket megtartva, amelyek meghaladnak egy előre meghatározott küszöbértéket. Ez biztosítja a nagy pontosságot, garantálva, hogy csak a legrelevánsabb információk járulnak hozzá a végső elemzéshez.

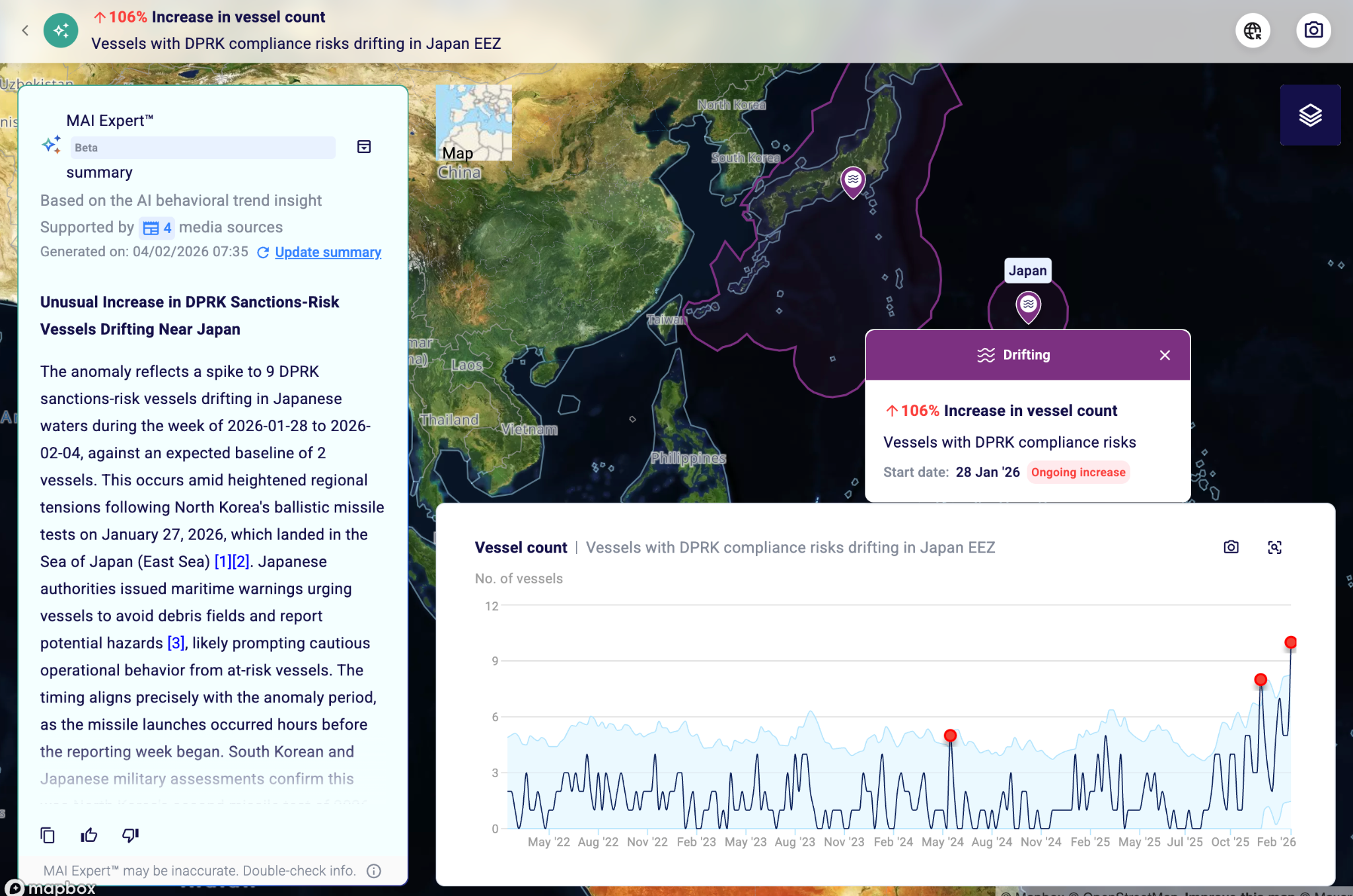

Hasznosítható Betekintések: A Kontextusba Helyezett Jelentés

Végül a gondosan szűrt és rangsorolt adatok egy másik LLM-nek kerülnek átadásra. Ez az LLM szintetizálja az összes összegyűjtött intelligenciát, hogy egy tömör, kontextusba helyezett jelentést készítsen az anomáliáról. A jelentés összefoglalja az észlelt tengerészeti esemény lehetséges okait, kockázatait és következményeit. Lényeges, hogy a Windward ügyfelei számára készült, és közvetlenül hivatkozik az összes felhasznált adatforrásra, teljes átláthatóságot biztosítva, és lehetővé téve a felhasználók számára az információk ellenőrzését és mélyebb belemerülését a mellékelt linkek követésével.

3. ábra. Példa a Windward MAI Expert™ által generált anomália jelentésre.

3. ábra. Példa a Windward MAI Expert™ által generált anomália jelentésre.

Ez a kimenet drasztikusan csökkenti az elemzők kognitív terhelését, egy kész narratívát kínálva nekik, amely az anomáliát a szélesebb operatív és geopolitikai kontextusában magyarázza meg.

Értékelés és Hatás

A teljes rendszert szigorúan értékelik egy átfogó történelmi tengerészeti anomália készlet alapján. Ez az értékelés gyakran magában foglalja az "LLM bíróként" megközelítést, amely a generált kontextuális jelentések minőségét, pontosságát és teljességét értékeli.

Az ügynökségi generatív MI megoldás következményei mélyrehatóak. Az adatgyűjtés és korreláció fáradságos folyamatának automatizálásával a Windward felhatalmazza a tengerészeti elemzőket, hogy:

- Hatékonyság Növelése: Jelentősen csökkenti a vizsgálatra fordított időt, felszabadítva értékes emberi erőforrásokat.

- Helyzetfelismerés Javítása: Mélyebb, kontextuálisabb megértést szerez az anomáliákról, túllépve az elszigetelt riasztásokon, átfogó intelligenciát nyújtva.

- Döntéshozatal Gyorsítása: Gyorsabb és megalapozottabb döntéseket tesz lehetővé, ami kritikus a fenyegetések előrejelzésében és az eszközök védelmében dinamikus tengerészeti környezetben.

- Szakértelem Optimalizálása: Lehetővé teszi a domain szakértők számára, hogy stratégiai értelmezésre és magas szintű elemzésre összpontosítsanak, egyedi készségeiket ott hasznosítva, ahol a legfontosabbak.

A Windward és az AWS együttműködése példázza, hogyan hasznosítható a legmodernebb generatív MI és felhőinfrastruktúra összetett valós problémák megoldására, átalakítva az olyan kritikus ágazatokat, mint a tengerészeti intelligencia, és új szabványt állítva fel a kontextuális anomália elemzés számára.

Gyakran ismételt kérdések

What is Windward's MAI Expert™ and how does it utilize generative AI?

How does the agentic maritime anomaly analysis solution work?

What AWS services are central to Windward's generative AI solution?

What are the primary challenges Windward aimed to solve with this generative AI approach?

How does the system ensure the relevance of retrieved information for a specific anomaly?

Maradjon naprakész

Kapja meg a legfrissebb AI híreket e-mailben.