Revolucionarizimi i Analizës së Anomalive Detare me AI Agjentike

Bota e gjerë dhe e ndërlikuar e aktivitetit detar global paraqet sfida unike për sigurinë, inteligjencën dhe operacionet komerciale. Identifikimi dhe kuptimi i sjelljes së pazakontë të anijeve – nga lëvizjet e papritura deri te devijimet nga modelet e njohura – shpesh kërkon kohë të jashtëzakonshme, ekspertizë të thellë në fushë dhe korrelacion të burimeve të ndryshme të të dhënave. Windward, një lider në AI Detare™, ka ofruar prej kohësh inteligjencë kritike për operacionet detare. Tani, në bashkëpunim me AWS, Windward po shfrytëzon AI-në gjeneruese agjentike për të transformuar këtë proces, duke kaluar nga alarmet e izoluara në inteligjencë gjithëpërfshirëse dhe kontekstuale.

Ky partneritet novator synon të fuqizojë analistët detarë, duke reduktuar ndjeshëm kohën e hetimit dhe duke i lejuar ata të fokusohen në vendimmarrje me vlerë të lartë në vend të mbledhjes së lodhshme të të dhënave. Duke bashkuar inteligjencën gjeohapësinore me AI-në e avancuar gjeneruese, zgjidhja e re e Windward ofron një pamje 360°, duke parashikuar kërcënimet dhe duke mbrojtur asetet kritike në det me shpejtësi dhe saktësi të paprecedentë.

Sfida: Nga Mbingarkesa e të Dhënave në Njohuri të Zbatueshme

Historikisht, hetimi i anomalive detare ishte një përpjekje thellësisht manuale dhe intensive në kohë. Analistët kalonin orë të tëra duke shoshitur informacionin e fragmentuar, duke u përpjekur të lidhnin pikat midis flukseve të ndryshme të të dhënave për të kuptuar sjelljen anormale të një anijeje. Ky proces kërkonte jo vetëm një përpjekje të konsiderueshme, por edhe ekspertizë të thellë të fushës për të interpretuar nuancat e aktiviteteve detare, modeleve të motit dhe ngjarjeve gjeopolitike.

Sistemi ekzistues i Zbulimit të Hershëm të Windward identifikon me sukses modelet e dyshimta, por qëllimi ishte të përshpejtohej rruga nga zbulimi në vendimmarrje. Për të optimizuar rrjedhën e punës analitike dhe për të ofruar njohuri vërtet "të gatshme për mision", Windward identifikoi tre përmirësime kyçe strategjike të nevojshme:

- Rrjedha e Unifikuar e Punës: Minimizimi i nevojës që analistët të konsultohen me burime të dhënash të jashtme, duke krijuar një mjedis analitik pa probleme dhe të fokusuar.

- Optimizimi i Ekspertizës: Automatizimi i mbledhjes dhe korrelacionit fillestar të të dhënave kontekstuale (moti, lajmet, alarmet e lidhura), duke i lejuar ekspertët e fushës të dedikojnë kohën e tyre të vlefshme për interpretim strategjik dhe vendimmarrje.

- Mbulimi Gjithëpërfshirës: Thjeshtimi i sintezës së informacionit për të mundësuar hetimin më të shpejtë dhe të thellë të alarmeve të shumta njëkohësisht.

Për të adresuar këto qëllime ambicioze, Windward bashkëpunoi me Qendrën e Inovacionit të AI Gjeneruese të AWS për të zhvilluar MAI Expert™, agjentin e parë detar të AI-së gjeneruese të aftë për të kontekstualizuar automatikisht anomalitë komplekse detare.

Arkitektura Agjentike: Fuqizimi i Inteligjencës Kontekstuale me AWS

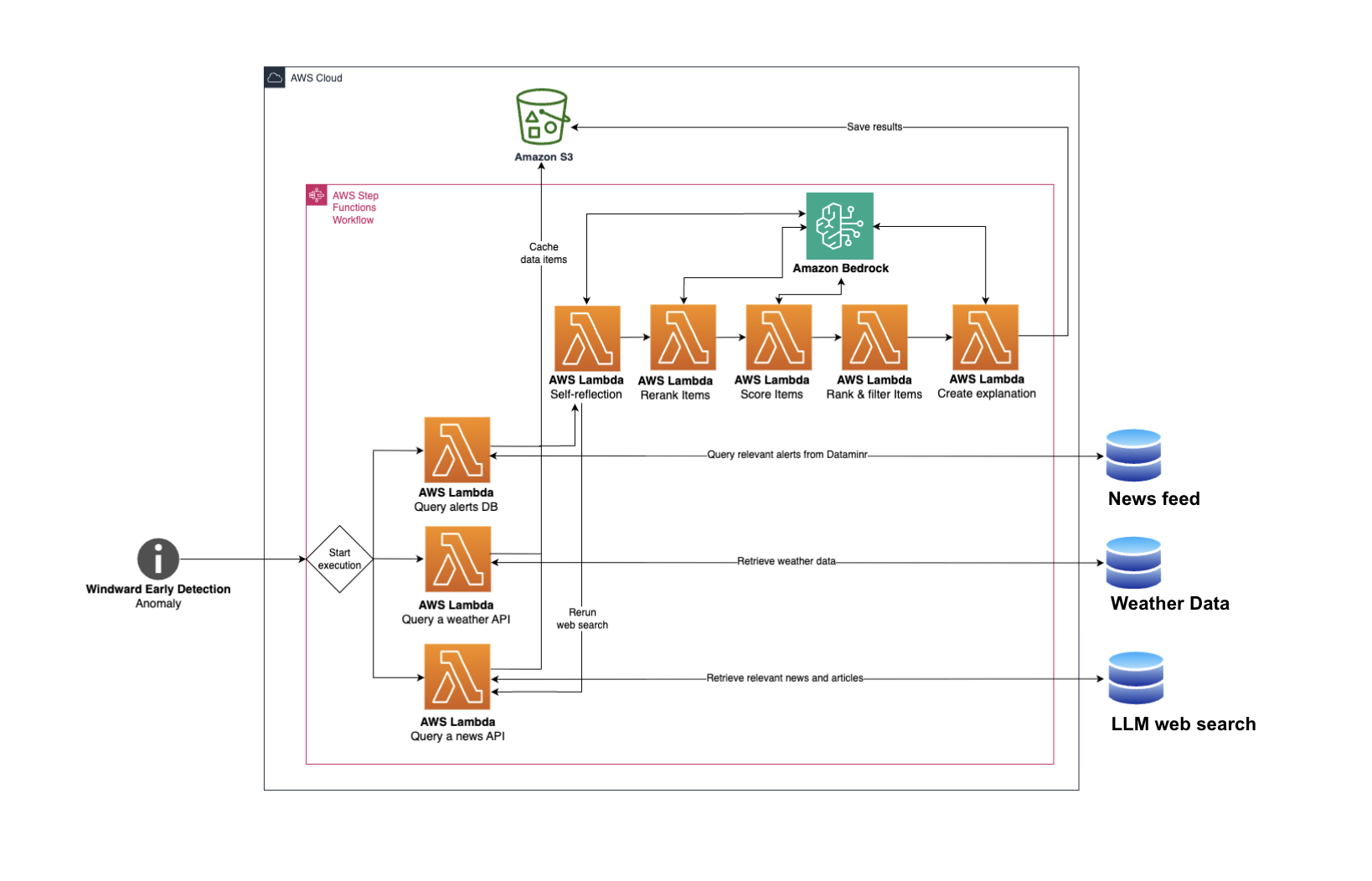

Zemra e zgjidhjes së përmirësuar të Windward qëndron në arkitekturën e saj me shumë hapa, të fuqizuar nga AI, e vendosur në AWS. Ky sistem merr automatikisht të dhëna relevante nga burime të ndryshme të brendshme dhe të jashtme dhe përdor këtë informacion për të gjeneruar një përshkrim tekstual që kontekstualizon tërësisht ngjarjet e anomalive detare.

Procesi fillon kur një anomali identifikohet nga sistemi i Zbulimit të Hershëm të Windward. Metadata relevante – si koha e anomalive, koordinatat e rajonit, lloji i anomalive dhe klasa e anijes – nxirret nga baza e të dhënave të brendshme të Windward.

Kjo metadata më pas futet në një sistem analize agjentike të fuqizuar nga modelet e mëdha gjuhësore (LLM) në Amazon Bedrock. I gjithë procesi i analizës së anomalive me shumë hapa orkestrohet duke përdorur AWS Step Functions, duke siguruar një rrjedhë pune të qëndrueshme dhe të shkallëzueshme.

Hapi i parë në këtë proces të orkestruar përfshin kërkimin e burimeve të shumta dhe të ndryshme të të dhënave të jashtme për të mbledhur informacionin e sfondit relevant:

- Lajme në Kohë Reale: Alarme dhe sinjale ngjarjesh të zbuluara nga të dhënat publike merren dhe filtrohen bazuar në kohën dhe vendndodhjen e anomalive detare.

- Kërkim Inteligjent në Ueb: LLM-të gjenerojnë pyetje kërkimi precize, duke mundësuar marrjen e rezultateve të azhurnuara të kërkimit në ueb që ofrojnë kontekst në kohë reale për anomalinë.

- Të Dhëna Moti: Një API e jashtme përdoret për të marrë të dhëna kritike të motit, duke përfshirë temperaturën, shpejtësinë e erës dhe reshjet, për vendndodhjen dhe kohën specifike të anomalive.

Çdo burim të dhënash kërkohet duke përdorur një funksion të veçantë AWS Lambda. Kjo qasje modulare siguron efikasitet dhe shkallëzueshmëri, duke lejuar integrimin e lehtë të burimeve të reja të të dhënave sipas nevojës.

Vetë-Reflektimi Dinamik dhe Kurimi i të Dhënave

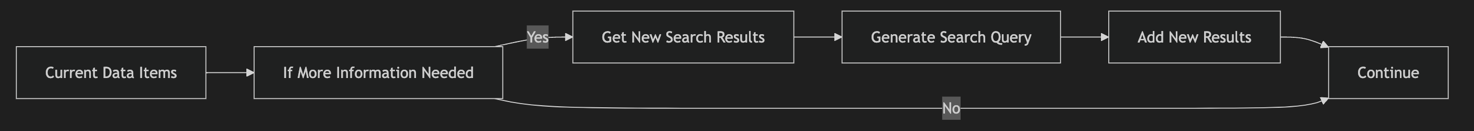

Një inovacion thelbësor në këtë zgjidhje agjentike është aftësia e saj e vetë-reflektimit, e cila përcakton në mënyrë dinamike nevojën për marrjen e të dhënave shtesë. Pas mbledhjes fillestare të të dhënave nga lajmet, kërkimi në ueb dhe moti, procesi kalon në një hap të dytë. Këtu, një LLM i veçantë – i fuqizuar nga Claude i Anthropic nëpërmjet Amazon Bedrock – shqyrton artikujt e të dhënave të gjetura.

Kjo LLM është udhëzuar të vendosë nëse të dhënat e mbledhura deri më tani janë të mjaftueshme për të shpjeguar anomalinë ose nëse ende mungojnë aspekte të caktuara lidhur me ngjarjen. Më pas mund të gjenerojë një pyetje të re, më të rafinuar kërkimi për rezultate shtesë në ueb ose të sinjalizojë procesin të vazhdojë. Kjo qark feedback-u inteligjent, i paraqitur në Figurën 2, i lejon sistemit të kërkojë në mënyrë proaktive kontekst më gjithëpërfshirës, duke e shtuar atë në informacionin e mbledhur më parë.

Figura 1. Arkitektura e zgjidhjes që demonstron shërbimet e AWS dhe AI gjeneruese.

Figura 1. Arkitektura e zgjidhjes që demonstron shërbimet e AWS dhe AI gjeneruese.

Figura 2. Logjika e vetë-reflektimit në sistemin agjentik të analizës së anomalive.

Figura 2. Logjika e vetë-reflektimit në sistemin agjentik të analizës së anomalive.

Pas kësaj faze dinamike të marrjes së të dhënave dhe vetë-reflektimit, sistemi përdor një proces filtrimi dhe renditjeje me dy faza për të hequr artikujt e parëndësishëm të lajmeve dhe për të siguruar kontekstin e cilësisë më të lartë:

- Rirënditja me Amazon Rerank: Një model AI, Amazon Rerank, rendit grupin fillestar të artikujve të të dhënave sipas rëndësisë së tyre për anomalinë. Ky hap është thelbësor për të ruajtur një rikthim të lartë, duke reduktuar në mënyrë efikase grupin e kandidatëve për fazën tjetër.

- Vlerësimi i Saktësisë bazuar në LLM: Çdo artikull nga ata më të renditur vlerësohet më tej nga një LLM në dimensione të shumta, duke përfshirë kohën, vendndodhjen dhe llojin e anijes që përputhet. Sistemi cakton rezultate rëndësie midis 0 dhe 100, duke ruajtur vetëm ato artikuj të të dhënave që tejkalojnë një prag të paracaktuar. Kjo siguron saktësi të lartë, duke garantuar që vetëm informacioni më i rëndësishëm të kontribuojë në analizën përfundimtare.

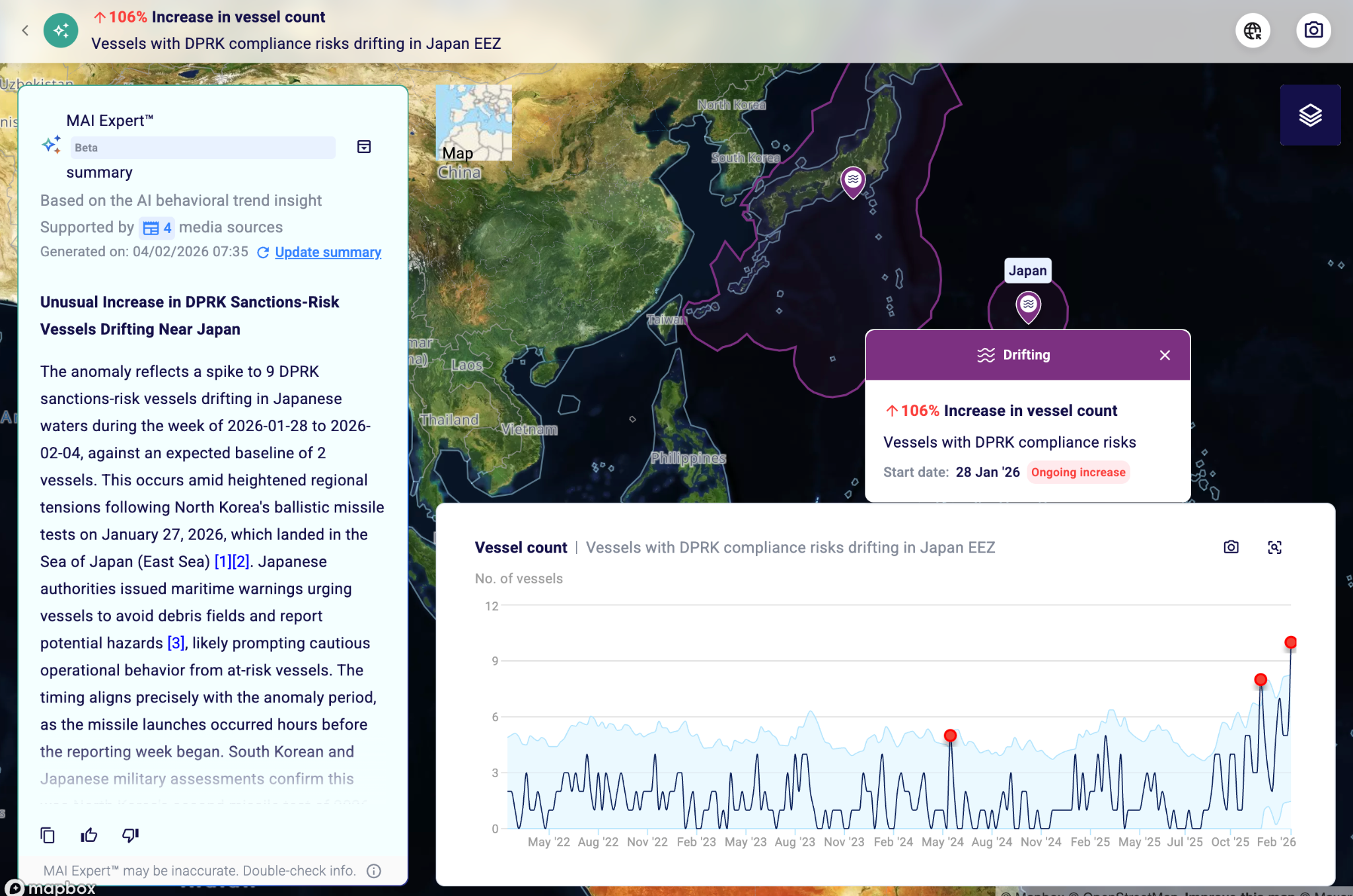

Njohuri të Zbatueshme: Raporti i Kontekstualizuar

Së fundmi, të dhënat e filtruara dhe të renditura me kujdes i kalohen një LLM-je tjetër. Kjo LLM sintetizon të gjithë inteligjencën e mbledhur për të gjeneruar një raport konciz dhe të kontekstualizuar mbi anomalinë. Raporti përmbledh shkaqet e mundshme, rreziqet dhe implikimet e ngjarjes detare të zbuluar. Në mënyrë thelbësore, ai është shkruar për klientët e Windward dhe citon drejtpërdrejt të gjitha burimet e të dhënave të përdorura, duke ofruar transparencë të plotë dhe duke u lejuar përdoruesve të verifikojnë informacionin dhe të thellohen më tej duke ndjekur lidhjet e dhëna.

Figura 3. Shembull i një raporti anomalie të gjeneruar nga MAI Expert™ i Windward.

Figura 3. Shembull i një raporti anomalie të gjeneruar nga MAI Expert™ i Windward.

Ky rezultat redukton ndjeshëm ngarkesën kognitive mbi analistët, duke u paraqitur atyre një narrativë të gatshme që shpjegon anomalinë brenda kontekstit të saj më të gjerë operacional dhe gjeopolitik.

Vlerësimi dhe Ndikimi

Sistemi i plotë vlerësohet rreptësisht kundrejt një grupi gjithëpërfshirës të anomalive historike detare. Ky vlerësim shpesh përfshin një qasje LLM-si-gjykatës, duke vlerësuar cilësinë, saktësinë dhe plotësinë e raporteve kontekstuale të gjeneruara.

Implikimet e kësaj zgjidhjeje agjentike të AI-së gjeneruese janë të thella. Duke automatizuar procesin e mundimshëm të mbledhjes dhe korrelacionit të të dhënave, Windward fuqizon analistët detarë të:

- Rrisin Efikasitetin: Të reduktojnë ndjeshëm kohën e shpenzuar për hetim, duke çliruar burime të vlefshme njerëzore.

- Përmirësojnë Ndërgjegjësimin Situacional: Të fitojnë një kuptim më të thellë dhe më kontekstual të anomalive, duke kaluar përtej alarmeve të izoluara në inteligjencë gjithëpërfshirëse.

- Përshpejtojnë Vendimmarrjen: Të mundësojnë vendime më të shpejta dhe më të informuara, kritike për parashikimin e kërcënimeve dhe mbrojtjen e aseteve në mjedise detare dinamike.

- Optimizojnë Ekspertizën: Të lejojnë ekspertët e fushës të fokusohen në interpretimin strategjik dhe analizën e nivelit të lartë, duke shfrytëzuar aftësitë e tyre unike aty ku kanë më shumë rëndësi.

Bashkëpunimi midis Windward dhe AWS ilustron se si AI-ja gjeneruese e avancuar dhe infrastruktura cloud mund të shfrytëzohen për të zgjidhur probleme komplekse të botës reale, duke transformuar sektorë kritikë si inteligjenca detare dhe duke vendosur një standard të ri për analizën kontekstuale të anomalive.

Pyetjet e bëra shpesh

What is Windward's MAI Expert™ and how does it utilize generative AI?

How does the agentic maritime anomaly analysis solution work?

What AWS services are central to Windward's generative AI solution?

What are the primary challenges Windward aimed to solve with this generative AI approach?

How does the system ensure the relevance of retrieved information for a specific anomaly?

Qëndroni të përditësuar

Merrni lajmet më të fundit të AI në email.