Revolusionering van Maritieme Afwykingsanalise met Agentiese KI

Die uitgestrekte, ingewikkelde wêreld van wêreldwye maritieme aktiwiteite bied unieke uitdagings vir sekuriteit, intelligensie en kommersiële bedrywighede. Die identifisering en begrip van ongewone vaartuiggedrag – van onverwagte bewegings tot afwykings van bekende patrone – vereis dikwels geweldige tyd, diep domeinkundigheid en die korrelasie van disparate databronne. Windward, 'n leier in Maritime AI™, het lankal kritieke intelligensie vir mariene bedrywighede verskaf. Nou, in samewerking met AWS, benut Windward agentiese generatiewe KI om hierdie proses te transformeer, en beweeg van geïsoleerde waarskuwings na omvattende, kontekstuele intelligensie.

Hierdie baanbrekende vennootskap poog om maritieme ontleders te bemagtig, wat ondersoektye drasties verminder en hulle in staat stel om te fokus op hoë-waarde besluitneming eerder as op moeisame dataversameling. Deur geospatiale intelligensie met gevorderde generatiewe KI saam te smelt, bied Windward se nuwe oplossing 'n 360°-aansig, wat bedreigings voorsien en kritieke bates op see beskerm met ongekende spoed en presisie.

Die Uitdaging: Van Data-oorlading tot Aksionable Insigte

Histories was maritieme afwykingsondersoek 'n hoogs handmatige en tydrowende poging. Ontleders sou ure spandeer om deur gefragmenteerde inligting te sif, en te probeer om die kolletjies tussen verskeie datastrome te verbind om 'n vaartuig se anomale gedrag te verstaan. Hierdie proses het nie net aansienlike moeite geverg nie, maar ook diepgaande domeinkundigheid om die nuanses van maritieme aktiwiteite, weerpatrone en geopolitieke gebeure te interpreteer.

Windward se bestaande Vroeë Opsporingsisteem identifiseer suksesvol verdagte patrone, maar die doel was om die pad van opsporing na besluitneming te versnel. Om die analitiese werkvloei te optimaliseer en werklik "sendinggereed" insigte te verskaf, het Windward drie sleutel strategiese verbeterings geïdentifiseer wat nodig was:

- Verenigde Werksvloei: Minimaliseer die behoefte vir ontleders om eksterne databronne te raadpleeg, en skep 'n naatlose en gefokusde analitiese omgewing.

- Kundigheidsoptimering: Outomatiseer die versameling en aanvanklike korrelasie van kontekstuele data (weer, nuus, verwante waarskuwings), sodat domeinkundiges hul waardevolle tyd aan strategiese interpretasie en besluitneming kan wy.

- Omvattende Dekking: Stroomlyn die sintese van inligting om vinniger en meer in-diepte ondersoek van veelvuldige waarskuwings gelyktydig moontlik te maak.

Om hierdie ambisieuse doelwitte aan te spreek, het Windward met die AWS Generative AI Innovation Center saamgewerk om MAI Expert™ te ontwikkel, die eerste generatiewe KI maritieme agent wat komplekse maritieme afwykings outomaties kan kontekstualiseer.

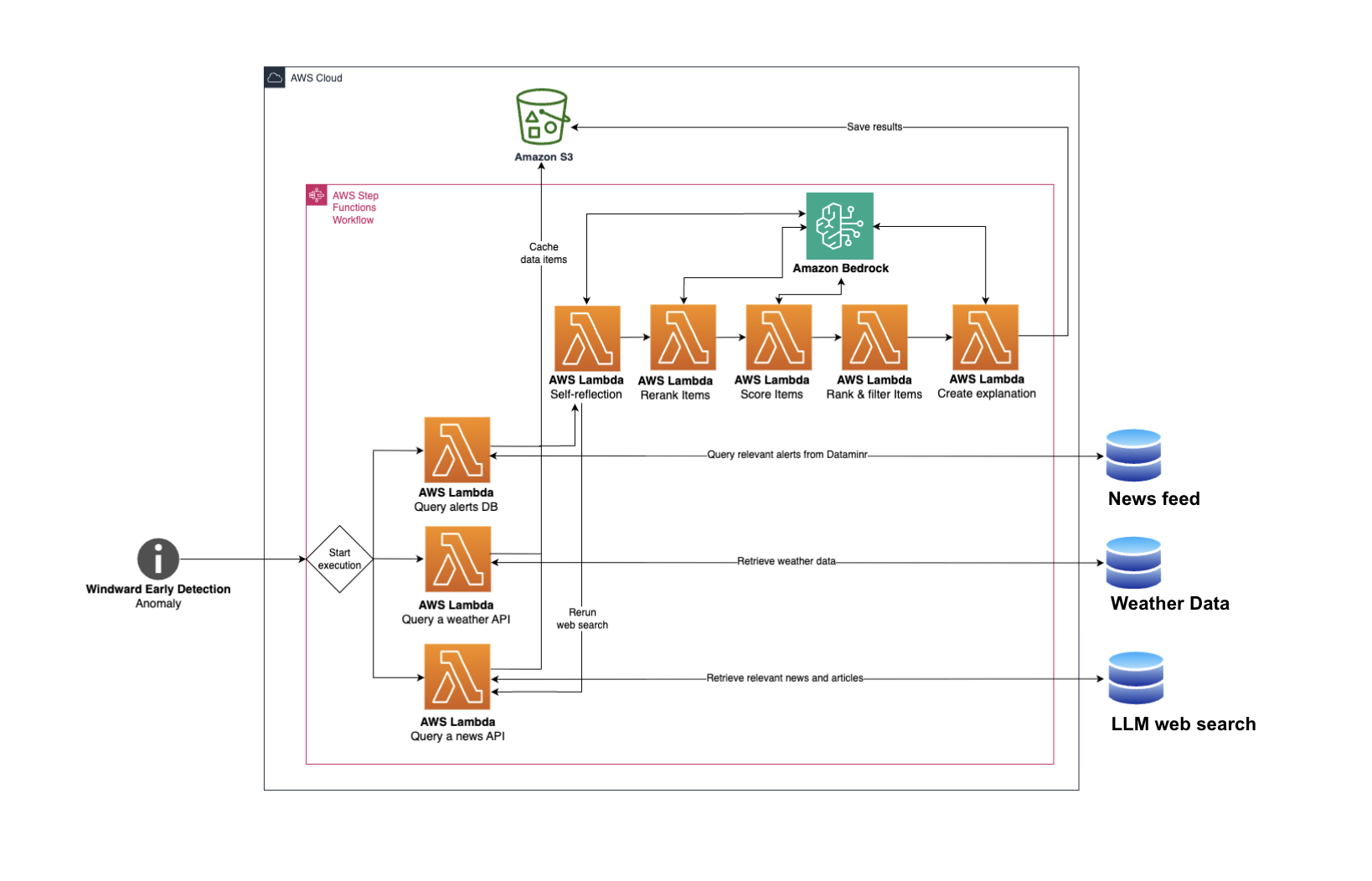

Agentiese Argitektuur: Aandryf van Kontekstuele Intelligensie met AWS

Die hart van Windward se verbeterde oplossing lê in sy multi-stap, KI-gedrewe argitektuur, ontplooi op AWS. Hierdie sisteem haal outomaties relevante data uit verskeie interne en eksterne bronne en gebruik hierdie inligting om 'n tekstuele beskrywing te genereer wat maritieme afwykingsgebeure deeglik kontekstualiseer.

Die proses begin wanneer 'n afwyking deur die Windward Vroeë Opsporingsisteem geïdentifiseer word. Relevante metadata – soos afwykingstydstempel, streekkoördinate, afwykingstipe en vaartuigklas – word uit Windward se interne databasis onttrek.

Hierdie metadata word dan ingevoer in 'n agentiese analisesisteem aangedryf deur groot taalmodelle (LLM's) op Amazon Bedrock. Die hele multi-stap afwykingsanalise-pyplyn word georkestreer deur gebruik te maak van AWS Step Functions, wat 'n robuuste en skaalbare werkvloei verseker.

Die eerste stap in hierdie georkestreerde proses behels die bevraagtekening van veelvuldige, diverse eksterne databronne om relevante agtergrondinligting te versamel:

- Intydse Nuusvoer: Waarskuwings en gebeurtenissignale wat uit openbare data ontdek is, word gehaal en gefiltreer op grond van die maritieme afwyking se tyd en ligging.

- Intelligente Websoektog: LLM's genereer presiese soeknavrae, wat die herwinning van bygewerkte websoekresultate moontlik maak wat intydse konteks vir die afwyking verskaf.

- Weerdata: 'n Eksterne API word gebruik om kritieke weerdata, insluitend temperatuur, windspoed en neerslag, vir die spesifieke ligging en tyd van die afwyking te herwin.

Elke databron word bevraagteken deur 'n aparte AWS Lambda-funksie te gebruik. Hierdie modulêre benadering verseker doeltreffendheid en skaalbaarheid, wat maklike integrasie van nuwe databronne soos benodig moontlik maak.

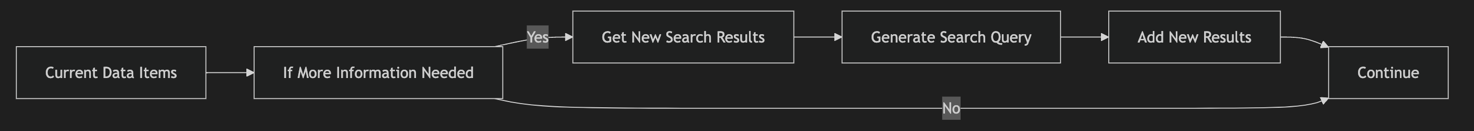

Dinamiese Selfrefleksie en Data-kuratiewe

'n Kerninnovasie in hierdie agentiese oplossing is die selfrefleksievermoë, wat dinamies die behoefte aan addisionele dataherwinning bepaal. Na die aanvanklike dataversameling van nuus, websoektog en weer, beweeg die pyplyn na 'n tweede stap. Hier ondersoek 'n aparte LLM – aangedryf deur Anthropic se Claude deur Amazon Bedrock – die herwinde data-items.

Hierdie LLM word opdrag gegee om te besluit of die data wat tot dusver versamel is voldoende is om die afwyking te verklaar of as sekere aspekte wat met die gebeurtenis verband hou nog ontbreek. Dit kan dan óf 'n nuwe, meer verfynde soeknavraag vir addisionele webresultate genereer óf die pyplyn aandui om voort te gaan. Hierdie intelligente terugvoerlus, soos in Figuur 2 uitgebeeld, stel die sisteem in staat om proaktief meer omvattende konteks te soek, en dit by voorheen versamelde inligting aan te heg.

Figuur 1. Oplossingsargitektuur wat AWS-dienste en generatiewe KI demonstreer.

Figuur 1. Oplossingsargitektuur wat AWS-dienste en generatiewe KI demonstreer.

Figuur 2. Selfrefleksie-logika in die agentiese afwykingsanalise-sisteem.

Figuur 2. Selfrefleksie-logika in die agentiese afwykingsanalise-sisteem.

Na hierdie dinamiese dataherwinning en selfrefleksie-fase, gebruik die sisteem 'n twee-stadium filter- en rangskikkingsproses om irrelevante nuusitems te verwyder en die hoogste gehalte konteks te verseker:

- Her-rangskikking met Amazon Rerank: 'n KI-model, Amazon Rerank, sorteer die aanvanklike stel data-items volgens hul relevansie vir die afwyking. Hierdie stap is van kardinale belang vir die handhawing van hoë herroeping, wat die poel van kandidate vir die volgende stadium doeltreffend verminder.

- LLM-gebaseerde Presisietelling: Elk van die top-gerangskikte items word dan verder deur 'n LLM oor veelvuldige dimensies, insluitend tyd, ligging en bypassende vaartuigtip, getel. Die sisteem ken relevansietellings tussen 0 en 100 toe, en behou slegs daardie data-items wat 'n voorafbepaalde drempel oorskry. Dit verseker hoë presisie, en waarborg dat slegs die mees pertinente inligting bydra tot die finale analise.

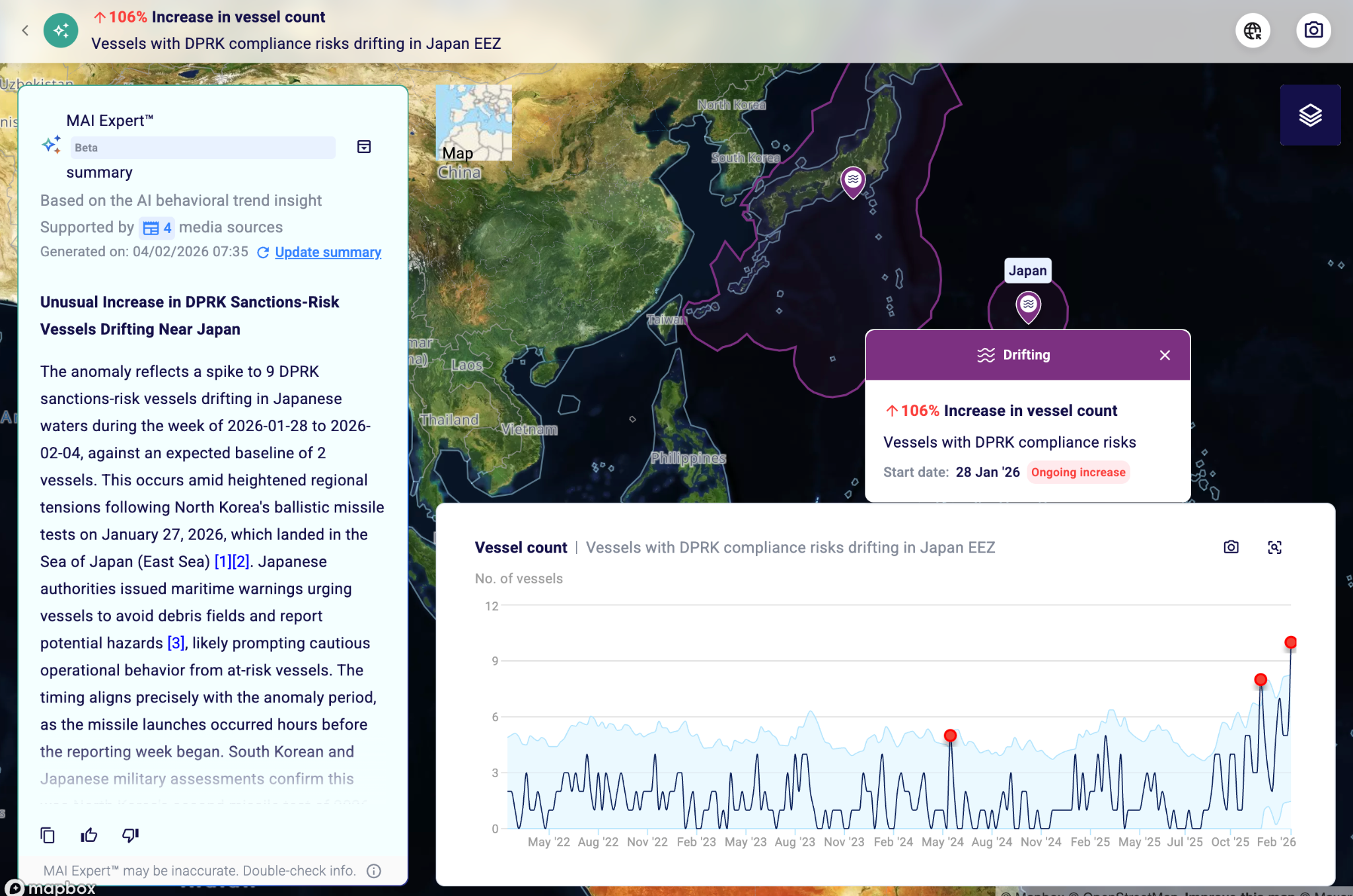

Aksionable Insigte: Die Gekontekstualiseerde Verslag

Uiteindelik word die noukeurig gefiltreerde en gerangskikte data aan 'n ander LLM deurgegee. Hierdie LLM sintetiseer al die versamelde intelligensie om 'n bondige, gekontekstualiseerde verslag oor die afwyking te genereer. Die verslag som potensiële oorsake, risiko's en implikasies van die opgespoorde maritieme gebeurtenis op. Krities, dit is geskryf vir Windward se kliënte en haal direk alle gebruikte databronne aan, wat volle deursigtigheid bied en gebruikers in staat stel om inligting te verifieer en dieper in te gaan deur die verskafde skakels te volg.

Figuur 3. Voorbeeld van 'n gegenereerde afwykingsverslag van Windward se MAI Expert™.

Figuur 3. Voorbeeld van 'n gegenereerde afwykingsverslag van Windward se MAI Expert™.

Hierdie uitset verminder die kognitiewe las op ontleders drasties, en bied hulle 'n gereedgemaakte narratief wat die afwyking binne sy breër operasionele en geopolitieke konteks verduidelik.

Evaluering en Impak

Die einde-tot-einde sisteem word noukeurig geëvalueer teen 'n omvattende stel historiese maritieme afwykings. Hierdie evaluering behels dikwels 'n LLM-as-'n-regter-benadering, wat die kwaliteit, akkuraatheid en volledigheid van die gegenereerde kontekstuele verslae assesseer.

Die implikasies van hierdie agentiese generatiewe KI-oplossing is diepgaande. Deur die moeisame proses van dataversameling en korrelasie te outomatiseer, bemagtig Windward maritieme ontleders om:

- Verbeter Doeltreffendheid: Verminder die tyd wat aan ondersoek spandeer word aansienlik, wat waardevolle menslike hulpbronne vrystel.

- Verbeter Situasionele Bewustheid: Verkry 'n dieper, meer kontekstuele begrip van afwykings, en beweeg verder as geïsoleerde waarskuwings na omvattende intelligensie.

- Versnel Besluitneming: Maak vinniger en meer ingeligte besluite moontlik, krities vir die voorspelling van bedreigings en die beskerming van bates in dinamiese maritieme omgewings.

- Optimaliseer Kundigheid: Laat domeinkundiges toe om te fokus op strategiese interpretasie en hoëvlak-analise, en benut hul unieke vaardighede waar dit die meeste saak maak.

Die samewerking tussen Windward en AWS is 'n voorbeeld van hoe nuutste generatiewe KI en wolk-infrastruktuur ingespan kan word om komplekse werklike probleme op te los, wat kritieke sektore soos maritieme intelligensie transformeer en 'n nuwe standaard vir kontekstuele afwykingsanalise stel.

Oorspronklike bron

https://aws.amazon.com/blogs/machine-learning/from-isolated-alerts-to-contextual-intelligence-agentic-maritime-anomaly-analysis-with-generative-ai/Gereelde Vrae

What is Windward's MAI Expert™ and how does it utilize generative AI?

How does the agentic maritime anomaly analysis solution work?

What AWS services are central to Windward's generative AI solution?

What are the primary challenges Windward aimed to solve with this generative AI approach?

How does the system ensure the relevance of retrieved information for a specific anomaly?

Bly op hoogte

Kry die nuutste KI-nuus in jou inkassie.