Revolucioniranje analize pomorskih anomalija s agentnom umjetnom inteligencijom

Prostrani, složeni svijet globalnih pomorskih aktivnosti predstavlja jedinstvene izazove za sigurnost, obavještajne službe i komercijalne operacije. Identificiranje i razumijevanje neobičnog ponašanja plovila – od neočekivanih kretanja do odstupanja od poznatih obrazaca – često zahtijeva golemo vrijeme, duboko stručno znanje i korelaciju različitih izvora podataka. Windward, lider u pomorskoj umjetnoj inteligenciji (Maritime AI™), dugo je pružao ključne obavještajne podatke za pomorske operacije. Sada, u suradnji s AWS-om, Windward koristi agentnu generativnu umjetnu inteligenciju za transformaciju tog procesa, prelazeći s izoliranih upozorenja na sveobuhvatnu, kontekstualnu inteligenciju.

Ovo revolucionarno partnerstvo ima za cilj osnažiti pomorske analitičare, drastično smanjujući vrijeme istrage i omogućujući im da se usredotoče na donošenje odluka visoke vrijednosti, umjesto na mukotrpno prikupljanje podataka. Spajanjem geospacijalne inteligencije s naprednom generativnom umjetnom inteligencijom, Windwardovo novo rješenje pruža pogled od 360°, predviđajući prijetnje i štiteći kritičnu imovinu na moru s neviđenom brzinom i preciznošću.

Izazov: Od preopterećenja podacima do upotrebljivih uvida

Povijesno gledano, istraga pomorskih anomalija bila je vrlo ručni i vremenski intenzivan pothvat. Analitičari bi provodili sate pretražujući fragmentirane informacije, pokušavajući povezati točke između različitih tokova podataka kako bi razumjeli anomalno ponašanje plovila. Ovaj proces zahtijevao je ne samo značajan napor, već i duboko stručno znanje za tumačenje nijansi pomorskih aktivnosti, vremenskih obrazaca i geopolitičkih događaja.

Windwardov postojeći sustav ranog otkrivanja uspješno identificira sumnjive obrasce, ali cilj je bio ubrzati put od otkrivanja do donošenja odluka. Kako bi optimizirao analitički tijek rada i pružio istinski 'spremne za misiju' uvide, Windward je identificirao tri ključna strateška poboljšanja koja su potrebna:

- Jedinstven tijek rada: Minimizirati potrebu analitičara za konzultacijama s vanjskim izvorima podataka, stvarajući besprijekorno i fokusirano analitičko okruženje.

- Optimizacija stručnosti: Automatizirati prikupljanje i početnu korelaciju kontekstualnih podataka (vrijeme, vijesti, povezana upozorenja), omogućujući stručnjacima za domenu da svoje dragocjeno vrijeme posvete strateškom tumačenju i donošenju odluka.

- Sveobuhvatna pokrivenost: Pojednostaviti sintezu informacija kako bi se omogućila brža i dubinska istraga više upozorenja istovremeno.

Kako bi ostvario te ambiciozne ciljeve, Windward se udružio s AWS Generative AI Innovation Centrom kako bi razvio MAI Expert™, prvog generativnog AI pomorskog agenta sposobnog za automatsko kontekstualiziranje složenih pomorskih anomalija.

Agentna arhitektura: Osnaživanje kontekstualne inteligencije s AWS-om

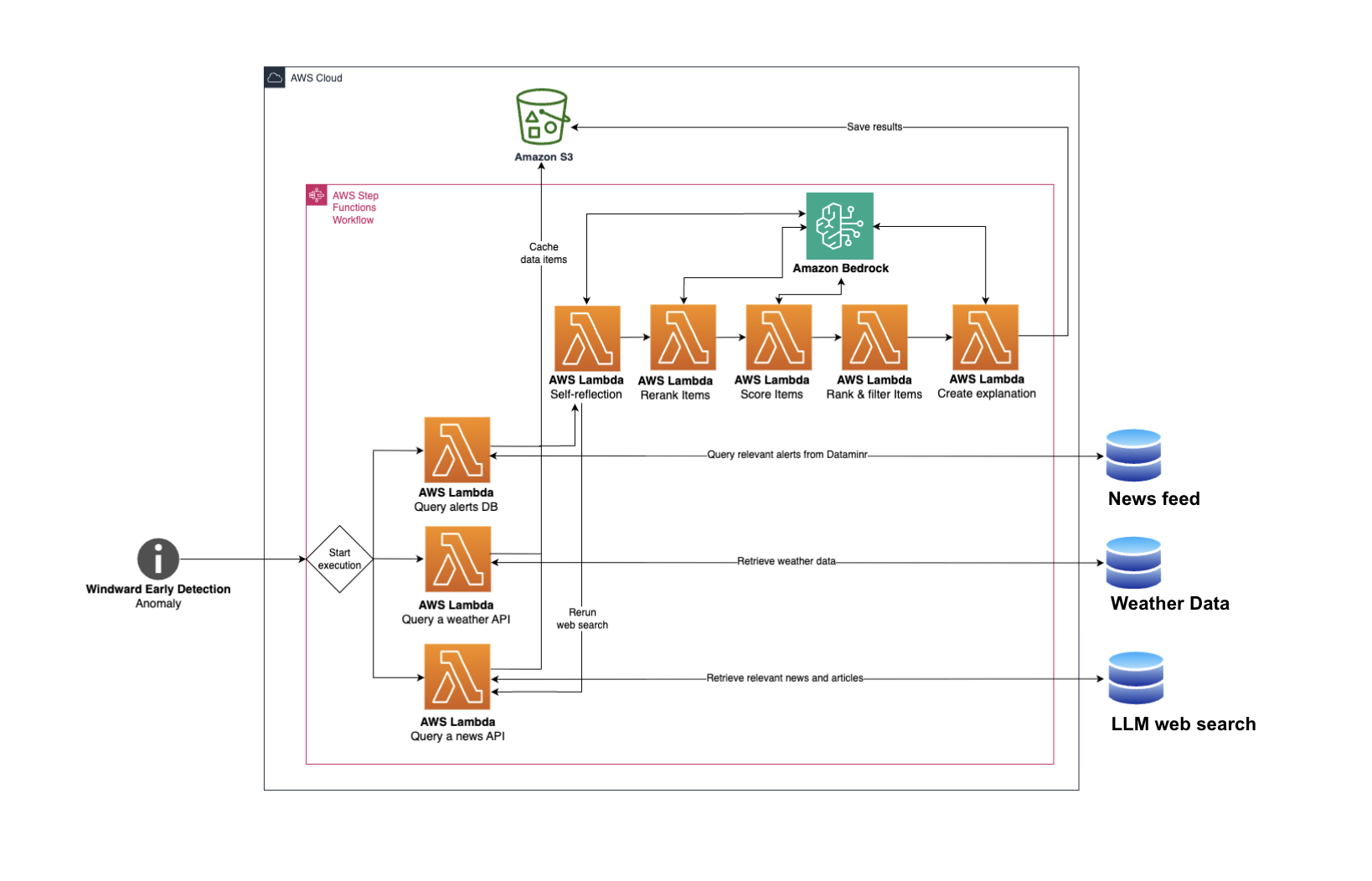

Srž Windwardovog poboljšanog rješenja leži u njegovoj višestupanjskoj, AI pogonjenoj arhitekturi, implementiranoj na AWS-u. Ovaj sustav automatski dohvaća relevantne podatke iz različitih internih i vanjskih izvora i koristi te informacije za generiranje tekstualnog opisa koji temeljito kontekstualizira događaje pomorskih anomalija.

Proces započinje kada Windwardov sustav ranog otkrivanja identificira anomaliju. Relevantni metapodaci – poput vremenske oznake anomalije, koordinata regije, tipa anomalije i klase plovila – izvlače se iz Windwardove interne baze podataka.

Ti se metapodaci zatim unose u agentni analitički sustav pogonjen velikim jezičnim modelima (LLM) na Amazon Bedrocku. Cijeli višestupanjski sustav analize anomalija orkestriran je pomoću AWS Step Functions, osiguravajući robustan i skalabilan tijek rada.

Prvi korak u ovom orkestriranom procesu uključuje pretraživanje više, raznolikih vanjskih izvora podataka za prikupljanje relevantnih pozadinskih informacija:

- Vijesti u stvarnom vremenu: Upozorenja i signali događaja otkriveni iz javnih podataka dohvaćaju se i filtriraju na temelju vremena i lokacije pomorske anomalije.

- Inteligentno pretraživanje weba: LLM-ovi generiraju precizne upite za pretraživanje, omogućujući dohvaćanje ažurnih rezultata pretraživanja weba koji pružaju kontekst anomalije u stvarnom vremenu.

- Podaci o vremenu: Vanjski API koristi se za dohvaćanje kritičnih vremenskih podataka, uključujući temperaturu, brzinu vjetra i oborine, za specifičnu lokaciju i vrijeme anomalije.

Svaki izvor podataka pretražuje se pomoću zasebne AWS Lambda funkcije. Ovaj modularni pristup osigurava učinkovitost i skalabilnost, omogućujući jednostavnu integraciju novih izvora podataka prema potrebi.

Dinamička samorefleksija i kuriranje podataka

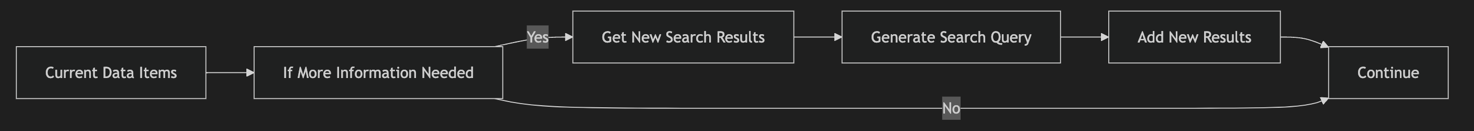

Ključna inovacija u ovom agentnom rješenju je njegova sposobnost samorefleksije, koja dinamički određuje potrebu za dodatnim dohvaćanjem podataka. Nakon početnog prikupljanja podataka iz vijesti, pretraživanja weba i vremena, sustav prelazi na drugi korak. Ovdje, zaseban LLM – pogonjen Anthropicovim Claudeom putem Amazon Bedrocka – ispituje dohvaćene stavke podataka.

Ovaj LLM je upućen da odluči jesu li dosad prikupljeni podaci dovoljni za objašnjenje anomalije ili ako određeni aspekti vezani uz događaj još uvijek nedostaju. Zatim može generirati novi, precizniji upit za pretraživanje za dodatne web rezultate ili signalizirati sustavu da nastavi. Ova inteligentna povratna petlja, prikazana na Slici 2, omogućuje sustavu da proaktivno traži sveobuhvatniji kontekst, dodajući ga prethodno prikupljenim informacijama.

Slika 1. Arhitektura rješenja koja prikazuje AWS usluge i generativnu umjetnu inteligenciju.

Slika 1. Arhitektura rješenja koja prikazuje AWS usluge i generativnu umjetnu inteligenciju.

Slika 2. Logika samorefleksije u agentnom sustavu analize anomalija.

Slika 2. Logika samorefleksije u agentnom sustavu analize anomalija.

Nakon ove faze dinamičkog dohvaćanja podataka i samorefleksije, sustav koristi dvostupanjski proces filtriranja i rangiranja kako bi uklonio nerelevantne vijesti i osigurao kontekst najviše kvalitete:

- Ponovno rangiranje s Amazon Rerankom: AI model, Amazon Rerank, sortira početni skup podataka prema njihovoj relevantnosti za anomaliju. Ovaj korak je ključan za održavanje visokog 'recalla', učinkovito smanjujući bazen kandidata za sljedeću fazu.

- Bodovanje preciznosti temeljeno na LLM-u: Svaka od najbolje rangiranih stavki zatim se dodatno ocjenjuje od strane LLM-a kroz više dimenzija, uključujući vrijeme, lokaciju i podudaranje tipa plovila. Sustav dodjeljuje ocjene relevantnosti između 0 i 100, zadržavajući samo one podatke koji prelaze unaprijed definirani prag. To osigurava visoku preciznost, jamčeći da samo najrelevantnije informacije doprinose konačnoj analizi.

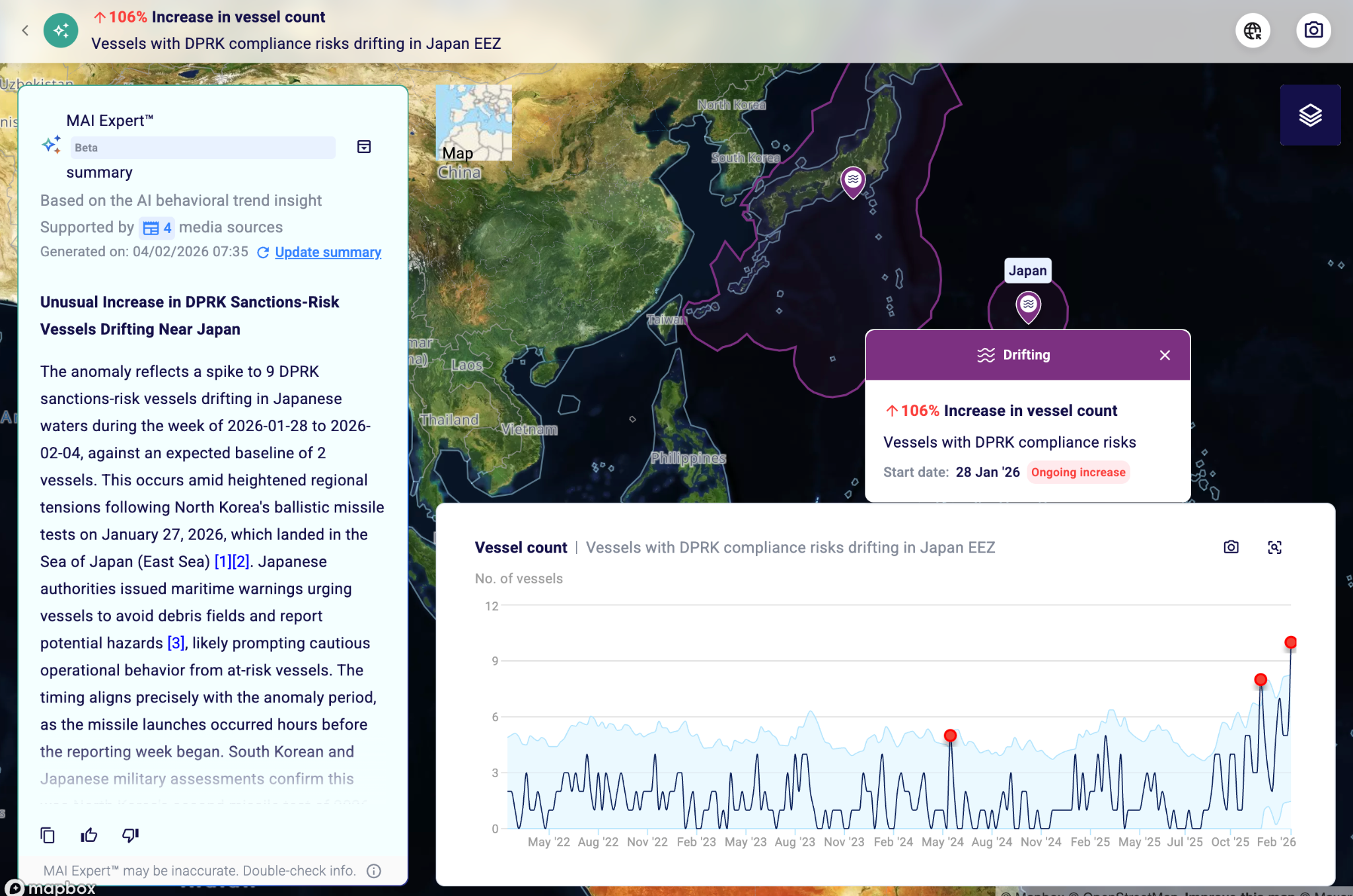

Upotrebljivi uvidi: Kontekstualizirano izvješće

Konačno, pomno filtrirani i rangirani podaci prosljeđuju se drugom LLM-u. Ovaj LLM sintetizira sve prikupljene obavještajne podatke kako bi generirao sažeto, kontekstualizirano izvješće o anomaliji. Izvješće sažima potencijalne uzroke, rizike i implikacije detektiranog pomorskog događaja. Ključno je da je napisano za Windwardove klijente i izravno navodi sve korištene izvore podataka, pružajući potpunu transparentnost i omogućujući korisnicima da provjere informacije i dublje istraže prateći priložene poveznice.

Slika 3. Primjer generiranog izvješća o anomaliji iz Windwardovog MAI Experta™.

Slika 3. Primjer generiranog izvješća o anomaliji iz Windwardovog MAI Experta™.

Ovaj izlaz drastično smanjuje kognitivno opterećenje analitičara, pružajući im gotov narativ koji objašnjava anomaliju unutar šireg operativnog i geopolitičkog konteksta.

Evaluacija i utjecaj

Cjelokupni sustav rigorozno se ocjenjuje u odnosu na sveobuhvatan skup povijesnih pomorskih anomalija. Ova evaluacija često uključuje pristup 'LLM kao sudac', procjenjujući kvalitetu, točnost i potpunost generiranih kontekstualnih izvješća.

Implikacije ovog agentnog rješenja generativne umjetne inteligencije su dalekosežne. Automatizacijom mukotrpnog procesa prikupljanja i korelacije podataka, Windward osnažuje pomorske analitičare da:

- Povećaju učinkovitost: Značajno smanje vrijeme provedeno na istrazi, oslobađajući dragocjene ljudske resurse.

- Poboljšaju svijest o situaciji: Ostvare dublje, kontekstualnije razumijevanje anomalija, prelazeći s izoliranih upozorenja na sveobuhvatnu inteligenciju.

- Ubrzaju donošenje odluka: Omoguće brže i informiranije odluke, ključne za predviđanje prijetnji i zaštitu imovine u dinamičnim pomorskim okruženjima.

- Optimiziraju stručnost: Omoguće stručnjacima za domenu da se usredotoče na strateško tumačenje i analizu visoke razine, koristeći svoje jedinstvene vještine tamo gdje su najvažnije.

Suradnja između Windwarda i AWS-a pokazuje kako se najmodernija generativna umjetna inteligencija i cloud infrastruktura mogu iskoristiti za rješavanje složenih problema iz stvarnog svijeta, transformirajući kritične sektore poput pomorske obavještajne djelatnosti i postavljajući novi standard za kontekstualnu analizu anomalija.

Često postavljana pitanja

What is Windward's MAI Expert™ and how does it utilize generative AI?

How does the agentic maritime anomaly analysis solution work?

What AWS services are central to Windward's generative AI solution?

What are the primary challenges Windward aimed to solve with this generative AI approach?

How does the system ensure the relevance of retrieved information for a specific anomaly?

Budite u toku

Primajte najnovije AI vijesti na e-mail.