Revolucionando a Análise de Anomalias Marítimas com IA Agente

O vasto e complexo mundo da atividade marítima global apresenta desafios únicos para a segurança, inteligência e operações comerciais. Identificar e compreender o comportamento incomum de embarcações – desde movimentos inesperados a desvios de padrões conhecidos – muitas vezes exige tempo imenso, profunda expertise no domínio e a correlação de fontes de dados díspares. A Windward, líder em IA Marítima™, há muito fornece inteligência crítica para operações marítimas. Agora, em colaboração com a AWS, a Windward está aproveitando a IA generativa agente para transformar esse processo, passando de alertas isolados para uma inteligência contextual abrangente.

Essa parceria inovadora visa capacitar os analistas marítimos, reduzindo drasticamente os tempos de investigação e permitindo que eles se concentrem na tomada de decisões de alto valor, em vez da árdua coleta de dados. Ao fundir inteligência geoespacial com IA generativa avançada, a nova solução da Windward oferece uma visão 360°, antecipando ameaças e protegendo ativos críticos no mar com velocidade e precisão sem precedentes.

O Desafio: Do Excesso de Dados aos Insights Acionáveis

Historicamente, a investigação de anomalias marítimas era um empreendimento altamente manual e demorado. Os analistas passavam horas peneirando informações fragmentadas, tentando conectar pontos entre vários fluxos de dados para entender o comportamento anômalo de uma embarcação. Esse processo exigia não apenas um esforço significativo, mas também profunda expertise no domínio para interpretar as nuances das atividades marítimas, padrões climáticos e eventos geopolíticos.

O sistema de Detecção Precoce existente da Windward identifica com sucesso padrões suspeitos, mas o objetivo era acelerar o caminho da detecção para a tomada de decisões. Para otimizar o fluxo de trabalho analítico e fornecer insights verdadeiramente "prontos para a missão", a Windward identificou três melhorias estratégicas importantes necessárias:

- Fluxo de Trabalho Unificado: Minimizar a necessidade de os analistas consultarem fontes de dados externas, criando um ambiente analítico contínuo e focado.

- Otimização da Expertise: Automatizar a coleta e a correlação inicial de dados contextuais (clima, notícias, alertas relacionados), permitindo que os especialistas no domínio dediquem seu valioso tempo à interpretação estratégica e à tomada de decisões.

- Cobertura Abrangente: Otimizar a síntese de informações para permitir uma investigação mais rápida e aprofundada de múltiplos alertas simultaneamente.

Para abordar esses objetivos ambiciosos, a Windward fez parceria com o AWS Generative AI Innovation Center para desenvolver o MAI Expert™, o primeiro agente marítimo de IA generativa capaz de contextualizar automaticamente anomalias marítimas complexas.

Arquitetura Agente: Potencializando a Inteligência Contextual com AWS

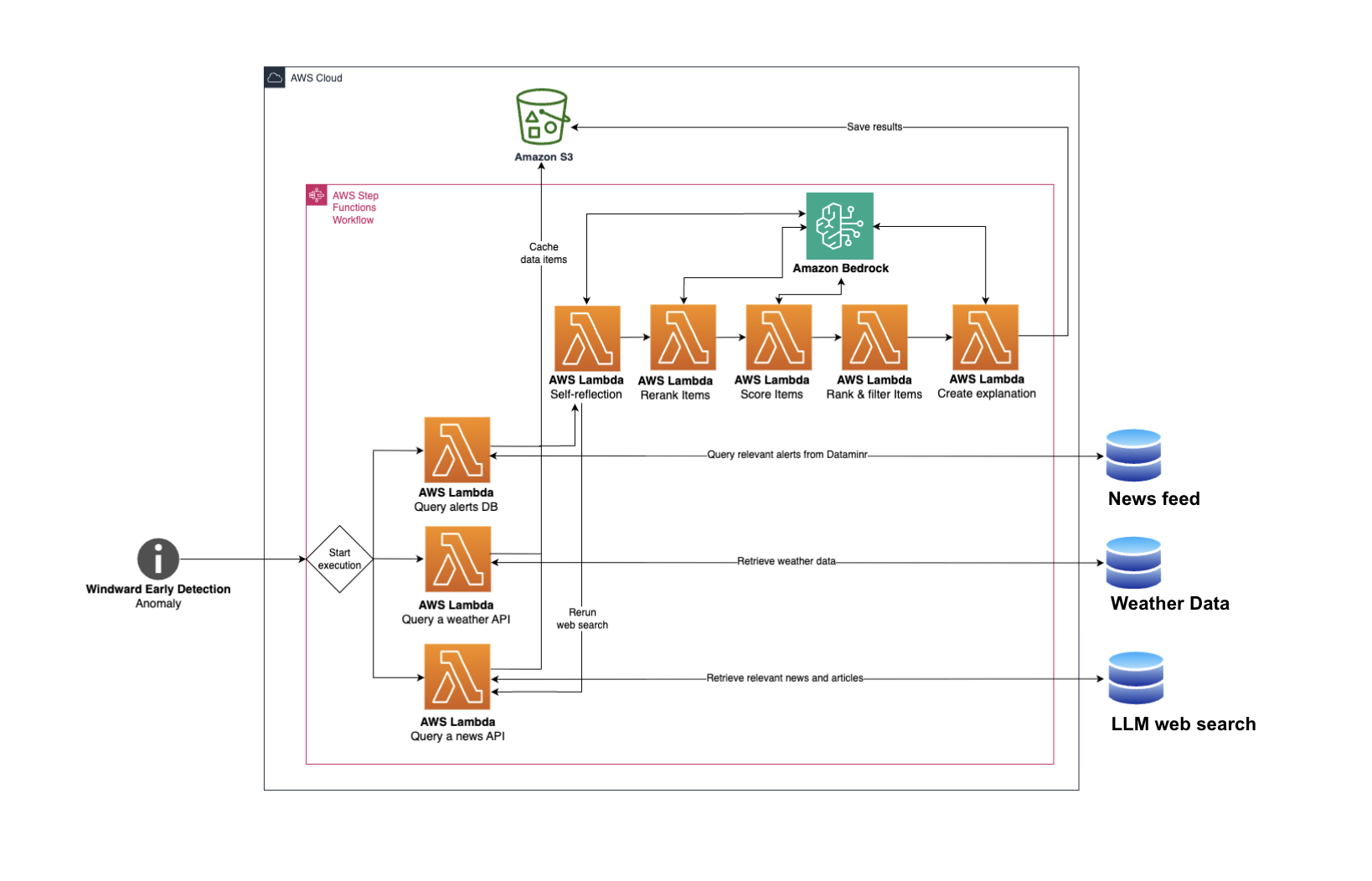

O cerne da solução aprimorada da Windward reside em sua arquitetura multifásica e impulsionada por IA, implantada na AWS. Esse sistema busca automaticamente dados relevantes de várias fontes internas e externas e usa essas informações para gerar uma descrição textual que contextualiza minuciosamente os eventos de anomalias marítimas.

O processo começa quando uma anomalia é identificada pelo sistema de Detecção Precoce da Windward. Metadados relevantes – como carimbo de data/hora da anomalia, coordenadas da região, tipo de anomalia e classe da embarcação – são extraídos do banco de dados interno da Windward.

Esses metadados são então inseridos em um sistema de análise agente impulsionado por grandes modelos de linguagem (LLMs) no Amazon Bedrock. Todo o pipeline de análise de anomalias multifásico é orquestrado usando AWS Step Functions, garantindo um fluxo de trabalho robusto e escalável.

O primeiro passo nesse processo orquestrado envolve a consulta de múltiplas e diversas fontes de dados externas para coletar informações de fundo relevantes:

- Feed de Notícias em Tempo Real: Alertas e sinais de eventos descobertos a partir de dados públicos são buscados e filtrados com base no tempo e na localização da anomalia marítima.

- Pesquisa Web Inteligente: LLMs geram consultas de pesquisa precisas, permitindo a recuperação de resultados de pesquisa web atualizados que fornecem contexto em tempo real para a anomalia.

- Dados Meteorológicos: Uma API externa é utilizada para recuperar dados meteorológicos críticos, incluindo temperatura, velocidade do vento e precipitação, para a localização e o tempo específicos da anomalia.

Cada fonte de dados é consultada usando uma função AWS Lambda separada. Essa abordagem modular garante eficiência e escalabilidade, permitindo a fácil integração de novas fontes de dados conforme necessário.

Autorreflexão Dinâmica e Curadoria de Dados

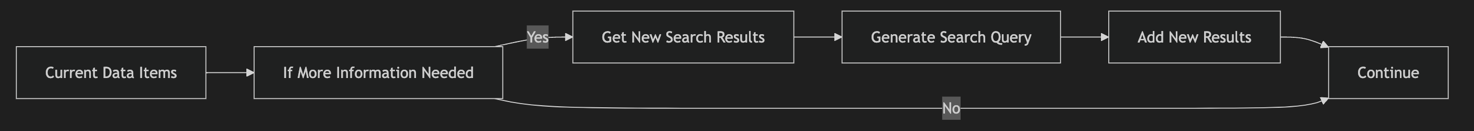

Uma inovação central nesta solução agente é sua capacidade de autorreflexão, que determina dinamicamente a necessidade de recuperação de dados adicionais. Após a coleta inicial de dados de notícias, pesquisa web e clima, o pipeline passa para uma segunda etapa. Aqui, um LLM separado — impulsionado pelo Claude da Anthropic através do Amazon Bedrock — examina os itens de dados recuperados.

Este LLM é instruído a decidir se os dados coletados até agora são suficientes para explicar a anomalia ou se certos aspectos relacionados ao evento ainda estão faltando. Ele pode então gerar uma nova consulta de pesquisa mais refinada para resultados web adicionais ou sinalizar o pipeline para prosseguir. Esse loop de feedback inteligente, representado na Figura 2, permite que o sistema busque proativamente um contexto mais abrangente, anexando-o às informações previamente coletadas.

Figura 1. Arquitetura da solução demonstrando os serviços AWS e a IA generativa.

Figura 1. Arquitetura da solução demonstrando os serviços AWS e a IA generativa.

Figura 2. Lógica de autorreflexão no sistema de análise de anomalias agente.

Figura 2. Lógica de autorreflexão no sistema de análise de anomalias agente.

Após essa fase dinâmica de recuperação de dados e autorreflexão, o sistema emprega um processo de filtragem e classificação em duas etapas para remover itens de notícias irrelevantes e garantir a mais alta qualidade de contexto:

- Reclassificação com Amazon Rerank: Um modelo de IA, o Amazon Rerank, classifica o conjunto inicial de itens de dados de acordo com sua relevância para a anomalia. Esta etapa é crucial para manter alta recall, reduzindo eficientemente o pool de candidatos para a próxima fase.

- Pontuação de Precisão baseada em LLM: Cada um dos itens mais bem classificados é então pontuado por um LLM em múltiplas dimensões, incluindo tempo, localização e tipo de embarcação correspondente. O sistema atribui pontuações de relevância entre 0 e 100, retendo apenas os itens de dados que excedem um limite predefinido. Isso garante alta precisão, garantindo que apenas as informações mais pertinentes contribuam para a análise final.

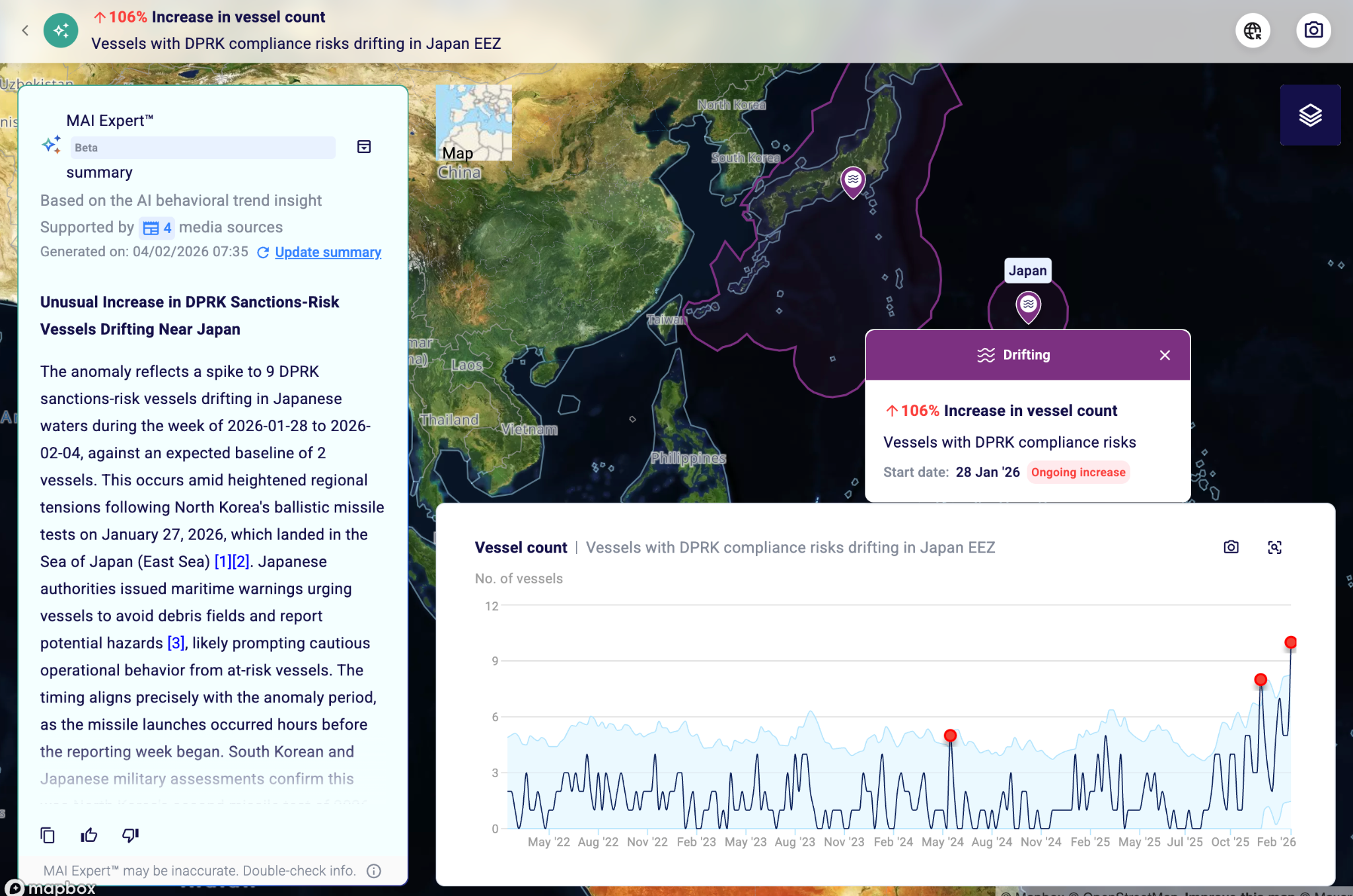

Insights Acionáveis: O Relatório Contextualizado

Finalmente, os dados meticulosamente filtrados e classificados são passados para outro LLM. Este LLM sintetiza toda a inteligência coletada para gerar um relatório conciso e contextualizado sobre a anomalia. O relatório resume as causas potenciais, riscos e implicações do evento marítimo detectado. Crucialmente, ele é escrito para os clientes da Windward e cita diretamente todas as fontes de dados utilizadas, fornecendo total transparência e permitindo que os usuários verifiquem informações e se aprofundem seguindo os links fornecidos.

Figura 3. Exemplo de relatório de anomalia gerado pelo MAI Expert™ da Windward.

Figura 3. Exemplo de relatório de anomalia gerado pelo MAI Expert™ da Windward.

Essa saída reduz drasticamente a carga cognitiva dos analistas, apresentando-lhes uma narrativa pronta que explica a anomalia dentro de seu contexto operacional e geopolítico mais amplo.

Avaliação e Impacto

O sistema de ponta a ponta é rigorosamente avaliado contra um conjunto abrangente de anomalias marítimas históricas. Essa avaliação geralmente envolve uma abordagem de LLM-como-juiz, avaliando a qualidade, precisão e completude dos relatórios contextuais gerados.

As implicações dessa solução de IA generativa agente são profundas. Ao automatizar o trabalhoso processo de coleta e correlação de dados, a Windward capacita os analistas marítimos a:

- Aumentar a Eficiência: Reduzir significativamente o tempo gasto na investigação, liberando valiosos recursos humanos.

- Melhorar a Consciência Situacional: Obter uma compreensão mais profunda e contextual de anomalias, indo além de alertas isolados para uma inteligência abrangente.

- Acelerar a Tomada de Decisão: Permitir decisões mais rápidas e informadas, críticas para antecipar ameaças e proteger ativos em ambientes marítimos dinâmicos.

- Otimizar a Expertise: Permitir que especialistas no domínio se concentrem na interpretação estratégica e na análise de alto nível, aproveitando suas habilidades únicas onde elas mais importam.

A colaboração entre a Windward e a AWS exemplifica como a IA generativa de ponta e a infraestrutura de nuvem podem ser aproveitadas para resolver problemas complexos do mundo real, transformando setores críticos como a inteligência marítima e estabelecendo um novo padrão para a análise contextual de anomalias.

Perguntas Frequentes

What is Windward's MAI Expert™ and how does it utilize generative AI?

How does the agentic maritime anomaly analysis solution work?

What AWS services are central to Windward's generative AI solution?

What are the primary challenges Windward aimed to solve with this generative AI approach?

How does the system ensure the relevance of retrieved information for a specific anomaly?

Fique Atualizado

Receba as últimas novidades de IA no seu e-mail.