Revolutionerar Maritim Anomalysanalys med Agentbaserad AI

Den vidsträckta, komplexa världen av global maritim aktivitet medför unika utmaningar för säkerhet, underrättelse och kommersiella operationer. Att identifiera och förstå ovanligt fartygsbeteende – från oväntade rörelser till avvikelser från kända mönster – kräver ofta enorm tid, djup domänexpertis och korrelation av disparata datakällor. Windward, en ledare inom Maritim AI™, har länge tillhandahållit kritisk underrättelse för marina operationer. Nu, i samarbete med AWS, utnyttjar Windward agentbaserad generativ AI för att omvandla denna process, och går från isolerade varningar till omfattande, kontextuell intelligens.

Detta banbrytande partnerskap syftar till att stärka maritima analytiker, drastiskt minska utredningstider och låta dem fokusera på högvärdigt beslutsfattande snarare än mödosam datainsamling. Genom att sammanfoga geospatial intelligens med avancerad generativ AI, erbjuder Windwards nya lösning en 360°-vy, förutser hot och skyddar kritiska tillgångar till sjöss med oöverträffad hastighet och precision.

Utmaningen: Från Dataöverbelastning till Handlingsbara Insikter

Historiskt sett var utredning av maritima anomalier en mycket manuell och tidskrävande uppgift. Analytiker spenderade timmar på att sålla igenom fragmenterad information och försöka koppla ihop olika dataströmmar för att förstå ett fartygs avvikande beteende. Denna process krävde inte bara betydande ansträngning utan också djup domänexpertis för att tolka nyanserna av maritima aktiviteter, vädermönster och geopolitiska händelser.

Windwards befintliga system för tidig upptäckt identifierar framgångsrikt misstänkta mönster, men målet var att påskynda vägen från upptäckt till beslutsfattande. För att optimera det analytiska arbetsflödet och tillhandahålla verkligt "uppdragsfärdiga" insikter, identifierade Windward tre viktiga strategiska förbättringar som behövdes:

- Enhetligt Arbetsflöde: Minimera behovet för analytiker att konsultera externa datakällor, vilket skapar en sömlös och fokuserad analytisk miljö.

- Expertisoptimering: Automatisera insamlingen och den initiala korrelationen av kontextuella data (väder, nyheter, relaterade varningar), vilket låter domänexperter ägna sin värdefulla tid åt strategisk tolkning och beslutsfattande.

- Omfattande Täckning: Effektivisera syntesen av information för att möjliggöra snabbare och djupgående undersökning av flera varningar samtidigt.

För att tackla dessa ambitiösa mål samarbetade Windward med AWS Generative AI Innovation Center för att utveckla MAI Expert™, den första generativa AI-baserade maritima agenten som kan automatiskt kontextualisera komplexa maritima anomalier.

Agentbaserad Arkitektur: Driver Kontextuell Intelligens med AWS

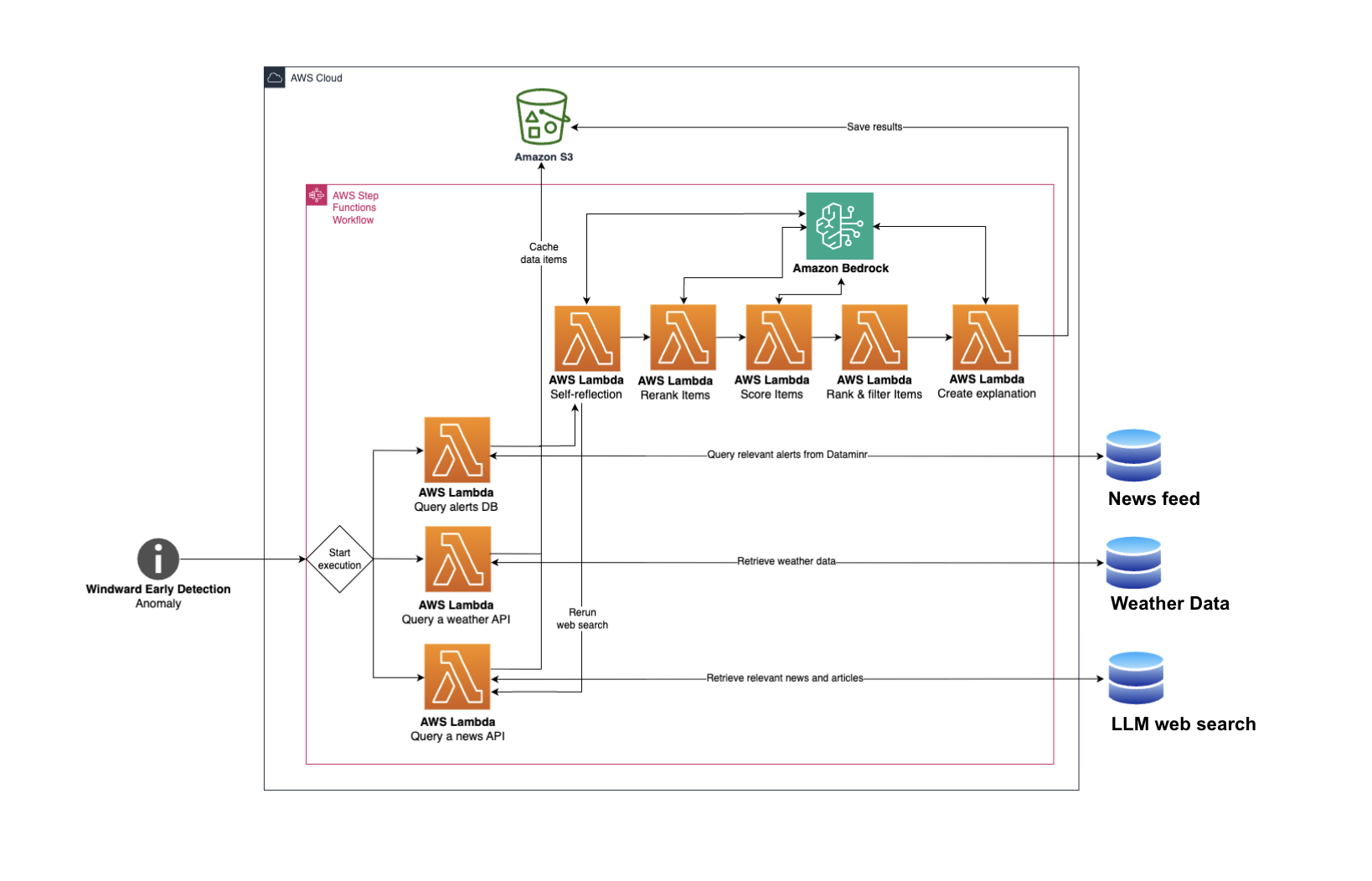

Hjärtat i Windwards förbättrade lösning ligger i dess flerstegs, AI-drivna arkitektur, distribuerad på AWS. Detta system hämtar automatiskt relevant data från olika interna och externa källor och använder denna information för att generera en textuell beskrivning som noggrant kontextualiserar maritima anomalihändelser.

Processen börjar när en anomali identifieras av Windwards system för tidig upptäckt. Relevant metadata – såsom anomalins tidsstämpel, regionkoordinater, anomalityp och fartygsklass – extraheras från Windwards interna databas.

Denna metadata matas sedan in i ett agentbaserat analyssystem som drivs av stora språkmodeller (LLM) på Amazon Bedrock. Hela flerstegspipelinen för anomalysanalys orkestreras med AWS Step Functions, vilket säkerställer ett robust och skalbart arbetsflöde.

Det första steget i denna orkestrerade process innebär att fråga flera, diverse externa datakällor för att samla relevant bakgrundsinformation:

- Nyhetsflöde i realtid: Varningar och händelsesignaler upptäckta från offentlig data hämtas och filtreras baserat på den maritima anomalins tid och plats.

- Intelligent Webbsökning: LLM:er genererar precisa sökfrågor, vilket möjliggör hämtning av uppdaterade webbsökresultat som tillhandahåller realtidskontext för anomalin.

- Väderdata: Ett externt API används för att hämta kritisk väderdata, inklusive temperatur, vindhastighet och nederbörd, för den specifika platsen och tidpunkten för anomalin.

Varje datakälla efterfrågas med en separat AWS Lambda-funktion. Denna modulära strategi säkerställer effektivitet och skalbarhet, vilket möjliggör enkel integration av nya datakällor vid behov.

Dynamisk Självreflektion och Datakuratorisering

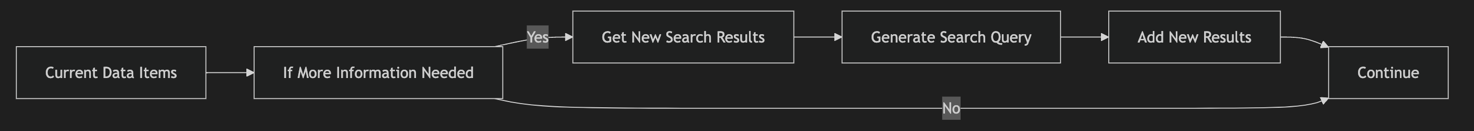

En central innovation i denna agentbaserade lösning är dess självreflektionsförmåga, som dynamiskt avgör behovet av ytterligare datahämtning. Efter den initiala datainsamlingen från nyheter, webbsökning och väder, går pipelinen vidare till ett andra steg. Här undersöker en separat LLM – driven av Anthropic's Claude via Amazon Bedrock – de hämtade dataobjekten.

Denna LLM instrueras att avgöra om den insamlade datan hittills är tillräcklig för att förklara anomalin eller om vissa aspekter relaterade till händelsen fortfarande saknas. Den kan sedan antingen generera en ny, mer förfinad sökfråga för ytterligare webbresultat eller signalera pipelinen att fortsätta. Denna intelligenta återkopplingsslinga, som visas i Figur 2, gör det möjligt för systemet att proaktivt söka efter mer omfattande kontext och lägga till den till tidigare insamlad information.

Figur 1. Lösningsarkitektur som visar AWS-tjänster och generativ AI.

Figur 1. Lösningsarkitektur som visar AWS-tjänster och generativ AI.

Figur 2. Självreflektionslogik i det agentbaserade anomalysanalyssystemet.

Figur 2. Självreflektionslogik i det agentbaserade anomalysanalyssystemet.

Efter denna dynamiska datahämtnings- och självreflektionsfas använder systemet en tvåstegs filtrerings- och rankningsprocess för att ta bort irrelevanta nyhetsartiklar och säkerställa den högsta kvaliteten på kontexten:

- Omrankning med Amazon Rerank: En AI-modell, Amazon Rerank, sorterar den initiala uppsättningen dataobjekt efter deras relevans för anomalin. Detta steg är avgörande för att upprätthålla hög återkallning, vilket effektivt minskar urvalet av kandidater för nästa steg.

- LLM-baserad Precisionspoängsättning: Var och en av de högst rankade objekten poängsätts sedan ytterligare av en LLM över flera dimensioner, inklusive tid, plats och matchande fartygstyp. Systemet tilldelar relevanspoäng mellan 0 och 100, och behåller endast de dataobjekt som överskrider ett fördefinierat tröskelvärde. Detta säkerställer hög precision, vilket garanterar att endast den mest relevanta informationen bidrar till den slutliga analysen.

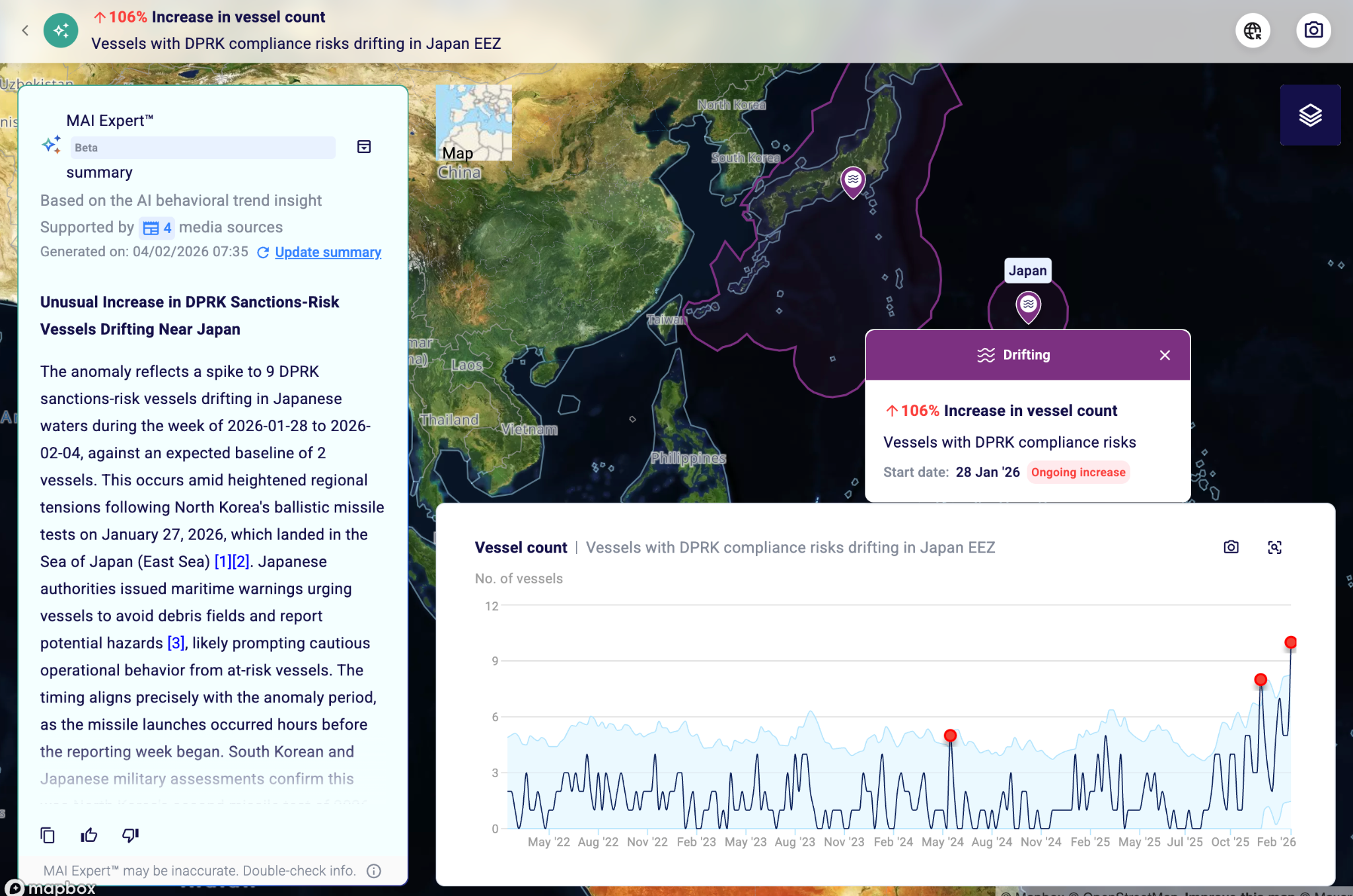

Handlingsbara Insikter: Den Kontextualiserade Rapporten

Slutligen skickas de noggrant filtrerade och rankade data till en annan LLM. Denna LLM syntetiserar all insamlad intelligens för att generera en kortfattad, kontextualiserad rapport om anomalin. Rapporten sammanfattar potentiella orsaker, risker och konsekvenser av den upptäckta maritima händelsen. Avgörande är att den är skriven för Windwards kunder och direkt citerar alla använda datakällor, vilket ger full transparens och gör det möjligt för användare att verifiera information och fördjupa sig genom att följa angivna länkar.

Figur 3. Exempel på en genererad anomalirapport från Windwards MAI Expert™.

Figur 3. Exempel på en genererad anomalirapport från Windwards MAI Expert™.

Denna output minskar drastiskt den kognitiva belastningen på analytiker, och presenterar dem med en färdig berättelse som förklarar anomalin inom dess bredare operativa och geopolitiska kontext.

Utvärdering och Påverkan

Systemet från början till slut utvärderas rigoröst mot en omfattande uppsättning historiska maritima anomalier. Denna utvärdering involverar ofta en LLM-som-domare-metod, som bedömer kvaliteten, noggrannheten och fullständigheten hos de genererade kontextuella rapporterna.

Implikationerna av denna agentbaserade generativa AI-lösning är djupgående. Genom att automatisera den mödosamma processen med datainsamling och korrelation, ger Windward maritima analytiker möjlighet att:

- Förbättra Effektiviteten: Minska avsevärt tiden som läggs på utredning, vilket frigör värdefulla mänskliga resurser.

- Förbättra Situationsmedvetenheten: Få en djupare, mer kontextuell förståelse för anomalier, och gå bortom isolerade varningar till omfattande intelligens.

- Påskynda Beslutsfattandet: Möjliggöra snabbare och mer välgrundade beslut, avgörande för att förutse hot och skydda tillgångar i dynamiska maritima miljöer.

- Optimera Expertis: Låta domänexperter fokusera på strategisk tolkning och högnivåanalys, och utnyttja sina unika färdigheter där de behövs som mest.

Samarbetet mellan Windward och AWS exemplifierar hur banbrytande generativ AI och molninfrastruktur kan utnyttjas för att lösa komplexa verkliga problem, omvandla kritiska sektorer som maritim underrättelse och sätta en ny standard för kontextuell anomalysanalys.

Vanliga frågor

What is Windward's MAI Expert™ and how does it utilize generative AI?

How does the agentic maritime anomaly analysis solution work?

What AWS services are central to Windward's generative AI solution?

What are the primary challenges Windward aimed to solve with this generative AI approach?

How does the system ensure the relevance of retrieved information for a specific anomaly?

Håll dig uppdaterad

Få de senaste AI-nyheterna i din inkorg.