Merevolusikan Analisis Anomali Maritim dengan AI Agen

Dunia aktiviti maritim global yang luas dan rumit menyajikan cabaran unik untuk keselamatan, perisikan, dan operasi komersial. Mengenal pasti dan memahami tingkah laku kapal yang luar biasa – daripada pergerakan tidak dijangka hingga penyimpangan daripada corak yang diketahui – sering memerlukan masa yang besar, kepakaran domain yang mendalam, dan korelasi sumber data yang berbeza. Windward, peneraju dalam AI Maritim™, telah lama menyediakan perisikan kritikal untuk operasi marin. Kini, dengan kerjasama AWS, Windward memanfaatkan AI generatif agen untuk mengubah proses ini, bergerak daripada amaran terasing kepada kecerdasan kontekstual yang komprehensif.

Perkongsian terobosan ini bertujuan untuk memperkasakan penganalisis maritim, mengurangkan masa penyiasatan secara drastik dan membolehkan mereka menumpukan perhatian kepada pembuatan keputusan bernilai tinggi daripada pengumpulan data yang sukar. Dengan menggabungkan kecerdasan geospasial dengan AI generatif canggih, penyelesaian baharu Windward menyediakan pandangan 360°, menjangka ancaman dan melindungi aset kritikal di laut dengan kelajuan dan ketepatan yang belum pernah terjadi sebelumnya.

Cabaran: Daripada Beban Data kepada Wawasan Boleh Dilaksanakan

Secara sejarah, penyiasatan anomali maritim adalah usaha yang sangat manual dan memakan masa. Penganalisis akan menghabiskan berjam-jam meneliti maklumat yang terfragmentasi, cuba menyambung titik antara pelbagai aliran data untuk memahami tingkah laku anomali kapal. Proses ini bukan sahaja menuntut usaha yang besar tetapi juga kepakaran domain yang mendalam untuk mentafsir nuansa aktiviti maritim, corak cuaca, dan peristiwa geopolitik.

Sistem Pengesanan Awal Windward yang sedia ada berjaya mengenal pasti corak yang mencurigakan, tetapi matlamatnya adalah untuk mempercepatkan laluan daripada pengesanan kepada pembuatan keputusan. Untuk mengoptimumkan aliran kerja analitikal dan menyediakan wawasan yang benar-benar 'sedia misi', Windward mengenal pasti tiga penambahbaikan strategik utama yang diperlukan:

- Aliran Kerja Bersatu: Meminimumkan keperluan penganalisis untuk merujuk sumber data luaran, mewujudkan persekitaran analitikal yang lancar dan fokus.

- Pengoptimuman Kepakaran: Mengautomasikan pengumpulan dan korelasi awal data kontekstual (cuaca, berita, amaran berkaitan), membolehkan pakar domain menumpukan masa berharga mereka untuk tafsiran strategik dan pembuatan keputusan.

- Liputan Komprehensif: Menyelaraskan sintesis maklumat untuk membolehkan penyiasatan yang lebih pantas dan mendalam terhadap berbilang amaran secara serentak.

Untuk mencapai matlamat bercita-cita tinggi ini, Windward bekerjasama dengan Pusat Inovasi AI Generatif AWS untuk membangunkan MAI Expert™, agen maritim AI generatif pertama yang mampu mengkontekstualisasikan anomali maritim kompleks secara automatik.

Seni Bina Agen: Menggerakkan Kecerdasan Kontekstual dengan AWS

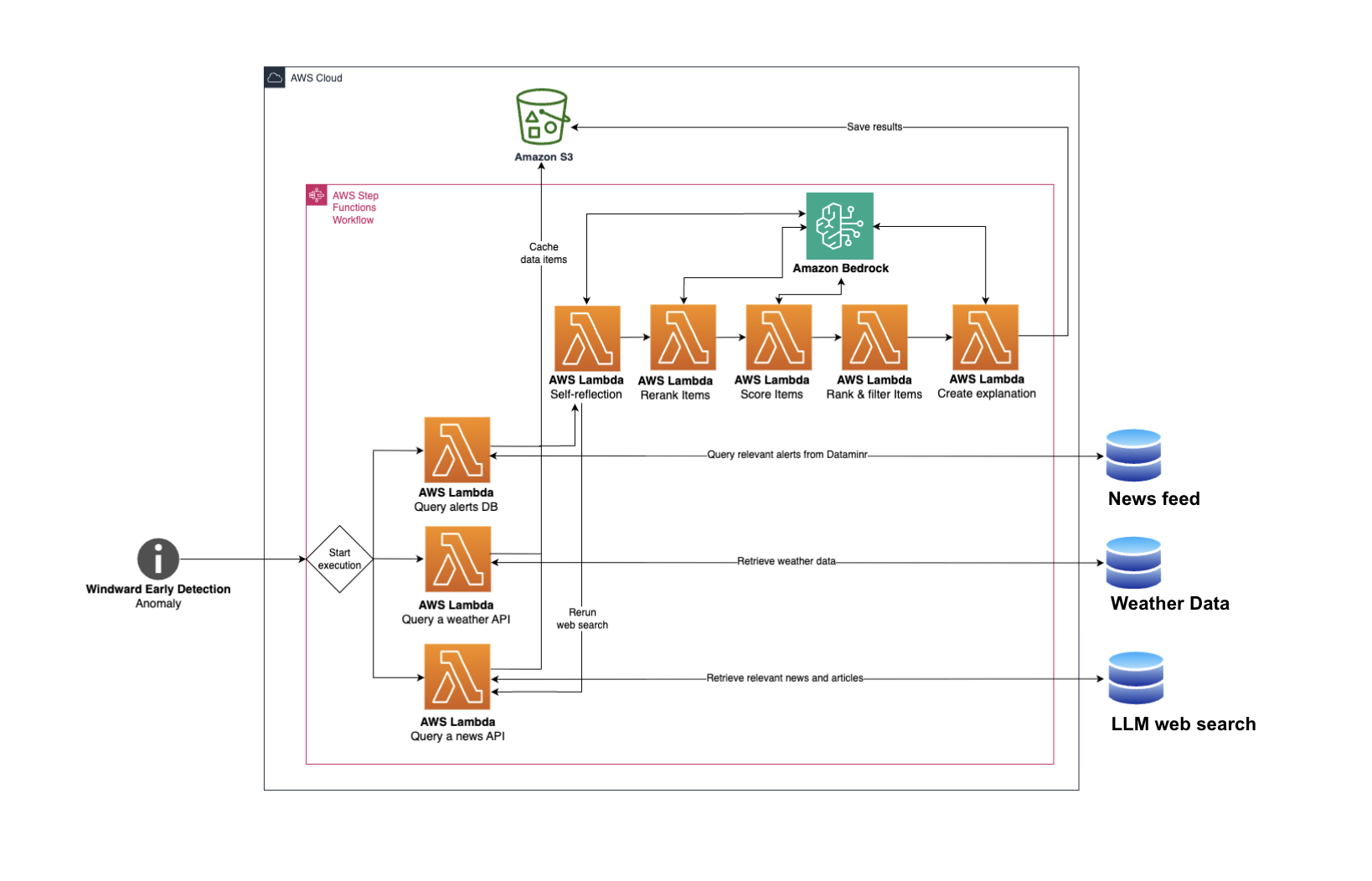

Inti penyelesaian Windward yang dipertingkat terletak pada seni bina berbilang langkah berkuasa AI, yang digunakan di AWS. Sistem ini secara automatik mendapatkan data relevan daripada pelbagai sumber dalaman dan luaran dan menggunakan maklumat ini untuk menjana perihalan teks yang mengkontekstualisasikan sepenuhnya kejadian anomali maritim.

Proses ini bermula apabila anomali dikenal pasti oleh sistem Pengesanan Awal Windward. Metadata yang relevan—seperti cap waktu anomali, koordinat wilayah, jenis anomali, dan kelas kapal—diekstrak daripada pangkalan data dalaman Windward.

Metadata ini kemudian dimasukkan ke dalam sistem analisis agen yang dikuasakan oleh model bahasa besar (LLM) di Amazon Bedrock. Keseluruhan saluran paip analisis anomali berbilang langkah ini diatur menggunakan AWS Step Functions, memastikan aliran kerja yang teguh dan boleh skala.

Langkah pertama dalam proses yang diatur ini melibatkan pertanyaan pelbagai sumber data luaran yang pelbagai untuk mengumpul maklumat latar belakang yang relevan:

- Suapan Berita Masa Nyata: Amaran dan isyarat kejadian yang ditemui daripada data awam diperoleh dan ditapis berdasarkan masa dan lokasi anomali maritim.

- Carian Web Pintar: LLM menjana pertanyaan carian yang tepat, membolehkan mendapatkan hasil carian web terkini yang menyediakan konteks masa nyata untuk anomali.

- Data Cuaca: API luaran digunakan untuk mendapatkan data cuaca kritikal, termasuk suhu, kelajuan angin, dan kerpasan, untuk lokasi dan masa anomali tertentu.

Setiap sumber data ditanya menggunakan fungsi AWS Lambda yang berasingan. Pendekatan modular ini memastikan kecekapan dan kebolehskalaan, membolehkan integrasi mudah sumber data baharu mengikut keperluan.

Refleksi Kendiri Dinamik dan Kurasi Data

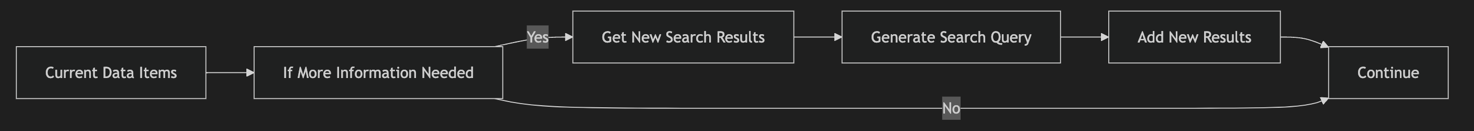

Inovasi utama dalam penyelesaian agen ini adalah keupayaan refleksi kendirinya, yang secara dinamik menentukan keperluan untuk mendapatkan data tambahan. Selepas pengumpulan data awal daripada berita, carian web, dan cuaca, saluran paip bergerak ke langkah kedua. Di sini, LLM berasingan—dikuasakan oleh Claude dari Anthropic melalui Amazon Bedrock—memeriksa item data yang diperoleh.

LLM ini diarahkan untuk memutuskan sama ada data yang dikumpul setakat ini mencukupi untuk menerangkan anomali atau jika aspek tertentu yang berkaitan dengan kejadian itu masih hilang. Ia kemudian boleh menjana pertanyaan carian baharu yang lebih diperhalusi untuk hasil web tambahan atau memberi isyarat kepada saluran paip untuk meneruskan. Gelung maklum balas pintar ini, yang digambarkan dalam Rajah 2, membolehkan sistem secara proaktif mencari konteks yang lebih komprehensif, menambahkannya kepada maklumat yang telah dikumpul sebelumnya.

Rajah 1. Seni bina penyelesaian yang menunjukkan perkhidmatan AWS dan AI generatif.

Rajah 1. Seni bina penyelesaian yang menunjukkan perkhidmatan AWS dan AI generatif.

Rajah 2. Logik refleksi kendiri dalam sistem analisis anomali agen.

Rajah 2. Logik refleksi kendiri dalam sistem analisis anomali agen.

Selepas fasa pemerolehan data dinamik dan refleksi kendiri ini, sistem menggunakan proses penapisan dan kedudukan dua peringkat untuk membuang item berita yang tidak relevan dan memastikan konteks berkualiti tertinggi:

- Penyusunan semula dengan Amazon Rerank: Model AI, Amazon Rerank, menyusun set awal item data mengikut relevansinya dengan anomali. Langkah ini penting untuk mengekalkan ingatan semula yang tinggi, mengurangkan bilangan calon untuk peringkat seterusnya secara cekap.

- Penskoran Ketepatan Berasaskan LLM: Setiap item yang berada di kedudukan teratas kemudiannya dinilai lagi oleh LLM merentasi pelbagai dimensi, termasuk masa, lokasi, dan jenis kapal yang sepadan. Sistem ini memberikan skor relevansi antara 0 hingga 100, hanya mengekalkan item data yang melebihi ambang yang telah ditetapkan. Ini memastikan ketepatan tinggi, menjamin bahawa hanya maklumat yang paling relevan menyumbang kepada analisis akhir.

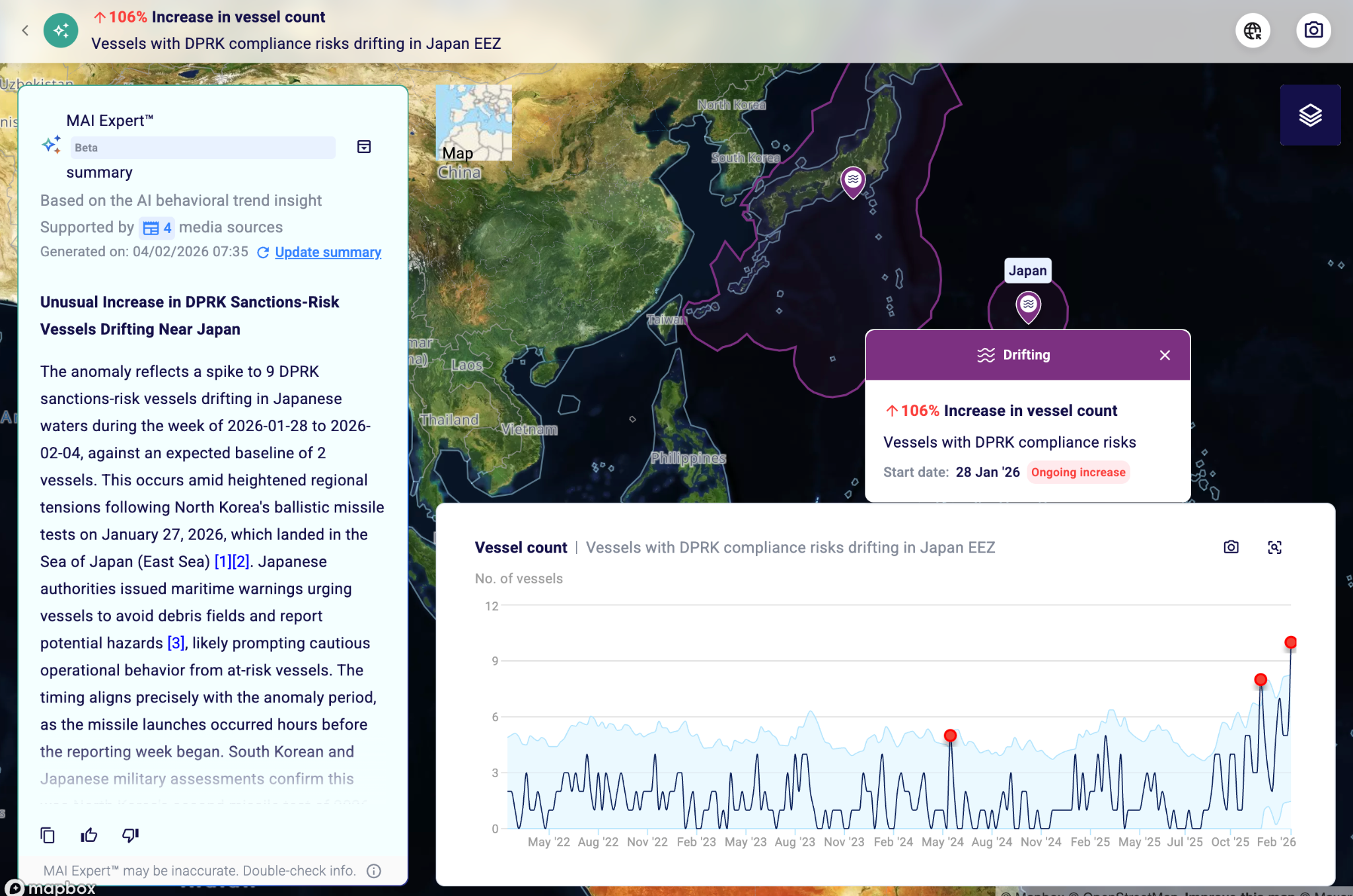

Wawasan Boleh Dilaksanakan: Laporan Kontekstual

Akhir sekali, data yang ditapis dan diberi kedudukan dengan teliti diserahkan kepada LLM lain. LLM ini mensintesis semua kecerdasan yang dikumpul untuk menjana laporan yang ringkas dan kontekstual mengenai anomali. Laporan ini merumuskan punca, risiko, dan implikasi yang berpotensi bagi kejadian maritim yang dikesan. Yang penting, ia ditulis untuk pelanggan Windward dan secara langsung memetik semua sumber data yang digunakan, memberikan ketelusan penuh dan membenarkan pengguna untuk mengesahkan maklumat dan menyelami lebih mendalam dengan mengikuti pautan yang disediakan.

Rajah 3. Contoh laporan anomali yang dihasilkan daripada MAI Expert™ Windward.

Rajah 3. Contoh laporan anomali yang dihasilkan daripada MAI Expert™ Windward.

Penilaian dan Impak

Sistem hujung ke hujung ini dinilai secara teliti terhadap set anomali maritim sejarah yang komprehensif. Penilaian ini sering melibatkan pendekatan LLM sebagai hakim, menilai kualiti, ketepatan, dan kelengkapan laporan kontekstual yang dihasilkan.

Implikasi penyelesaian AI generatif agen ini adalah mendalam. Dengan mengautomasikan proses pengumpulan dan korelasi data yang memenatkan, Windward memperkasakan penganalisis maritim untuk:

- Meningkatkan Kecekapan: Mengurangkan masa yang dihabiskan untuk penyiasatan secara signifikan, membebaskan sumber manusia yang berharga.

- Meningkatkan Kesedaran Situasi: Memperoleh pemahaman yang lebih mendalam dan kontekstual mengenai anomali, bergerak melangkaui amaran terasing kepada kecerdasan komprehensif.

- Mempercepatkan Pembuatan Keputusan: Membolehkan keputusan yang lebih pantas dan bermaklumat, kritikal untuk menjangka ancaman dan melindungi aset dalam persekitaran maritim yang dinamik.

- Mengoptimumkan Kepakaran: Membolehkan pakar domain menumpukan perhatian kepada tafsiran strategik dan analisis peringkat tinggi, memanfaatkan kemahiran unik mereka di tempat yang paling penting.

Kerjasama antara Windward dan AWS menunjukkan bagaimana AI generatif canggih dan infrastruktur awan dapat dimanfaatkan untuk menyelesaikan masalah dunia nyata yang kompleks, mengubah sektor kritikal seperti perisikan maritim dan menetapkan piawaian baharu untuk analisis anomali kontekstual.

Soalan Lazim

What is Windward's MAI Expert™ and how does it utilize generative AI?

How does the agentic maritime anomaly analysis solution work?

What AWS services are central to Windward's generative AI solution?

What are the primary challenges Windward aimed to solve with this generative AI approach?

How does the system ensure the relevance of retrieved information for a specific anomaly?

Kekal Dikemas Kini

Dapatkan berita AI terkini dalam peti masuk anda.