Revoluționarea Analizei Anomaliilor Maritime cu AI Agentică

Vasta și complexa lume a activității maritime globale prezintă provocări unice pentru securitate, inteligență și operațiuni comerciale. Identificarea și înțelegerea comportamentului neobișnuit al navelor – de la mișcări neașteptate la abateri de la tiparele cunoscute – necesită adesea un timp imens, o expertiză aprofundată în domeniu și corelarea unor surse de date disparate. Windward, un lider în AI Maritimă™, a furnizat de mult timp informații critice pentru operațiunile marine. Acum, în colaborare cu AWS, Windward utilizează AI generativă agentică pentru a transforma acest proces, trecând de la alerte izolate la o inteligență cuprinzătoare și contextuală.

Acest parteneriat inovator își propune să împuternicească analiștii maritimi, reducând drastic timpul de investigare și permițându-le să se concentreze pe luarea deciziilor de mare valoare, mai degrabă decât pe colectarea laborioasă a datelor. Prin fuzionarea inteligenței geospațiale cu AI generativă avansată, noua soluție a Windward oferă o vizualizare la 360°, anticipând amenințările și protejând activele critice pe mare cu o viteză și precizie fără precedent.

Provocarea: De la Supraîncărcarea de Date la Informații Acționabile

Din punct de vedere istoric, investigarea anomaliilor maritime a fost o inițiativă puternic manuală și intensivă în timp. Analiștii petreceau ore întregi cernând informații fragmentate, încercând să conecteze puncte între diverse fluxuri de date pentru a înțelege comportamentul anormal al unei nave. Acest proces a necesitat nu numai un efort semnificativ, ci și o expertiză profundă în domeniu pentru a interpreta nuanțele activităților maritime, tiparele meteorologice și evenimentele geopolitice.

Sistemul existent de Detecție Timpurie al Windward identifică cu succes tiparele suspecte, dar scopul a fost accelerarea drumului de la detecție la luarea deciziilor. Pentru a optimiza fluxul de lucru analitic și a oferi informații cu adevărat "pregătite pentru misiune", Windward a identificat trei îmbunătățiri strategice cheie necesare:

- Flux de Lucru Unificat: Minimizarea necesității ca analiștii să consulte surse externe de date, creând un mediu analitic fluid și concentrat.

- Optimizarea Expertizei: Automatizarea colectării și corelării inițiale a datelor contextuale (vreme, știri, alerte conexe), permițând experților în domeniu să-și dedice timpul prețios interpretării strategice și luării deciziilor.

- Acoperire Cuprinzătoare: Eficientizarea sintezei informațiilor pentru a permite o investigare mai rapidă și mai aprofundată a multiplelor alerte simultan.

Pentru a aborda aceste obiective ambițioase, Windward a colaborat cu Centrul de Inovație AWS Generative AI pentru a dezvolta MAI Expert™, primul agent maritim de AI generativă capabil să contextualizeze automat anomaliile maritime complexe.

Arhitectura Agentică: Alimentarea Inteligenței Contextuale cu AWS

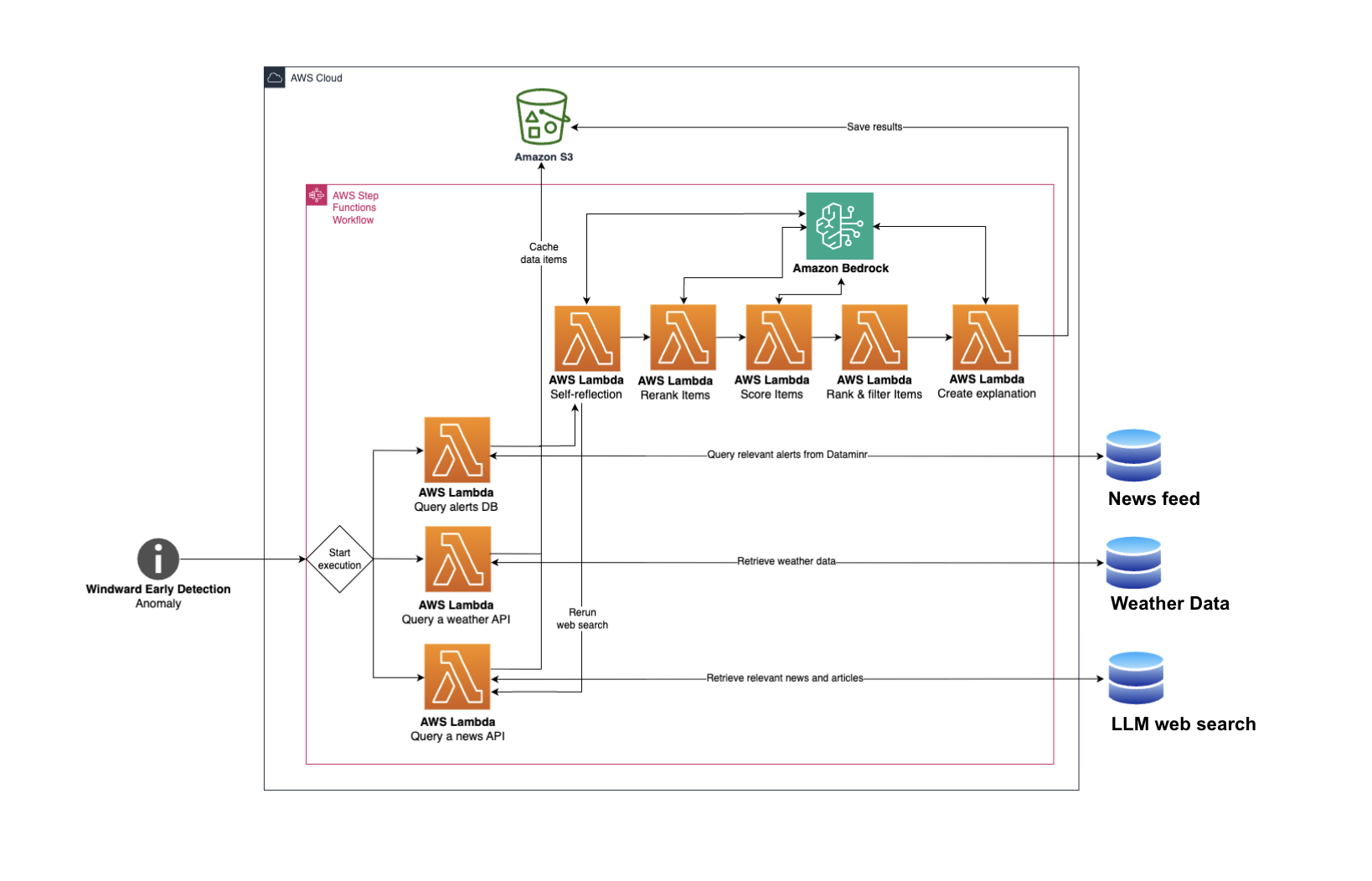

Inima soluției îmbunătățite a Windward constă în arhitectura sa multistep, bazată pe AI, implementată pe AWS. Acest sistem preia automat date relevante din diverse surse interne și externe și utilizează aceste informații pentru a genera o descriere textuală care contextualizează în detaliu evenimentele de anomalie maritimă.

Procesul începe atunci când o anomalie este identificată de sistemul de Detecție Timpurie Windward. Metadatele relevante – cum ar fi marcajul temporal al anomaliei, coordonatele regiunii, tipul anomaliei și clasa navei – sunt extrase din baza de date internă a Windward.

Aceste metadate sunt apoi introduse într-un sistem de analiză agentică bazat pe modele lingvistice mari (LLM) pe Amazon Bedrock. Întregul flux de lucru multistep de analiză a anomaliilor este orchestrat utilizând AWS Step Functions, asigurând un flux de lucru robust și scalabil.

Primul pas în acest proces orchestrat implică interogarea mai multor surse externe de date diverse pentru a colecta informații relevante de fond:

- Flux de Știri în Timp Real: Alertele și semnalele de evenimente descoperite din datele publice sunt preluate și filtrate pe baza timpului și locației anomaliei maritime.

- Căutare Web Inteligentă: LLM-urile generează interogări de căutare precise, permițând recuperarea rezultatelor de căutare web actualizate care oferă context în timp real pentru anomalie.

- Date Meteorologice: Un API extern este utilizat pentru a prelua date meteorologice critice, inclusiv temperatura, viteza vântului și precipitațiile, pentru locația și momentul specific al anomaliei.

Fiecare sursă de date este interogată utilizând o funcție AWS Lambda separată. Această abordare modulară asigură eficiența și scalabilitatea, permițând integrarea ușoară a noilor surse de date, după cum este necesar.

Auto-Reflecție Dinamică și Curatarea Datelor

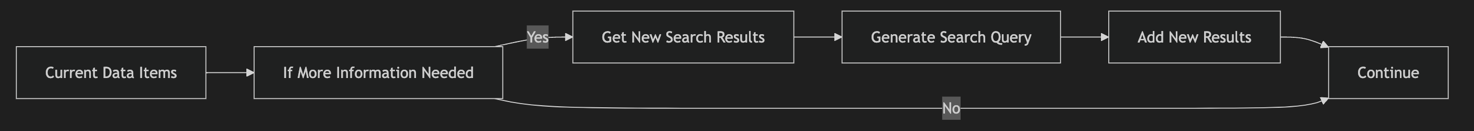

O inovație centrală în această soluție agentică este capacitatea sa de auto-reflecție, care determină dinamic necesitatea recuperării datelor suplimentare. După colectarea inițială a datelor din știri, căutare web și vreme, fluxul de lucru trece la un al doilea pas. Aici, un LLM separat – alimentat de Claude de la Anthropic prin Amazon Bedrock – examinează elementele de date recuperate.

Acest LLM este instruit să decidă dacă datele colectate până în prezent sunt suficiente pentru a explica anomalia sau dacă anumite aspecte legate de eveniment lipsesc încă. Acesta poate apoi fie să genereze o nouă interogare de căutare, mai rafinată, pentru rezultate web suplimentare, fie să semnaleze fluxului de lucru să continue. Această buclă de feedback inteligentă, ilustrată în Figura 2, permite sistemului să caute proactiv un context mai cuprinzător, adăugându-l la informațiile colectate anterior.

Figura 1. Arhitectura soluției demonstrând serviciile AWS și AI generativă.

Figura 1. Arhitectura soluției demonstrând serviciile AWS și AI generativă.

Figura 2. Logica de auto-reflecție în sistemul agentic de analiză a anomaliilor.

Figura 2. Logica de auto-reflecție în sistemul agentic de analiză a anomaliilor.

După această fază dinamică de recuperare și auto-reflecție a datelor, sistemul utilizează un proces de filtrare și clasificare în două etape pentru a elimina știrile irelevante și a asigura contextul de cea mai înaltă calitate:

- Re-clasificare cu Amazon Rerank: Un model AI, Amazon Rerank, sortează setul inițial de elemente de date în funcție de relevanța lor față de anomalie. Acest pas este crucial pentru menținerea unei recuperări ridicate, reducând eficient setul de candidați pentru etapa următoare.

- Scor de Precizie bazat pe LLM: Fiecare dintre elementele cel mai bine clasate este apoi punctat suplimentar de un LLM pe multiple dimensiuni, inclusiv timp, locație și tipul de navă corespunzător. Sistemul atribuie scoruri de relevanță între 0 și 100, reținând doar acele elemente de date care depășesc un prag predefinit. Acest lucru asigură o precizie ridicată, garantând că doar cele mai pertinente informații contribuie la analiza finală.

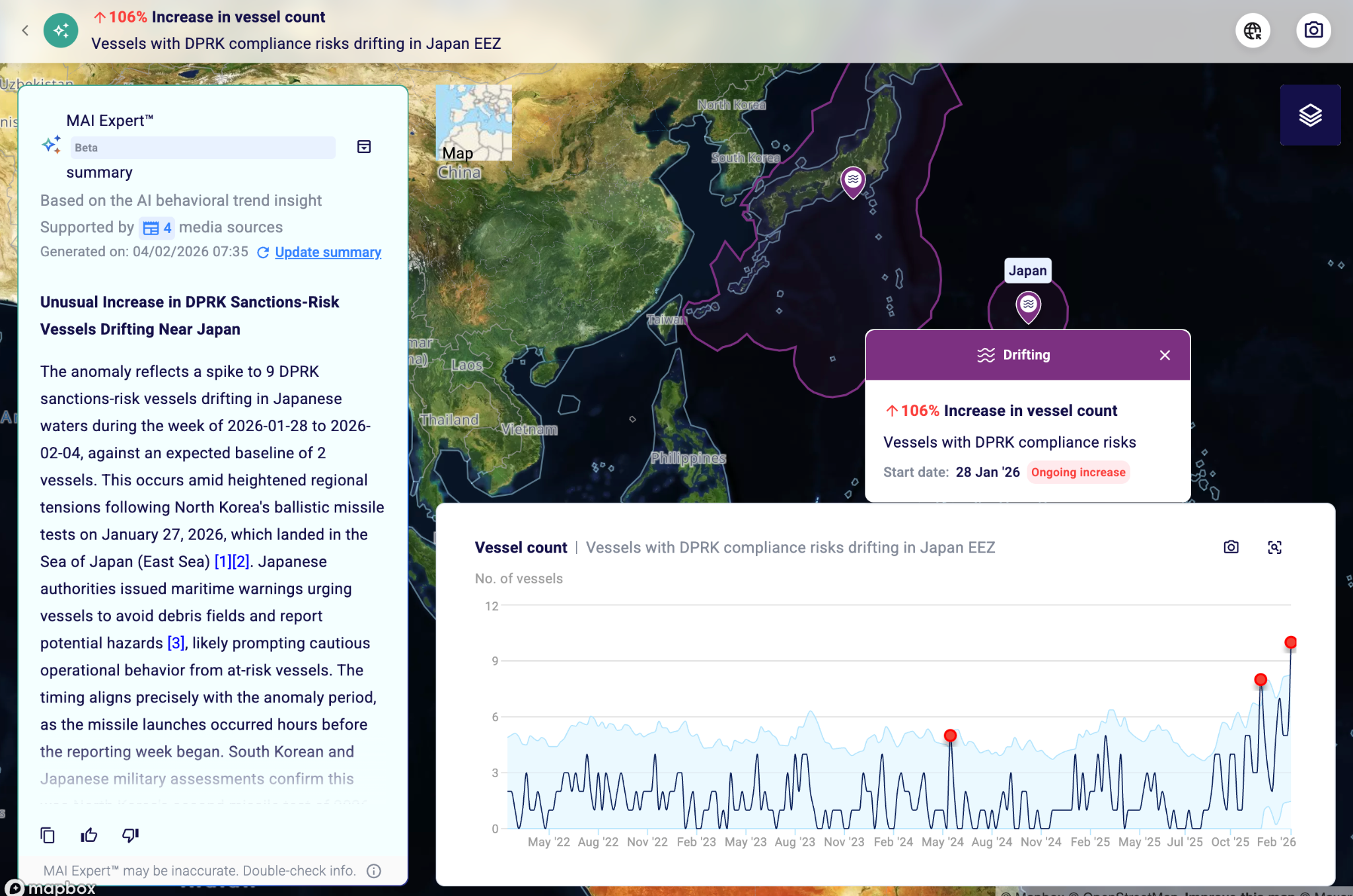

Informații Acționabile: Raportul Contextualizat

În cele din urmă, datele filtrate și clasificate cu meticulozitate sunt transmise unui alt LLM. Acest LLM sintetizează toate informațiile colectate pentru a genera un raport concis, contextualizat, despre anomalie. Raportul rezumă cauzele potențiale, riscurile și implicațiile evenimentului maritim detectat. Crucial, este scris pentru clienții Windward și citează direct toate sursele de date utilizate, oferind transparență deplină și permițând utilizatorilor să verifice informațiile și să aprofundeze, urmând linkurile furnizate.

Figura 3. Exemplu de raport de anomalie generat de MAI Expert™ de la Windward.

Figura 3. Exemplu de raport de anomalie generat de MAI Expert™ de la Windward.

Această ieșire reduce drastic sarcina cognitivă a analiștilor, prezentându-le o narațiune gata făcută care explică anomalia în contextul său operațional și geopolitic mai larg.

Evaluare și Impact

Sistemul end-to-end este evaluat riguros pe baza unui set cuprinzător de anomalii maritime istorice. Această evaluare implică adesea o abordare LLM-ca-judecător, evaluând calitatea, acuratețea și caracterul complet al rapoartelor contextuale generate.

Implicațiile acestei soluții de AI generativă agentică sunt profunde. Prin automatizarea procesului laborios de colectare și corelare a datelor, Windward le permite analiștilor maritimi să:

- Creșterea Eficienței: Reducerea semnificativă a timpului petrecut cu investigarea, eliberând resurse umane valoroase.

- Îmbunătățirea Conștientizării Situaționale: Obținerea unei înțelegeri mai profunde, mai contextuale a anomaliilor, trecând de la alerte izolate la o inteligență cuprinzătoare.

- Accelerarea Luării Deciziilor: Permiterea unor decizii mai rapide și mai informate, critice pentru anticiparea amenințărilor și protejarea activelor în medii maritime dinamice.

- Optimizarea Expertizei: Permiterea experților în domeniu să se concentreze pe interpretarea strategică și analiza de nivel înalt, valorificându-și abilitățile unice acolo unde contează cel mai mult.

Colaborarea dintre Windward și AWS exemplifică modul în care AI-ul generativ de ultimă generație și infrastructura cloud pot fi valorificate pentru a rezolva probleme complexe din lumea reală, transformând sectoare critice precum inteligența maritimă și stabilind un nou standard pentru analiza contextuală a anomaliilor.

Întrebări frecvente

What is Windward's MAI Expert™ and how does it utilize generative AI?

How does the agentic maritime anomaly analysis solution work?

What AWS services are central to Windward's generative AI solution?

What are the primary challenges Windward aimed to solve with this generative AI approach?

How does the system ensure the relevance of retrieved information for a specific anomaly?

Rămâi la curent

Primește ultimele știri AI în inbox-ul tău.